Este documento también está disponible en formato PDF y en otros idiomas: English, 日本語.

Colofón

Cita sugerida

Reyserhove L, Norton B & Desmet P (2023) Buenas prácticas para gestionar y publicar datos de cámaras trampa. Secretaría de GBIF: Copenhague. https://doi.org/10.35035/doc-0qzp-2x37

Colaboradores

Tanja Milotic y Pieter Huybrechts contribuyeron a la introducción y las figuras.

Traducciones

español

Esta guía fue traducida al Español en el marco del proyecto CESP "Fortaleciendo la publicación de datos de cámaras trampa a través de GBIF en Latinoamérica" (CESP2025-014)

Japonés

Traducida por Kumiko Totsu, Keita Fukasawa y Kana Terayama del Instituto Nacional de Estudios Ambientales de Japón, en colaboración con la Iniciativa Japonesa para la Información sobre Biodiversidad (JBIF).

Licencia

El documento Buenas prácticas para gestionar y publicar datos de cámaras trampa tiene licencia bajo Atribución/Reconocimiento-CompartirIgual 4.0 Internacional.

Resumen

Las cámaras trampa han surgido como herramientas importantes para monitorear el estado de la biodiversidad y los ecosistemas naturales. La proliferación de datos de estos sensores ha hecho que la gestión de datos, más que la recopilación de datos, sea el factor limitante en la investigación relacionada con las cámaras trampa. Esta guía proporciona recomendaciones para la gestión de datos de cámara trampa y su publicación en GBIF. Está dirigida a cualquier persona que lleve a cabo un estudio con cámaras trampa, en particular administradores de datos, editores de datos y otras que trabajen en la informática de la biodiversidad.

1. Introducción

1.1. ¿Qué es esta guía?

Las cámaras trampa han surgido como una tecnología poderosa para la observación semiautomatizada de ecosistemas naturales. Su éxito ha llevado a un crecimiento exponencial de los datos de cámaras trampa en todo el mundo. Esto trae un gran desafío: grandes volúmenes de datos están a la espera de ser clasificados, interpretados y archivados. La gestión de datos, más que la recopilación de datos, se ha convertido en un factor limitante para la investigación con cámaras trampa. La proliferación de proyectos de cámaras trampa también ha llevado a una diversidad de terminologías, métodos de clasificación y prácticas de gestión de datos, que impiden transparencia, interoperabilidad, colaboración cruzada de proyectos o meta análisis. Una gran red interconectada de cámaras remotas podría actuar como un instrumento para la gestión de la biodiversidad en tiempo real y la toma de decisiones fiable, pero si no somos capaces de combinar datos, la investigación con cámaras trampa perderá su máximo potencial. Esta es la razón por la que los datos de las cámaras trampa deben estar abiertos y FAIR (localizable, accesible, interoperable y reutilizable, por sus siglas en inglés, ver (Wilkinson et al. (2016)), para que tanto humanos como máquinas puedan utilizar estos valiosos datos para aplicaciones presentes y futuras.

Para optimizar la (re)utilización de los datos de cámaras trampa, hay una necesidad de directrices sobre mejores prácticas. Existen varias guías que abordan uno o más elementos del ciclo de vida de la cámara trampa: planificación, tecnología y técnicas, diseño de estudio, recopilación de datos, análisis, métodos de gestión y publicación de datos (O’Connell et al. 2011; Rovero et al. 2013; Meek et al. 2014; Cadman et al. 2014; Burton et al. 2015; Wearn y Glover-Kapfer 2017). Desde entonces, la comunidad de cámaras trampa ha hecho progresos significativos:

-

Las plataformas especializadas de gestión de datos ahora se utilizan principalmente para gestionar proyectos y datos

-

La inteligencia artificial (IA) y la [cloud-computingcomputación en la nube] se utilizan cada vez más para automatizar el reconocimiento de especies y pronto se aplicará a la mayoría de los registros multimedia

-

El intercambio de datos ahora se facilita por Camtrap DP, formato de intercambio de datos desarrollado bajo los Estándares de Información sobre la Biodiversidad (TDWG). Hay una mayor conciencia de la ciencia abierta, datos FAIR data (Wilkinson-2016) y normas de privacidad

No hay guías actualizadas disponibles que se centren únicamente en la gestión y publicación de los datos de las cámaras trampa. Esta guía pretende cubrir ese vacío.

1.2. Público objetivo

Esta guía está pensada para ser útil para cualquier persona que gestione un estudio con cámaras trampa. El enfoque específico en la gestión y publicación de datos hace que esta guía de buenas prácticas sea más útil para perfiles como administradores de datos, publicadores de datos, gestores de bases de datos y de información y estudiantes que trabajan en informática de la biodiversidad.

Los autores de esta guía tienen experiencia con las cámaras trampa tradicionales (diseñadas para mamíferos terrestres de tamaño mediano a grande), pero muchas de las recomendaciones, así como el estándar Camtrap DP, podrían ser aplicables a datos de otros tipos de cámaras trampa.

1.3. De qué no trata esta guía

Esta guía se centra principalmente en la gestión, el control de calidad, la mejora y la publicación de datos de cámaras trampa. Los siguientes temas están fuera del alcance:

-

Planear un estudio de cámaras trampa: tipos de cámaras trampa, diseño de estudio, etc.

-

Distribución y recolección de cámaras trampa: trabajo de campo, cebos y señuelos, recuperación de datos, etc.

-

Análisis: software de análisis, modelado ecológico, corrección de sesgos, etc.

-

Datos de las cámaras móviles: robots submarinos, cámaras montadas en vehículos, drones, etc.

2. El uso de cámaras trampa

2.1. ¿Qué son las cámaras trampa?

Las cámaras trampa son dispositivos de grabación desplegados en el campo para capturar automáticamente imágenes o videos de la actividad de la vida silvestre. También se les conoce como cámaras de fototrampeo. Pueden grabar archivos multimedia en un intervalo regular (lapso de tiempo) o cuando se activa por la actividad de un animal. Tradicionalmente, "cámaras trampa" se refiere a aquellas diseñadas para grabar mamíferos terrestres de tamaño medio a grande con un sensor infrarrojo pasivo (PIR) (Hobbs and Brehme 2017), pero existen otros tipos, p. ej., para medio marino o para insectos. Al igual que satélites, drones, rastreadores GPS o sensores acústicos, las cámaras trampa recolectan observaciones mecánicas. Los sensores acústicos en particular son bastante similares a las cámaras trampa, que utilizan audio en lugar de imagen/video para observar el ecosistema circundante. Todas estas tecnologías tienen el beneficio de poder recopilar datos a una escala y frecuencia que serían difíciles de obtener a través de observaciones humanas, suelen sufrir menos del sesgo por interpretación o interferencia humana.

2.2. ¿Por qué se utilizan las cámaras trampa?

En las últimas décadas, las cámaras trampa se han utilizado cada vez más para recopilar datos de biodiversidad de forma no invasiva con una mínima perturbación de la vida silvestre. Ya en los años 1890, George Siras fue el primero en desarrollar un método que utilizaba un hilo disparador (tripwire) y flash, mediante el cual los animales salvajes se fotografiaron a sí mismos (Kucera and Barrett 2011). Los primeros estudios científicos de cámaras trampa se remontan a principios del siglo XX (Chapman 1927). Desde aquellos días de innovación, los avances tecnológicos en fotografía digital y sensores infrarrojos han conducido a la detección rentable y no invasiva de la esquiva vida salvaje (Burton et al. 2015). Las cámaras trampa se han convertido en herramientas de investigación populares: son fáciles de instalar, son relativamente baratas y no requieren permisos especiales ni formación y, por lo tanto, están siendo utilizadas por investigadores profesionales y aficionados a una escala muy amplia. En consecuencia, el número de publicaciones anuales relacionadas con estudios con cámaras trampa se ha multiplicado por más de 80 veces desde los años 1990. La tecnología de las cámaras trampa se utiliza para muestrear comunidades de mamíferos de tamaño mediano a grande, y especies de aves que habitan ecosistemas de agua dulce, terrestres, fosoriales, arbóreos y marinos y han demostrado ser excelentes herramientas para ayudar a las iniciativas de observación de la biodiversidad (Delisle et al. 2021).

Los taxones de animales más frecuentemente estudiados incluyen ungulados, carnívoros, primates y aves, aunque los sensores más innovadores también permiten la detección de pequeños mamíferos, anfibios, reptiles, peces e invertebrados (Hobbs and Brehme 2017). La tecnología de las cámaras trampa es adecuada para recoger datos de presencia, así como abundancia, densidad, diversidad y distribución de especies (Tabla 1) y para responder preguntas conductuales como patrones de actividad y respuestas a la perturbación humana. Además, las cámaras trampa no son selectivas en las observaciones de las especies y, por lo tanto, a menudo se utilizan en estudios de interacción de especies. Los datos de "captura adicional" de los estudios de especies objetivo podrían ser útiles también para otros estudios. A menudo se utilizan para monitorear especies raras, amenazadas y en peligro de extinción en terrenos remotos e inaccesibles.

| Objetivo del estudio | Resultado | Referencias clave |

|---|---|---|

abundancia |

densidad Sollmann et al. (2012); Tobler and Powell (2013); Rowcliffe et al. (2008); Rowcliffe et al. (2016) |

abundancia |

abundancia relativa |

Rowcliffe et al. (2008); Wearn et al. (2013); Cusack et al. (2015) |

distribución |

ocupación |

Mackenzie and Royle (2005); Guillera-Arroita et al. (2010); O’Brien (2010); Shannon et al. (2014) |

diversidad |

diversidad-beta |

diversidad |

|

índices de diversidad |

diversidad |

|

riqueza |

presencia de especies |

2.3. Ciclo de vida de la cámara trampa

El ciclo de vida completo de la investigación con cámaras trampa incluye la fase de planificación, la instalación de las cámaras trampa en el campo, la recolección, la gestión, el análisis y el intercambio de datos. Esta guía no pretende cubrir todos los aspectos del ciclo de vida del proyecto con cámaras trampa. El enfoque en esta guía de buenas prácticas radica en la gestión y publicación de los datos. Para los lectores interesados en una revisión general de la investigación con cámaras trampa, la fase de planificación, la instalación de cámaras trampa en el campo, aquí proporcionamos una visión general de los recursos disponibles (ver Tabla 2).

| Tema | Qué | Referencia |

|---|---|---|

Ciclo de vida completo de captura de cámara |

Estado general de la técnica |

Cadman et al. (2014); Rovero and Zimmermann (2016); Wearn and Glover-Kapfer (2017); Meek et al. (2020); Glover‐Kapfer et al. (2019) |

Planificación |

¿Cómo diseñar un estudio con cámaras trampa? |

Wearn and Glover-Kapfer (2017); Rovero et al. (2010); Sunarto et al. (2013); Meek et al. (2014); Kays et al. (2020); Caravaggi et al. (2020); Hobbs and Brehme (2017); McIntyre et al. (2020) |

Instalación y recolección |

¿Dónde y cómo montar su cámara? |

Wearn and Glover-Kapfer (2017); Rovero et al. (2010); Rovero et al. (2013); Meek et al. (2014) |

Gestión e intercambio de datos |

Consideraciones de gestión de datos |

|

Análisis |

Software para analizar datos |

Para que el conjunto de datos de una cámara sea útil, debería definir claramente el propósito y los objetivos en la fase de planificación: ¿qué le gustaría saber de qué grupos de especies? Cada propósito trae consigo sus propias características clave a considerar, como la altura y dirección de la cámara, estacionalidad, uso de cebo, características de zona de detección, ajustes de cámara, activación y tipo de flash. Estas características deben incluirse en el conjunto de datos publicado con el fin de ser útiles en los análisis subsiguientes. Recomendamos consultar las referencias clave en Tabla 1 para lectores interesados en este tema. Adicionalmente, Wearn and Glover-Kapfer (2017) proporciona una visión global de los aspectos generales de diseño de relevamientos con cámaras trampa.

3. Gestión de datos de cámaras trampa

Una vez que una cámara trampa está operando en el campo puede generar centenas, miles o incluso millones de fotos o videos en el marco temporal del proyecto. En última instancia, es necesario analizar estos datos. Pero primero, es necesario recuperar, almacenar, organizar y etiquetar los datos. El contenido de las imágenes necesita interpretación o anotación, ya sea manualmente o con ayuda de tecnología. Todas estas etapas se consideran en el proceso de gestión de datos.

La gestión de datos es uno de los verdaderos cuellos de botella en la investigación con cámaras trampa. La enorme cantidad de información almacenada en las tarjetas de memoria requiere una alta inversión en términos de esfuerzo humano y tiempo. Si el almacenamiento y la clasificación de datos se quedan rezagados, grandes volúmenes de datos permanecerán sin utilizar y se perderán eventualmente. La extracción, la organización y el etiquetado manuales pueden introducir errores humanos y provocar la pérdida de datos. Además, a menudo existe más información en la imagen o el video que la correspondiente únicamente a la especie (o grupo) objetivo o tema que constituye el foco del proyecto. Las cámaras trampa inherentemente detectan múltiples especies, y las observaciones de especies no objetivo proporcionan datos valiosos para otros objetivos de investigación. Si se anotaran todos los datos, incluidas las especies no objetivo, se podrían generar resultados más relevantes para los fondos (Young et al. 2018; Wearn and Glover-Kapfer 2017).

Para concluir, cada investigador debe prestar atención a la calidad de los datos. La idea subyacente es: es mejor tener diez elementos bien documentados en lugar de cien elementos mal documentados. Sólo de esta manera podremos convertir la cacofonía de los datos provenientes de imágenes en bruto en datos cuantitativos útiles.

En esta sección introducimos una serie de convenciones generales para la gestión adecuada de los datos. Nos acercamos más a qué son exactamente los datos de las cámaras trampa. Nos centramos en cómo gestionar de la mejor manera y qué plataformas de gestión de datos se pueden utilizar para facilitar el proceso para cada tipo de datos de cámara trampa (metadata, media, deployments, observations).

3.1. Qué son los datos de las cámaras trampa

Intuitivamente, asociamos los datos de las cámaras trampa con los multimedia capturados por las cameras. Pero para poder utilizarlos para la investigación necesitan estar documentados con información adicional. Los archivos multimedia deben ser classified para saber qué especies fueron observadas. La información sobre el despliegue, la duración, la [location], la alineación y la metodología de muestreo, es necesaria para saber cuándo, dónde y qué tan probable era que se observaran esas especies. Finalmente, necesitamos información sobre el project/study en su conjunto para conocer el alcance y quién estaba involucrado.

En general, podemos distinguir cuatro tipos de datos de cámaras trampa:

-

Metadatos del proyecto: información sobre el proyecto/estudio cómo un todo

-

Archivos multimedia: imágenes, videos o archivos de sonido capturados por las cameras, incluyendo sus metadatos EXIF

-

Despliegues: información sobre la [location] de la cámara y su alineación, la duración de muestreo y covariables. Normalmente no se registra automáticamente por la cámara.

-

Observaciones: información sobre lo que se puede ver u oír en los archivos multimedia (es decir, objetos de interés), como animales, seres humanos o vehículos. El objetivo normalmente es registrar qué especies animales fueron observadas, incluyendo opcionalmente información sobre el tamaño de su grupo, la etapa de vida, el sexo y el comportamiento.

Estos datos pueden organizarse de diferentes maneras, basándose en la preferencia personal o en qué data management system se utiliza. Sin embargo, podemos identificar una serie de conceptos básicos, más adelante denominados como clases, que constituyen un "modelo" para los datos de cámaras trampa (ver la Figura 1). Estas clases son proyecto, organización, participante, despliegue, ubicación, dispositivos, multimedios, secuencia y observación.

0| cero o uno, 0< cero a muchos, |< uno a muchos, y || exactamente uno. Un despliegue por ejemplo tiene cero para muchos medios, mientras que un medio pertenece exactamente a un despliegue.3.2. Metadatos del proyecto

Los metadatos del proyecto documentan un proyecto/estudio con cámaras trampa como un todo. ¿Quién estaba implicado?, ¿cuál era la razón?, ¿qué métodos de muestreo se utilizaron? y ¿cuál era el alcance? Los proyectos pueden variar mucho en tamaño y a veces son parte de meta-estudios o se subdividen en subproyectos para gestionar mejor sus cientos o miles de despliegues (p. ej., Snapshot USA). Describa los proyectos a un nivel que tenga sentido. ¿Es posible identificar a una persona que puede tomar decisiones o responder preguntas sobre el proyecto? ¿Es fácil describir la metodología? Si la respuesta a estas preguntas es no, entonces sería mejor considerar esos proyectos como separados. Tenga también en cuenta que recomendamos fuertemente publicar datos a nivel del proyecto, es decir, un conjunto de datos por proyecto (ver la Sección 4).

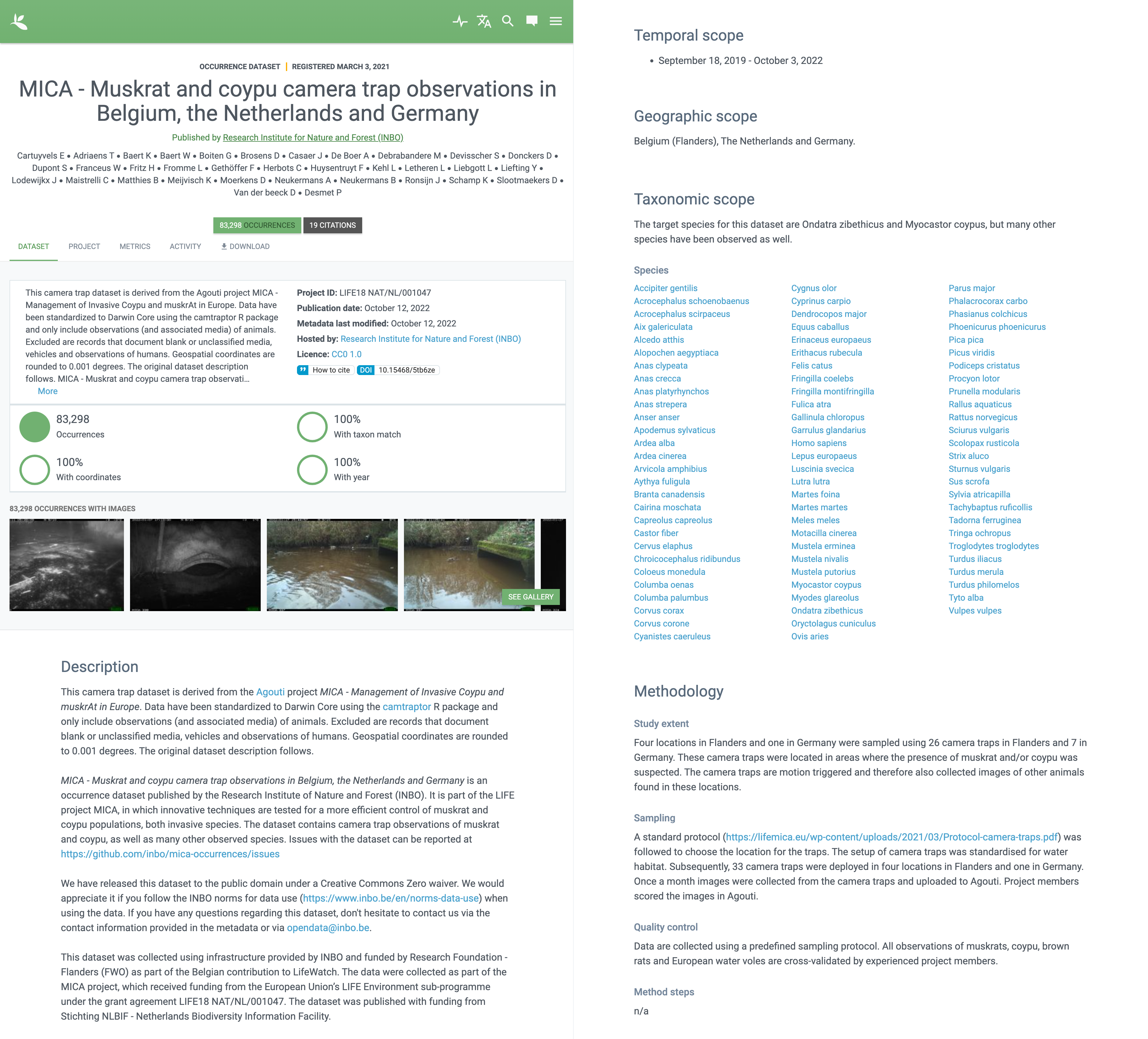

Cuando se publican, los metadatos del proyecto son una parte sustancial de los metadatos del conjunto de datos (ver la Figura 2), permitiendo que otros descubran su conjunto de datos cuando buscan ciertas palabras clave y evalúen si se ajusta a sus necesidades de investigación. Cuando describa su proyecto, piense en qué necesitarían los demás para entenderlo. Recomendamos cubrir los siguientes aspectos (pero no dejar que lo perfecto sea enemigo de lo bueno):

-

Título

-

Identificador y/o acrónimo

-

Descripción (incluyendo racionales)

-

Colaboradores y sus roles (incluyendo organizaciones)

-

Enlace al sitio web

-

Palabras clave

-

Financiación

-

Diseño de muestreo (simple aleatorio, sistemático aleatorio, etc.)

-

Resultado del ámbito geográfico

-

Método de captura (tipo de sensor, detección de movimiento y/o intervalo de tiempo)

-

Programas de captura (continuos, nocturnos, etc.)

-

Interrupciones de captura y eventos no planificados

-

Alcance temporal resultante

-

Método de clasificación (expertos, colaboración abierta, IA)

-

Granularidad y alcance de la clasificación (es decir, qué órganismos detectables fueron clasificados: todos los animales, solo mamíferos, únicamente individuos conocidos, etc.)

-

Alcance taxonómico resultante

-

Filtración de datos antes de la publication

Los sistemas de gestión de datos normalmente organizan esta información en las siguientes clases: proyecto, subproyecto, organización y participante (ver la Figura 1).

3.2.1. Participantes y roles

Un participante es una persona asociada a un proyecto de cámaras trampa. La información que se captura sobre un participante normalmente es su nombre, apellido, correo electrónico y ORCID. Los roles de un participante se definen en relación al proyecto (p. ej. investigador principal, persona de contacto) y organización (p. ej., investigador) (ver la Figura 1). Se utilizan diferentes nombres para roles similares (ver la Tabla 3). Recomendamos simplificarlos a un conjunto limitado de valores controlados (p. ej., package.contributors.role) al publicar datos.

| Camtrap DP | CTMS (Forrester et al. 2016) | Protocolo de metadatos de cámara de vida silvestre (Resources Information Standards Committee RISC 2019) | DataCite (DataCite Metadata Working Group 2021) | EML (GBIF Secretariat 2015) | Agouti (Casaer et al. 2019) | Wildlife Insights (Ahumada et al. 2020) |

|---|---|---|---|---|---|---|

contact |

Contacto del proyecto |

Coordinador del proyecto |

Persona de contacto |

Punto de contacto |

Coordinador del proyecto |

Dueño del proyecto |

principalInvestigator |

Investigador principal |

ProjectLeader |

Dueño |

Investigador principal |

Dueño del proyecto |

|

rightsHolder |

RightsHolder |

|||||

publisher |

Distribuidor |

Distribuidor Publicador |

||||

contributor |

Secuencia identificada por |

Miembro del equipo |

Gestor de datos |

Curador |

Administrador |

Editor del proyecto |

Otro |

Usuario Procesador Revisor Proveedor de metadatos |

Solo vista Simulado Esperando acceso |

Visor de proyecto |

3.3. Archivos multimedia

Los Media files son los datos crudos que recolecta una cámara trampa. Para la mayoría de los estudios de cámaras trampa, estas serán images (ver la Figura 3 para un ejemplo), pero las cámaras trampa modernas también pueden grabar otros tipos de medios, tal como video o sonido. Los videos pueden capturar el comportamiento animal con más detalle que las imágenes y a menudo son adecuados para su divulgación, pero requieren más batería, archivos de mayor tamaño y son más difíciles de procesar.

Un compromiso utilizado a menudo es tomar una serie de imágenes cuando se activa una cámara (por ejemplo, 10 imágenes, 1 segundo de separación). Cuando se procesan los archivos multimedia, esas imágenes relacionadas se pueden combinar en una secuencia. Una secuencia no solo combina imágenes resultantes de un solo disparo, también combina desencadenadores consecutivos que caen dentro de un independence interval preestablecido (p. ej., 120s). De esa manera, la actividad continuada se capturó en un solo secuencia/[event] (ver la Tabla 4).

Una cámara también graba metadatos al crear un archivo multimedia. Esto puede incluir fecha y hora, ajustes de la cámara (como velocidad de obturación, nivel de exposición, estado del flash) y otras propiedades. Para imágenes, esta información se almacena como parte del archivo y se expresa en el Formato de Archivo de Imagen Intercambiable (EXIF) (ver la Tabla 5). Los metadatos para videos son menos estandarizados, aunque algunos formatos como AVI y MOV soportan EXIF.

Los sistemas de gestión de datos normalmente organizan archivos multimedia y los metadatos asociados en las siguientes clases: multimedia, media type y secuencia (verFigura 1).

| Propiedad | Valor |

|---|---|

Tipo de archivo |

JPEG |

Tipo MIME |

imagen/jpeg |

Ancho de imagen |

2048 pixels |

Altura de imagen |

1440 pixels |

Resolución horizontal |

72 dpi |

Resolución vertical |

72 dpi |

Versión de EXIF |

0220 |

Marca |

RECONYX |

Modelo |

HYPERFIRE 2 COVERT |

Fecha y hora original |

2020:06:12T06:04:32Z |

Desplazamiento de la zona horaria |

N/D |

Tiempo de exposición / velocidad de obturación |

1/85 |

ISO |

200 |

Gama de color |

sRGB |

Flash |

Auto, activado |

Modo de exposición |

Auto |

Balance de blancos |

Manual |

Tipo de captura de escena |

Estándar |

3.3.1. Fecha y hora

La fecha y hora en que se registró un archivo multimedia es el aspecto más importante de sus metadatos. Esta información se utiliza para evaluar cuándo se observaron animales y no es posible encontrarlos más tarde (en contraste con, p. ej., la [location]). Dado que esta información se deriva del reloj interno de la cámara, es fundamental verificar que está configurado correctamente. Recomendamos ajustar el reloj a Coordinated Universal Time (UTC) o la hora local de invierno. Desactive el cambio automático al horario de verano y registre la zona horaria utilizada como parte del despliegue.

3.3.2. Nombre de archivo

Los archivos multimedia son administrados mejor por un data management system. Si usted mismo administra sus archivos multimedia, le recomendamos las siguientes convenciones de nombres de archivos y directorios:

-

Evite renombrar los nombres de los archivos multimedia. En su lugar, organice archivos multimedia en un directorio para cada despliegue. Esto también evita que los nombres de archivos crudos se superpongan de una cámara a otra. Tenga en cuenta que las rutas de archivos pueden ser utilizadas como identificadores en datos de clasificación.

-

Asegúrese de que ordenar los archivos alfabéticamente también los ordene cronológicamente. Este es ya probablemente el caso de nombres de archivo asignados secuencialmente (p. ej.,

IMG_4545.jpg). De lo contrario, inicie el nombre con la fecha (AAAAMMDD) o fecha y hora (AAAAMMDD_HHMMSS). Esto también puede ser útil para nombres de directorios. -

Si está nombrando archivos, use separación con guión bajo [snake case] (

imagen_1), separación con guión [hyphen case] (imagen-1) o separación por mayúsculas [camel case] (imagen1oarchivoVideo1) en lugar de espacio en blanco (imagen 1). Evite los caracteres especiales. -

No guarde información de clasificación como parte del nombre del archivo multimedia.

-

Sea consistente.

# Bien PICT0001.JPG 20200709_093352.JPG # Mal: no puede ser ordenado cronológicamente 09072020_093352. JPG # Mal: contiene información de clasificación 20200709_093352_Ardea_alba_1_Anas_platyrhynelig_macho_hembra.jpg # Mal: contiene espacios y caracteres especiales dep 2021 't WAD

3.3.3. Almacenamiento

Debido al gran volumen de datos generados, no es trivial almacenar, respaldar y gestionar archivos multimedia de forma segura. Se recomiendan servicios en la nube o servicios institucionales bien administrados, pero estos tienen un costo considerable. Recomendamos el uso de un data management system en línea para almacenar sus archivos multimedia. Algunos ofrecen este almacenamiento de forma gratuita. También es muy útil si su sistema de almacenamiento de datos puede servir archivos multimedia sobre http/https, usando stable URLs y opcionalmente autenticación. Esto le permite referenciar/enlazar directamente archivos multimedia en un conjunto de datos publicado (ver accessURI). Este servicio es proporcionado, por ejemplo, por Agouti (Casaer et al. 2019) (a través de https://multimedia.agouti.eu/assets/), Flickr [https://www.flickr.com/] (a través de https://www.flickr. om/servicios/api/) y en menor medida Zenodo [https://zenodo.org/] (limitado a 100 archivos a través del indocumentado https://zenodo.org/record/{record_id}/files/{file}).

3.4. Despliegues

Un despliegue es la colocación espacial y temporal de una cámara. Los despliegues finalizan retirando o reemplazando la cámara, cambiando su posición o cambiando su tarjeta de memoria. Los media files resultantes están asociados con ese despliegue y están mejor organizados como tal. La información de despliegue incluye [location], duración, alineación y ajustes de cámara y otras covariables como uso de cebo, tipo de características, hábitat, cobertura de dosel arbóreo, etc. (ver la Tabla 6). Esta información no es capturada por la cámara y debe registrarse manualmente. Tenga en cuenta que incluso la duración puede ser más larga que la fecha y hora del primer y último archivo de medios capturado.

Los sistemas de gestión de datos normalmente organizan despliegues en las siguientes clases: <deployment>>, [location], cámara, deployment group y subproyecto (ver la Figura 1).

| Propiedad | Valor |

|---|---|

ID de despliegue |

00a2c20d |

Fecha/hora de inicio |

2020-05-30T04:57:37+02:00 (= 2020-05-30T02:57:37Z) |

Fecha/hora de fin |

2020-07-01T11:41:41+02:00 (= 2020-07-01T09:41:41Z) |

ID de ubicación |

e254a13c |

Nombre de ubicación |

B_HS_val 2_processiepark |

Latitud |

51.496 |

Longitud |

4.774 |

Incertidumbre de coordenadas |

187 m |

Otra información de ubicación |

posición:arriba de arroyo |

Cámara configurada por |

anonimizado:3eb30aa |

ID de cámara |

320 |

Modelo de cámara |

Reconyx-HF2X |

Retraso de cámara |

0 s |

Peso de cámara |

1,30 m |

Profundidad de la cámara |

|

Inclinación de la cámara |

-15 ° |

Dirección de la cámara |

285 ° |

Distancia de detección |

3,20 m |

Problemas de fecha y hora |

falso |

Uso de cebo |

falso |

Hábitat |

Región de Campine con una serie de valles fluviales con praderas valiosas |

3.4.1. Nombre de columna

La información de despliegue se registra mejor en un data management system. Si administra su información de despliegue en otros lugares (por ejemplo, una hoja de cálculo), le recomendamos las siguientes convenciones para nombrar las columnas:

-

Utilice nombres descriptivos, para que los usuarios tienen una idea de qué información esperar.

-

Separar palabras usando guión bajo [snake case] (

ubicación_despliegue_1), guión [hyphen case](despliegue-ubicación-1) o mayúsculas [camel case] (despliegueUbicación1) en lugar de espacios (ubicación de despliegue 1). El uso del guión bajo garantiza el nivel de interoperabilidad más alto entre sistemas, el uso de la separación por mayúsculas se utiliza con mayor frecuencia en los estándares de datos. -

Evite abreviaturas para mitigar el riesgo de confusión, excepto con palabras conocidas como ID para identificador.

-

Evite incluir unidades y tipos de datos. Describa estos datos en otras partes (p. ej., en una hoja separada, documento README o Table Schema), junto con la definición de la columna y los valores controlados (ver la Tabla 7).

-

Sea consistente.

# Bien nombreCientífico despligue_grupo # Mal: contiene espacios nombre científico # Mal: abreviado desp_gr # Mal: nombres inconsistentes latitud y longitudcoordenadas # Mal: incluye unidades o tipos de datos altura_cámara_metros_doble

| Nombre de columna | Definición | Notas | Unidad | Tipo de datos | Requerido (s/n) |

|---|---|---|---|---|---|

deploymentID |

Identificador único del despliegue. |

Este identificador se genera automáticamente. |

cadena |

sí |

|

deploymentStart |

Fecha y hora en que comenzó el despliegue. |

Formateado como |

fecha y hora |

sí |

|

deploymentEnd |

Fecha y hora en que finalizó el despliegue. |

Formateado como |

fecha y hora |

sí |

|

latitude |

Latitud de la ubicación de despliegue. |

Usa el datum WGS84. |

grados decimales |

número |

sí |

longitude |

Longitud de la ubicación de despliegue. |

Usa el dato WGS84. |

grados decimales |

número |

sí |

cameraHeight |

Altura a la que se desplegó la cámara. |

metros |

número |

no |

|

cameraHeading |

Ángulo en el que la cámara fue desplegada en el plano horizontal. |

Los valores (0-360) comienzan en sentido horario desde el norte, por lo que 0 = norte, 90 = este, 180 = sur, 270 = oeste. |

grados decimales |

número |

no |

3.4.2. Localización

Una [location] es el lugar físico donde se encuentra una cámara durante un despliegue. Se puede describir con un nombre, identificador y/o descripción, pero recomendamos siempre registrar las coordenadas geográficas geographical coordinates. Estas se expresan más comúnmente como latitud y longitud en grados decimales, usando el datum WGS84 WGS84.

Las coordenadas se determinan mejor mediante un receptor GPS en la propia ubicación. Si esto no es posible, utilice recursos (en línea) y buenas prácticas de georeferenciación (Chapman and Wieczorek 2020) para obtenerlos. Además de las coordenadas y el datum geodésico (p. ej., WGS84) es importante registrar la incertidumbre de las coordenadas uncertainty of the coordinates, que se ve afectada por varios factores:

-

La extensión extent de la ubicación. Tenga en cuenta que para las cámaras trampa esto incluye la detection distance, que normalmente está entre 5 y 20 metros.

-

La precisión del receptor GPS o recurso de georreferencia. La mayoría de los receptores GPS tienen una precisión de 5 metros en áreas abiertas cuando utilizan cuatro o más satélites (Chapman and Wieczorek 2020). El dosel del bosque o la conexión satelital limitada pueden reducir la precisión. Google Maps u Open Street Maps tienen una precisión de 8m (Chapman and Wieczorek 2020).

-

La precisión de las coordenadas coordinate precision. Cuanto menos precisa (y más cerca del ecuador) mayor es la incertidumbre, p.ej., las coordenadas WGS84 con una precisión de 0,001 grados tienen una incertidumbre de 157 metros en el ecuador (ver la Tabla 3 Table 3 en Chapman and Wieczorek (2020)).

-

Un unknown datum. Esto puede ir de centímetros a kilómetros (Chapman and Wieczorek 2020), por lo que siempre es importante registrar el datum utilizado por el receptor GPS o el recurso de georeferenciación (WGS84 para Google Maps u Open Street Maps).

-

La incertidumbre máxima combinada se expresa de forma más conveniente como una incertidumbre de coordinación en metros, permitiendo que la ubicación se describa con el método punto-radiofónico.

La incertidumbre máxima combinada se expresa de forma más conveniente como una incertidumbre de coordenada en metros, permitiendo que la ubicación se describa con el método punto-radio point-radius-method.

La mayoría de las otras propiedades asociadas con una ubicación como país y estado, pero incluso elevación, pendiente, cubierta de tierra o índice de área de hoja, puede derivarse de las coordenadas utilizando un recurso en línea.

3.4.3. Modelo de cámara, ajustes y alineación

Dado que un despliegue se relaciona con la colocación de una cámara, es importante registrar información sobre su modelo, configuración y alineación. El modelo consiste en nombre del fabricante y el nombre del modelo (p. ej., Reconyx-PC800). Excepto para el quiet period, la mayoría de los ajustes de la cámara normalmente se registran automáticamente como parte de los metadatos EXIF. La detection distance puede variar mucho dependiendo del terreno y la vegetación, y se mide mejor en el campo haciendo que alguien se mueva delante de la cámara a diferentes distancias. La alineación es la colocación física de una cámara en espacio 3D. Consiste en camera height, camera depth, camera tilt y camera heading.

3.4.4. Grupos de despliegue

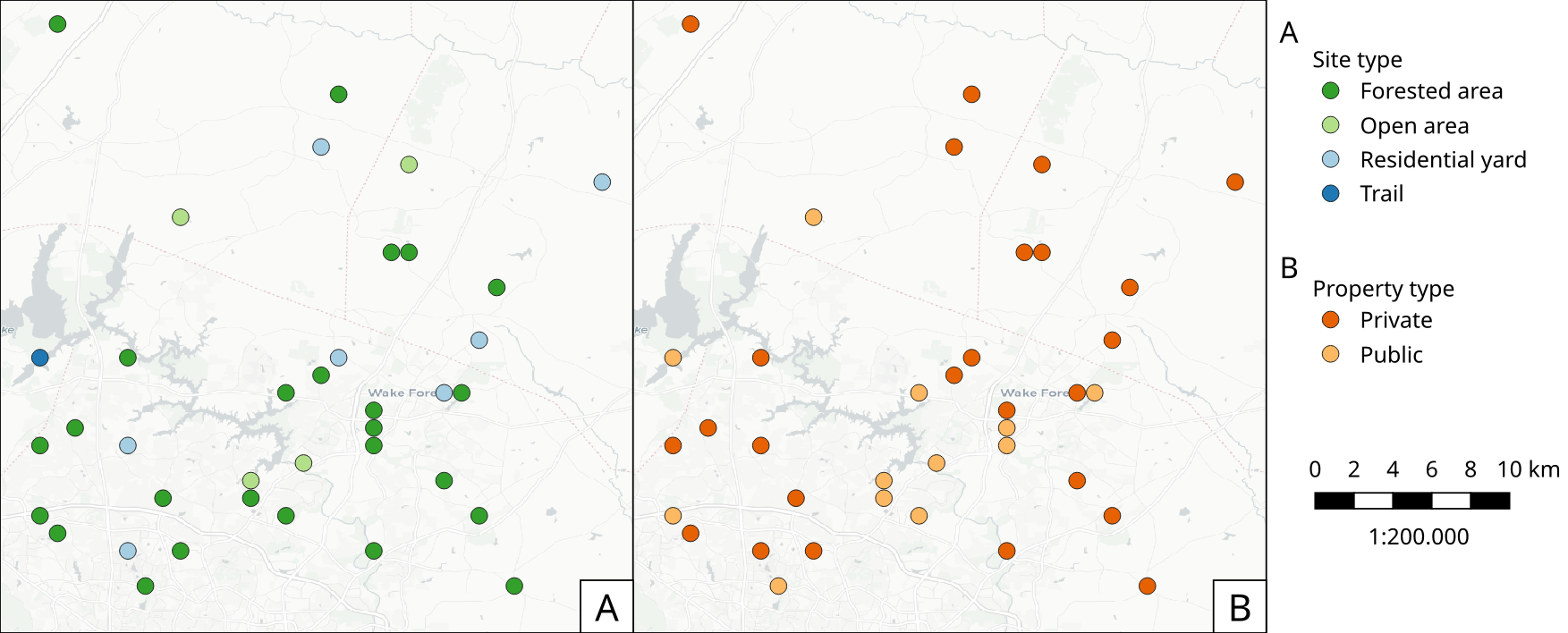

Puede ser útil categorizar despliegues en deployment groups para facilitar su gestión y análisis de datos. Un grupo de despliegue puede ser temático (p. ej., despliegue emparejado), espacial (p. ej. tierra privada, bosque abierto) o temporal (por ejemplo, verano de 2005) en la naturaleza (ver la Figura 4). Un solo despliegue puede pertenecer a cero o más grupos de despliegue. Los Subprojects son un tipo especial de grupo de despliegue utilizado para subdividir proyectos muy grandes que contienen muchos miles de despliegues. Esto facilita su gestión. Un solo despliegue puede pertenecer a un solo subproyecto.

3.4.5. Covariantes

Las covariantes son variables que pueden afectar el comportamiento y, por tanto, la detección de animales. Registrar estas variables es importante para un análisis más profundo de los datos. Bait, feature type y habitat type son covariables comúnmente registradas. El qué y el cómo registrar covariantes debe ser consistente dentro de un proyecto, pero normalmente no es así entre proyectos, a menos que formen parte de un estudio de investigación más amplio y bien coordinado. Para facilitar la interoperabilidad, recomendamos hacer uso de los sistemas de clasificación existentes para registrar covariables:

-

Biomas/ecorregiones (Dinerstein et al. 2017)

-

Características ecológicas:

-

COMBINE (Soria et al. 2021)

-

PanTHERIA (Jones et al. 2009)

-

EltonTraits (Wilman et al. 2014)

-

AmphiBIO (Oliveira et al. 2017)

-

GlobTherm (Bennett et al. 2018)

-

AVONET (Tobias et al. 2022)

-

-

Clasificación de hábitat (Jung et al. 2020)

-

Productos de cobertura del suelo (Yang et al. 2017; Amatulli et al. 2018) (http://www.earthenv.org)

-

Tipo de cobertura del suelo (Buchhorn et al. 2020)

-

Índice de área foliar (Law et al. 2008)

-

Producción primaria (Zhao et al. 2005)

-

Índice de rigidez del terreno (TRI) (Riley et al. 1999)

3.5. Observaciones

Las Observations son una interpretación de lo que se puede ver u oír en media files. Estas no se limitan a observaciones de especies, sino que también pueden indicar si el archivo de multimedia contiene un vehículo, un humano o un objeto desconocido, o que no se observó nada de interés (blanks). Por eso a veces también se les llama clasificaciones, anotaciones o identificaciones. El objetivo es típicamente registrar qué especies animales fueron observadas, incluyendo opcionalmente información sobre el tamaño de su grupo, la etapa de vida, el sexo y el comportamiento (ver la Tabla 8).

Las observaciones se registran de mejor manera en un data management system, que típicamente organiza observaciones en las siguientes clases: observación, observation type y secuencia (ver la Figura 1). Si administra su información de observación en otros lugares (p. ej., una hoja de cálculo), le recomendamos seguir las mismas column naming conventions para los despliegues.

| Propiedad | Valor |

|---|---|

ID de observación |

05230014 |

Tipo de observación |

animal |

ID de taxón |

GCHS |

Nombre científico |

Ardea cinerea |

Conteo |

1 |

Etapa de vida |

adulto |

Método de clasificación |

humano |

Clasificado por |

Peter Desmet |

Fecha y hora de clasificación |

2023-02-02T13:57:58Z |

3.5.1. Clasificación

Desafortunadamente, las cámaras trampa no proporcionan observaciones directamente. Los archivos multimedia necesitan ser classified para obtener observaciones. Este proceso se puede realizar en diferentes etapas y con diferentes niveles de precisión y granularidad:

-

El medio contiene o does not objetos de interés.

-

Los objetos de interés son humanos o vehículos, o no pueden ser identificados.

-

El objeto de interés es un animal, identificado a un nivel taxonómico alto (p. ej., un roedor).

-

Un animal se identifica a nivel de especie o subespecie (p. ej., Sus scrofa).

-

Un animal se identifica como un indivuduo conocido (por ejemplo, la loba Noëlla).

-

Se registran otras propiedades del animal, como el tamaño del grupo, la etapa de vida, el sexo y el comportamiento.

La clasificación puede ser hecha por humanos y/o máquinas. Estos actores (expertos, voluntarios, IA) pueden alcanzar diferentes niveles de precisión (ver la Tabla 9), en base a su experiencia (¿puedo llegar a tal precisión?) y esfuerzo (¿quiero llegar a tal precisión?). Dado que la clasificación puede ser muy intensiva en mano de obra para estudios más grandes, es mejor utilizar un enfoque que produzca los datos necesarios de manera eficiente. La ciencia ciudadana, la inteligencia artificial y/o los events de clasificación, más que los archivos multimedia individuales son los que pueden ayudar a acelerar el proceso (Green et al. 2020). Cualquiera que sea la técnica, recomendamos siempre registrar quién hizo la clasificación y qué tipo de técnica (humana vs máquina) fue utilizada.

| Nombre científico | sexo | conteo | comportamiento |

|---|---|---|---|

Anatidae |

4 |

||

Anas platyrhynchos |

4 |

||

Anas platyrhynchos |

macho |

1 |

foraging |

Anas platyrhynchos |

3 |

3.5.2. Ciencia ciudadana

Los Citizen scientists son voluntarios de la comunidad no científica que ayudan a los científicos en su trabajo. Pueden contribuir a los estudios de cámaras trampa de diversas maneras, como la colocación de cámaras y el cambio de tarjetas de memoria. En una práctica llamada colaboración abierta, los investigadores también pueden distribuir la tarea de classifying archivos multimedia, compartiéndolos en línea a una comunidad de científicos ciudadanos. Cada clasificación ayuda a confirmar o mejorar la opinión de la comunidad sobre las especies observadas (Swanson et al. 2015; Hsing et al. 2018).

La mayoría de los proyectos utilizan plataformas en línea establecidas para la colaboración abierta (Fortson et al. 2012; Swanson et al. 2015), (Chimp&See [https://www.zooniverse.org/projects/sassydumbledore/chimp-and-see?language=es]), tal como Zooniverse (Simpson et al. 2014), MammalWeb (Bradley 2017), Digivol (Alony et al. 2020) o DoeDat (Groom et al. 2018). Estas plataformas dan acceso a grandes bases de voluntariado ya existentes, lo que es especialmente importante si se necesitan clasificaciones en un plazo breve. Tenga en cuenta, sin embargo, que la gestión de un proyecto de ciencia ciudadana lleva tiempo y podría ser más conveniente para estudios más grandes. Además de subir archivos multimedia a una plataforma, esperar clasificaciones, descargar observaciones consensuadas y tratar con observaciones no consensuadas, necesita mantener a la comunidad comprometida y/o atraer nuevos miembros. También es importante excluir sensitive media del proceso, tales como los archivos multimedia que contienen humanos (para proteger su privacidad) y especies raras. Esto requerirá algún tipo de preprocesamiento, que es donde entra la inteligencia artificial (IA) (Weinstein 2018).

3.5.3. Inteligencia artificial

En el contexto de la investigación con cámaras trampa, la inteligencia artificial (IA) normalmente se refiere al uso de computer vision para la clasificación. Estos modelos de computadora son trained con conjuntos de datos ya clasificados y pueden procesar millones de archivos multimedia en una fracción del tiempo que le tomaría a un humano (Norouzzadeh et al. 2021). El campo ha sido testigo de avances significativos en los últimos años y ahora los modelos pueden filtrar registros en blanks y archivos multimedia que contienen humanos, reconocer especies, contar o rastrear individuos, así como reconocer animales individuales cite:[price-tack-2016,gomez-villa-2017,nguyen-2017,brides-2018,norouzzadeh-2020,yousif-2018. Salen modelos nuevos todos los años, pero es especialmente su incorporación en data management systems lo que aumentará su uso, especialmente por usuarios que no tienen experiencia en el aprendizaje automático. Como tal, es probable que la visión de computadora se convierta en la técnica dominante para clasificar los datos de las cámaras trampa en un futuro próximo.

Aun así, la visión informática no reemplazará por completo la clasificación humana, ya que se necesita un número grande y diverso de datos preprocesados para entrenar los modelos. Los conjuntos de datos de entrenamiento desequilibrados pueden producir un bajo rendimiento de los modelos, tales como conjuntos de datos de capacitación con un número muy variable de imágenes de cada especie, o pequeños conjuntos de datos geográficamente limitados. Además, la precisión de la clasificación de la visión informática sigue siendo actualmente secundaria a la de un experto humano. Por lo tanto, se recomienda una combinación de preprocesamiento con ayuda de la IA y verificación humana.

3.5.4. Clasificación basada en archivos multimedia o en eventos

Las clasificaciones pueden basarse en un único archivo multimedia (normalmente una imagen) o un [event] (normalmente una secuencia de imágenes). En esta última técnica, todos los archivos multimedia que pertenecen al [event] se evalúan como un todo para determinar la especie y su número de individuos. Esto consume menos tiempo para las clasificaciones humanas y puede dar lugar a mejores estimaciones del tamaño del grupo, ya que el número de individuos que pasan por una cámara puede ser mayor que los que se pueden ver en una sola imagen. La desventaja de la clasificación basada en eventos es que no es posible dividir la clasificación en eventos más cortos que el que se evalúa (lo mismo puede decirse de los vídeos clasificados como un todo). Estas clasificaciones tampoco pueden utilizarse para entrenar modelos informáticos, que requieren conjuntos de datos de entrenamiento basados en archivos multimedia.

Como resultado, los data management systems pueden favorecer una técnica sobre la otra, u ofrecer ambas. Los conjuntos de datos resultantes pueden incluir clasificaciones basadas en medios, basadas en eventos o ambos tipos de estas.

3.5.5. Nombres comunes o científicos

Los archivos multimedia pueden clasificarse usando nombres comunes (p. ej., zorro gris) o científicos (por ejemplo, Lycalopex gymnocercus) para taxones. Los nombres comunes (o vernáculos) son más fáciles de recordar y permiten una mejor participación del público. El inconveniente es que están sujetos a la traducción, pueden variar a nivel regional, a veces referirse a diferentes especies (p. ej. "elk" en Norteamérica se refiere a Cervus canadensis, mientras que en Europa se utiliza para Alces alces) y podría no existir para cada especie o combinación de lenguajes. Por otra parte, los nombres científicos siguen estrictas reglas nomenclaturales, son globalmente consistentes y no están sujetos a traducción. Por lo tanto, recomendamos siempre almacenar el nombre científico como parte de la observación, incluso si sólo se presentan nombres comunes al usuario.

La lista de nombres científicos disponibles para la clasificación en un proyecto se mantiene mejor en una única tabla de referencia. Esto facilita el manejo de la clasificación taxonómica y los nombres comunes asociados, y permite restringir las opciones de clasificación a aquellas especies que sea probable que aparezcan. Se pueden añadir más taxones si es necesario, pero sólo después de la verificación. Esta práctica es utilizada por la mayoría de los data management systems. Para completar la tabla de referencia, recomendamos utilizar una fuente autorizada (ver la Tabla 10) y almacenar los identificadores de taxón utilizados por esa fuente como referencia.

| Fuente | Covertura taxonómica | Usar para |

|---|---|---|

Todos |

Nombres científicos+

Nombres comunes (seleccionar idiomas) |

|

Registro Mundial de Especies Marinas (WoRMS) (WoRMS Editorial Board 2023) Especies marinas (no exclusivamente) |

Nombres científicos |

Wikipedia (versiones en inglés y en otros idiomas) |

Todos |

Nombres comunes (muchos idiomas) |

Lista de Clements de aves del mundo (Clements et al. 2022) |

Aves |

Nombres científicos |

|

Mamíferos |

Nombres científicos |

Base de datos de diversidad de mamíferos de la American Society of Mammalogists |

3.6. Sistemas de gestión de datos

La gestión de los datos de las cámaras trampa puede ser abrumadora, especialmente para proyectos más grandes. Afortunadamente, se han desarrollado varias herramientas de software y plataformas para ayudar a los investigadores con algunos o todos los aspectos de la gestión de datos de cámaras trampa (Young et al. 2018). Estas iniciativas a menudo fueron comenzadas por equipos de investigación para facilitar sus propias necesidades, pero algunos han llegado a ser sistemas completos que pueden ser utilizados por cualquiera. Discutimos y recomendamos cinco de ellos a continuación (ver la Tabla 11 para una visión general de sus características). Soportan todo el ciclo de vida de la gestión de datos de cámara trampa:

-

Crean uno o más proyectos

-

Invitan a collaborators con distintos niveles de acceso

-

Subir medios y crear despliegues

-

Classify archivos multimedia para observaciones, apoyados opcionalmente por AI y citizen science

-

Gestionan listas de referencias de especies, ubicaciones, covariantes, etc.

-

Incorporan al público haciendo que algunos o todos los metadatos del proyecto estén disponibles en un sitio web

-

Exportan datos en un formato estandarizado para análisis y publicación de datos

-

Archivan datos, incluyendo archivos multimedia

3.6.1. Agouti

Agouti (Casaer et al. 2019) (https://agouti.eu) es un sistema en línea para gestionar los datos de las cámaras trampa. Es mantenido por la Wageningen University & Research y el Instituto de Investigación para la Naturaleza y los Bosques (INBO), con sede respectiva en los Países Bajos y Bélgica. Agouti es utilizado principalmente por proyectos europeos y es de uso gratuito.

La clasificación se basa en eventos, pero las posiciones de los animales se pueden registrar a nivel del archivo multimedia, permitiendo registrar los datos necesarios para los análisis a distancia (Howe et al. 2017) y el modelado de encuentros aleatorios (Marcus Rowcliffe et al. 2011). La clasificación con IA es posible, utilizando un modelo específico de clasificación de especies que se actualiza regularmente. Los archivos multimedia que contienen seres humanos siempre están ocultos al público. Los datos se almacenan en la infraestructura universitaria, que también ofrece archivos a largo plazo y enlaces directos a los archivos multimedia. Los metadatos del proyecto pueden estar disponibles a través de un portal público. Los datos pueden ser exportados como Camtrap DP.

Agouti es una buena elección para las organizaciones que quieren un servicio europeo completo gratuito.

3.6.2. Camelot

Camelot (Hendry and Mann 2018) (https://camelotproject.org/) es un sistema local para gestionar los datos de las cámaras trampa. Se mantiene como una iniciativa de voluntariado con sede en Australia. Camelot es de uso gratuito, de código abierto, disponible para todos los principales sistemas operativos y requiere instalación. Normalmente se utiliza como una aplicación de escritorio local, pero puede configurarse en un servidor que permite a varios usuarios conectarse a través de su navegador. La clasificación es basada en archivos multimedia con la opción de clasificar múltiples archivos a la vez. No se ofrece clasificación por IA. Los datos pueden ser exportados en un formato personalizado.

Camelot es una buena opción para organizaciones e individuos que quieren una solución ligera que puedan gestionar por su cuenta.

3.6.3. TRAPPER

TRAPPER (Bubnicki et al. 2016) (https://os-conservation.org/projects/trapper) es un sistema en línea para gestionar los datos de las cámara trampa. Es mantenido por el Open Science Conservation Fund, radicado en Polonia. TRAPPER es utilizado principalmente por proyectos europeos y es de uso gratuito. El software es de código abierto y requiere instalación y alojamiento. La clasificación es basada en archivos multimedia con la opción de clasificar múltiples archivos a la vez. La clasificación por IA es posible, utilizando modelos de clasificación de especies existentes. Los datos pueden ser exportados como Camtrap DP.

TRAPPER es una buena opción para las organizaciones que quieren controlar el software y donde se almacenan sus datos.

3.6.4. Wildlife Insights

Wildlife Insights (Ahumada et al. 2020) (https://www.wildlifeinsights.org) es un sistema en línea para gestionar los datos de las cámaras trampa. Es mantenido por Conservación Internacional, Google y otros socios, con sede en los Estados Unidos. Wildlife Insights se utiliza principalmente en proyectos en América y utiliza un modelo de suscripción por categorías (incluyendo niveles gratuitos). Los archivos multimedia subidos se clasifican automáticamente a nivel de multimedia por IA, utilizando un modelo de clasificación específico desarrollado por Google. Los archivos multimedia que contienen seres humanos siempre están ocultos al público. La clasificación adicional tiene la opción de clasificar varios archivos a la vez. Los datos se almacenan en la nube, puede ser utilizado por Wildlife Insights para entrenar IA y debe hacerse público después de un período máximo de embargo de 48 meses. Los metadatos del proyecto siempre están disponibles a través de un portal público. Los datos pueden exportarse en un formato personalizado, basado en CTMS (Forrester et al. 2016).

Wildlife Insights es una buena opción para organizaciones que quieren un servicio completo con fuertes requisitos de IA y datos abiertos.

3.6.5. WildTrax

WildTrax (Bayne et al. 2018) (https://www.wildtrax.ca/) es un sistema en línea para gestionar los datos de las cámaras trampa. Es mantenido por la Universidad de Alberta, con sede en Canadá. WildTrax es utilizado principalmente por proyectos canadienses y es de uso gratuito (excepto para proyectos muy grandes). La clasificación es basada en archivos multimedia con la opción de clasificar múltiples archivos a la vez. La clasificación por IA es posible, pero sólo a un nivel amplio (blancos, animales, vehículos), la clasificación de especies (todavía) no se ofrece. Los datos se almacenan en la nube. Los metadatos del proyecto pueden estar disponibles a través de un portal público. Los datos pueden ser exportados en un formato personalizado (con el paquete R asociado).

WildTrax es una buena elección para organizaciones que quieren un servicio gratuito con sede en Canadá.

| Característica | Agouti | Camelot | TRAPPER | Wildlife Insights |

|---|---|---|---|---|

Proporcionado como |

Servicio |

Software |

Software |

Servicio |

Costo |

Gratuito |

Gratuito |

Gratuito |

Modelo de suscripción en niveles (incl. gratuito) |

Código abierto |

No |

Sí |

Sí |

No |

Supported media types |

Image, Video |

Image |

Image, Video |

Image |

Tipos de archivos soportados |

Sí |

Sí (limitado) |

Sí |

Sí |

Idiomas soportados |

Inglés, croata, neerlandés, francés alemán, polaco español |

Inglés |

Inglés |

Muchos (a través del traductor de Google) |

Clasificación basada en archivos multimedia o eventos |

Basada en eventos |

Basada en archivos |

Basada en archivos |

Basada en archivos |

Clasificación IA |

Sí (clasificación de especies) |

No |

Sí (clasificación de especies) |

Sí (clasificación de especies) |

Integración con plataforma de colaboración abierta |

Sí (Zooniverse) |

No |

Sí |

No |

Portal del proyecto |

Sí |

No |

No |

Sí |

Almacenamiento de datos |

Infraestructura universitaria |

Servidor propio |

Servidor propio o nube |

Nube (Google Cloud Platform) |

Derechos de datos otorgados al sistema |

Mínimo |

Ninguno |

Ninguno |

Algunos (p. ej., para del entrenamiento de la IA y productos de datos resumidos) |

Requisito de datos abiertos |

No (pero recomendado) |

No |

No (pero recomendado) |

Sí (los datos pueden mantenerse privados durante 48 meses, los metadatos del proyecto son siempre públicos) |

Servidor multimedia |

Sí |

No |

Sí |

Sí |

Formato de exportación |

Camtrap DP |

Formato personalizado |

Camtrap DP |

Formato personalizado |

4. Publicación de datos de cámaras trampa

La publicación de datos es el proceso de abrir los datos de biodiversidad y FAIR (Wilkinson et al. 2016). La adopción de los principios FAIR garantiza que los datos de sus cámaras trampa puedan encontrarse, consultarse, integrarse y reutilizarse (ver la Sección 4.1) para muchas aplicaciones, desde casos de uso biológico (modelo de distribución de especies, estimación de densidad de población, etc.) hasta proporcionar datos de capacitación para el desarrollo de modelos de machine learning. Recomendamos el uso de la Herramienta para la publicación integrada de datos (IPT) GBIF (Robertson et al. 2014) para hacerlo. Facilita la publicación de datos y el registro en el Centro de Información sobre la Biodiversidad Global (GBIF), una red internacional e infraestructura de datos para datos de biodiversidad.

Antes de publicar a través de GBIF, debe preparar (ver la Sección 4.2) y normalizar sus datos. La estandarización de datos es la transformación de datos a un data exchange format específico para que se vuelva interoperable con otros datos en GBIF. GBIF soporta Camtrap DP y Darwin Core Archive como los formatos de intercambio de datos de cámaras trampa. Las recomendaciones para estos formatos se proporcionan en la Sección 4.3 y la Sección 4.4 respectivamente.

Recomendamos encarecidamente publicar datos de cámaras trampa a nivel de proyecto, es decir, un conjunto de datos por proyecto. Esto hace más fácil describir el alcance, la metodología, los colaboradores, las fuentes de financiación, etc. en los metadatos. Para obtener una visión general sobre cómo publicar datos a GBIF, consulte GBIF Secretariat (2018).

4.1. Datos FAIR de cámara trampa

Imagínese que necesita añadir todas las observaciones de ratas almizcleras registradas en Bélgica en 2023. Hacerlo es difícil si los datos se encuentran dispersos en distintas fuentes y utilizan diferentes protocolos, nombres de campo e idiomas. Hacer estas fuentes de datos FAIR significa organizarlas de tal manera que todos (humanos y máquinas) puedan encontrarlas, usarlas, entenderlas y combinarlas.

La forma más fácil de hacer un conjunto de datos localizable es proporcionando metadatos significativos (p. ej. título, descripción y palabras clave) y depositarlo en un repositorio de investigación (como el IPT de GBIF (Robertson et al. 2014)). Los repositorios proporcionan funcionalidades de búsqueda de conjuntos de datos cruzados y asignarán a cada conjunto de datos un unique identifier para que pueda ser referenciado únicamente y accedido. Agregar una license abierta al conjunto de datos permitirá que los usuarios puedan acceder y reutilizar los datos (además de los metadatos), mientras que los rich metadata (p. ej., metodología) permitirán a los usuarios determinar si el conjunto de datos es adecuado para su propósito. El aspecto más desafiante es hacer un conjunto de datos interoperable para que pueda integrarse fácilmente con otros datos. Esto puede lograrse mediante el uso de estándares: repositorios de datos estandarizarán los metadatos y se puede utilizar Camtrap DP para estandarizar los datos. Ver también Bubnicki et al. (2023) (sección "Is Camtrap DP FAIR?") para más información sobre cómo Camtrap DP permite el intercambio de datos FAIR.

4.2. Preparar datos

4.2.1. Identificadores únicos estables

Términos como deployments.deploymentID o dwc:occurrenceID [dwc:IDocurrencia] esperan un identificador que:

-

Se requiere que sea único, es decir, se refiere de forma única a un registro o concepto.

-

Se recomienda firmemente que sea estable/persistente, es decir, no cambia con el tiempo y puede ser referenciado con seguridad.

-

Se recomienda que sea único globalmente, es decir, se refiera de forma única a un registro o concepto en un contexto global.

Si está disponible, recomendamos utilizar el identificador asignado por el data management system, tal como esté. Estos identificadores serán únicos, muy probablemente estables, y a veces únicos a nivel global (por ejemplo, un UUID). También permiten a los usuarios (con acceso) buscar el registro en el sistema de gestión de datos. Recomendamos no añadir elementos al identificador para hacerlo único globalmente, ya que esto lo hace más propenso al cambio. Dado que los conjuntos de datos pueden ser identificados de forma única (p. ej., con un DOI), es suficiente si el identificador es único dentro del conjunto de datos.

4.2.2. Información sensible

Los datos de las cámaras trampa pueden contener información sensible, como información personal (p. ej., nombres o imágenes de personas vivas), la ocurrencia de las especies sensibles (p. ej., raras o en peligro de extinción), las ubicaciones de cámaras gestionadas de manera activa, o incluso notas y comentarios no destinados al público. Recomendamos seguir las buenas prácticas en Chapman (2020), que favorecen la generalización sobre la restricción del registro en su conjunto.

Datos personales

Los datos personales son cualquier información relacionada con una persona viva identificada o identificable. Esta información está sujeta a regulaciones como RGPD. En los datos de la cámara trampa, los datos personales son los nombres de los participants, sus direcciones de correo electrónico y el lugar donde están los participantes que configuraron la cámara (identificable combinando el nombre con la fecha de despliegue y la [location]). En Camtrap DP, los nombres de las personas pueden aparecer en package.contributors, package.bibliographicCitation, deployments.setupBy y observations.classifiedBy. En Darwin Core Archive, los nombres de las personas pueden aparecer en los metadatos y términos como dwc:identifiedBy.

Recomendamos contactar a los participantes para preguntar si su información personal puede hacerse pública y anonimizarla (p. ej., anonymized:3eb30aa) o excluirlo cuando prefieran no hacerlo. Algunos data management system (como Casaer et al. (2019)) permite a los usuarios indicar sus preferencias y anonimizar automáticamente sus datos personales en las exportaciones. Tenga en cuenta que puede no ser posible eliminar permanentemente información personal de versiones antiguas de un conjunto de datos ya publicado.

Archivos multimedia sensibles

Los Media files que contienen personas identificables son una forma de personal data que deben ser identificados y mantenidos privados para proteger la privacidad de las personas. Esto puede ser necesario para archivos multimedia que contienen vehículos o la configuración de la imagen de cámara. Es posible que los archivos multimedia que contienen especies sensibles deban mantenerse privados si se puede identificar la ubicación.

Recomendamos proporcionar la URL a todos los archivos multimedia (en media.filePath or ac:accessURI), pero regulando su acceso a nivel de proveedor (p. ej., https://multimedia.agouti.eu/assets/813bafb2-befe-45fa-b0e3080f1f019a70/file). El acceso esperado puede describirse en media.filePublic o ac:serviceExpectation ac:serviceExpectation. Tenga en cuenta que en un Darwin Core Archive, las observaciones (y los archivos multimedia) de los humanos, los vehículos, la configuración, etc. son típicamente excluidos.

Información de ubicación sensible

Los datos de la cámara trampa pueden contener información de [location] de especies sensibles. Las ubicaciones de cámaras gestionadas de forma activa también pueden ser sensibles al vandalismo y el robo. Recomendamos seguir a Chapman (2020) para determinar la sensibilidad (Capítulo 2) y elegir una generalización apropiada.

|

Tenga en cuenta que la información de ubicación de las cámaras trampa es a menudo la misma a través de múltiples deployments. Generalizar las coordenadas del despliegue con información sensible asociada probablemente no es suficiente para prevenir análisis correlacionales. Una deployments.locationID compartida por múltiples despliegues, por ejemplo, puede llevar a deducciones de localidades/registros que están generalizados. Asegúrese de generalizar las coordenadas para la [location] a través de despliegues. |

Cualquiera que sea el nivel seleccionado de generalización, documéntelo en los metadatos del conjunto de datos y términos apropiados, de modo que los usuarios estén al tanto. Ver la Tabla 12 para un ejemplo.

| Término de Camtrap DP | Término de Darwin Core | No generalizado | Generalizado |

|---|---|---|---|

51.18061 |

51.181 |

||

5.65490 |

5.655 |

||

implícito |

EPSG:4326 |

EPSG:4326 |

|

30 |

187 |

||

0.00001 |

0.001 |

||

fuente asumida como GPS, incertidumbre predeterminada a 30 m |

fuente asumida como GPS, incertidumbre predeterminada a 30 m |

||

coordenadas redondeadas a 0,001 grados |

Otra información sensible

Los campos de texto como comentarios y notas (p. ej., deployments.deploymentComments o dwc:occurrenceRemarks) pueden contener información sensible como person names, sensitive location information o información no destinada al público. Recomendamos verificar valores y generalizar donde sea necesario (ver Capítulo 3 en Chapman (2020)).

4.3. Camptrap DP

Recomendamos el uso del Camera Trap Data Package (Camtrap DP) para publicar datos de cámaras trampa. Está diseñado específicamente para este tipo de datos y puede retener más información que un Darwin Core Archive (Bubnicki et al. 2023). Algunos data management systems lo soportan directamente como formato de exportación (ver la Tabla 11), lo que reduce la necesidad de transformación de datos al publicar a través de GBIF.

Consulte el sitio web de Camtrap DP para ver definiciones de términos, recomendaciones y ejemplos.

No toda la información en un Camtrap DP publicado está actualmente cosechada por GBIF. El modelo de datos GBIF requiere que se transforme a Darwin Core antes de la ingesta. Este proceso es proporcionado por la función write_dwc() en el paquete de software R camtraptor (Oldoni et al. 2023). Esta función implementa las recommendations sugeridas en este documento. GBIF podrá procesar más información a partir de un Camtrap DP publicado una vez que haya implementado un nuevo modelo de datos (GBIF Secretariat 2022).

4.4. Archivo Darwin Core

4.4.1. ¿Por qué no un conjunto de datos de eventos de muestreo?

Con sus eventos jerárquicos (despliegues, secuencias) y observaciones resultantes, parece lógico para expresar datos de cámara trampa como https://www. bif.org/sampling-event-data[Datos de muestreo de evento] con un Event core (ver la Tabla 13) y una Occurrence extension (ver la Tabla 14). Nos permite proporcionar información detallada (aunque repetida) sobre cada tipo de evento y ofrece la posibilidad de añadir una Measurement Or Facts extension con alineación y otra información (principalmente pertinente para el despliegue).

Desafortunadamente también nos impide expresar información sobre los archivos multimedia como una extensión, ya que el diseño de un esquema estrella de Darwin Core Archive no permite relacionar la Occurrence extension con una Audubon Media Description extension. Es técnicamente posible vincular la Audubon Media Description extension con el Event core, pero los archivos no estarían enlazados a las ocurrencias y no aparecerían en páginas de ocurrencia en GBIF.org. La única opción disponible para expresar información sobre los medios en un nivel de ocurrencia sería utilizar dwc:associatedMedia, que lo reduciría a una (lista de) URL. No se puede proporcionar licencia, tipo multimedia, método de captura, cajas de delimitación, etc.

| eventType | eventID | parentEventID | eventDate | Location information |

|---|---|---|---|---|

despliegue |

00a2c20d |

2020-05-30T02:57:37Z/ 2020-07-01T09:41:41Z |

51.496, 4.774 |

|

secuencia |

79204343 |

00a2c20d |

2020-06-12T04:04:29Z/ 2020-06-12T04:04:55Z |

51.496, 4.774 |

multimedia |

e68deaed |

79204343 |

2020-06-12T04:04:29Z |

51.496, 4.774 |

multimedia |

c5efbcb3 |

79204343 |

2020-06-12T04:04:30Z |

51.496, 4.774 |

| occurrenceID | eventID | scientificName | associatedMedia |

|---|---|---|---|

e68deaed_2 |

e68deaed |

Anas platyrhynchos |

https://multimedia.agouti.eu/assets/e68deaed-a64e-4999-87a3-9aa0edf5970d/file |

c5efbcb3_2 |

c5efbcb3 |

Anas platyrhynchos |

https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

05230014 |

79204343 |

Ardea cinerea |

https://multimedia.agouti.eu/assets/e68deaed-a64e-4999-87a3-9aa0edf5970d/file | https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

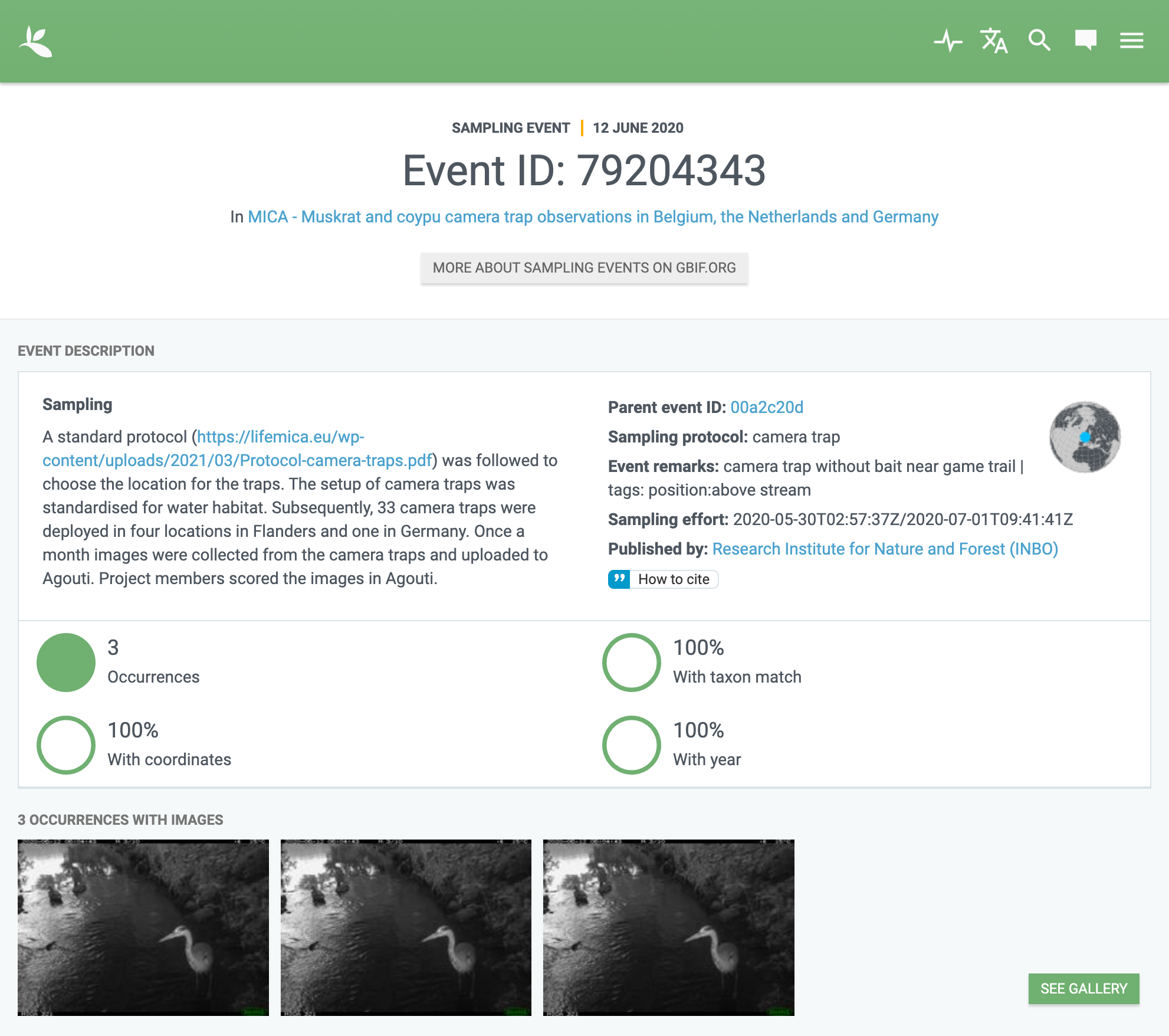

Por lo tanto, recomendamos expresar los datos de las cámaras trampa como un conjunto de datos de Ocurrencia con un Occurrence core y una Audubon Media Description extension (ver la Tabla 15 y la Tabla 16). Esto trata a los archivos multimedia como registros de datos primarios, que es importante dado que son la evidencia en la que se basan las observaciones. La jerarquía de eventos también se puede retener en gran medida, ya que el Occurrence core permite agrupar ocurrencias en eventos (dwc:eventID) y eventos originales (dwc:parentEventID). Al proporcionar el identificador [event]/secuencia en dwc:eventID e identificador de despliegue en dwc:parentEventID, las observaciones pueden agruparse como lo harían en un Event core y GBIF.org creará automáticamente páginas de eventos para ellos (ver la Figura 5). Sin embargo, la información sobre la duración del evento no se puede proporcionar, pero la eventDate y el samplingEffort pueden retener la mayor parte de ella. La información sobre la ubicación de despliegue, el hábitat, el protocolo de muestreo, etc. se repite para cada observación en el despliegue.

Recomendaciones de términos para el Occurrence core y Audubon Media Description extension se proporcionan en la Sección 4.4.2 y en la Sección 4.4.3 respectivamente.

| occurrenceID | eventID | parentEventID | scientificName | eventDate | Location information |

|---|---|---|---|---|---|

e68deaed_2 |

79204343 |

00a2c20d |

Anas platyrhynchos |

2020-06-12T04:04:29Z |

51.496, 4.774 |

c5efbcb3_2 |

79204343 |

00a2c20d |

Anas platyrhynchos |

2020-06-12T04:04:30Z |

51.496, 4.774 |

05230014 |

79204343 |

00a2c20d |

Ardea cinerea |

2020-06-12T04:04:29Z/ 2020-06-12T04:04:55Z |

51.496, 4.774 |

| occurrenceID | identifier | accessURI | CreateDate | captureDevice | rights |

|---|---|---|---|---|---|

e68deaed_2 |

e68deaed |

https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

2020-06-12T04:04:29Z |

Reconyx-HF2X |

|

c5efbcb3_2 |

c5efbcb3 |

https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

2020-06-12T04:04:30Z |

Reconyx-HF2X |

|

05230014 |

e68deaed |

https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

2020-06-12T04:04:29Z |

Reconyx-HF2X |

|

05230014 |

c5efbcb3 |

https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

2020-06-12T04:04:30Z |

Reconyx-HF2X |

4.4.2. Núcleo de registro

Como se describe above, recomendamos usar un Occurrence core para expresar los datos de cámaras trampa como un Darwin Core Archive. Ver la Tabla 17 para recomendaciones de términos. Estas recomendaciones se alinean con los requisitos de calidad de GBIF para los conjuntos de datos de Ocurrencia (GBIF Secretariat 2020) y utilizan la misma terminología (Requerido, Muy recomendable, Compartir si está disponible).

Tenga en cuenta que el Occurrence core sólo debe contener animal observations, de modo que las clasificaciones blanks, vehículos y preferiblemente los humans sean filtradas. El número de registros dependerá del tamaño del estudio, el esfuerzo de clasificación (¿todos los archivos están clasificados?), la precisión de clasificación (ver la Tabla 9) y si se utilizó una media- or event-based classification. Especialmente las clasificaciones basadas en los archivos multimedia pueden aumentar sustancialmente el número de ocurrencias con pocos beneficios adicionales para la investigación ecológica. Camtrap DP está diseñado para ambos, pero al publicar como un Darwin Core Archive, solo recomendamos proporcionar observaciones basadas en eventos si están disponibles.

| Término | Estado | Valor de ejemplo |

|---|---|---|

Compartir si está disponible |

Imagen estática |

|

Compartir si está disponible |

||

Compartir si está disponible |

INBO |

|

Compartir si está disponible |

7cca70f5-ef8c-4f86-85fb-8f070937d7ab |

|

Compartir si está disponible |

Agouti |

|

Compartir si está disponible |

Muestra de: MICA - Observaciones de las cámaras trampa sobre ratas almizcleras y nutrias en Bélgica, Países Bajos y Alemania |

|

Requerido |

MachineObservation |

|

Compartir si está disponible |

coordinates rounded to 0.001 degree |

|

Requerido |

05230014 |

|

Muy recomendado |

1 |

|

Compartir si está disponible |

||

Compartir si está disponible |

adulto |

|

Compartir si está disponible |

||

Muy recomendado |

presente |

|

Compartir si está disponible |

||

Compartir si está disponible |

||

Muy recomendado |

79204343 |

|

Muy recomendado |

00a2c20d |

|

Requerido |

2020-06-12T04:04:29Z/2020-06-12T04:04:55Z |

|

Compartir si está disponible |

Área de Campine con una serie de valles fluviales con praderas valiosas |

|

Muy recomendado |

cámara trampa |

|

Compartir si está disponible |

2020-05-30T02:57:37Z/2020-07-01T09:41:41Z |

|

Compartir si está disponible |

cámara trampa sin cebo cerca sendero de animales |

|

etiquetas:posición:arriba arroyo |

Compartir si está disponible |

|

e254a13c |

Compartir si está disponible |

|

B_HS_val 2_processiepark |

Compartir si está disponible |

|

Compartir si está disponible |

||

Compartir si está disponible |

||

1.30 |

Compartir si está disponible |

|

1.30 |

Muy recomendado |

|

51.496 |

Muy recomendado |

|

4.774 |

Muy recomendado |

|

EPSG:4326 |

Muy recomendado |

|

187 |

Compartir si está disponible |

|

0.001 |

Compartir si está disponible |

|

Peter Desmet |

Compartir si está disponible |

|

2023-02-02T13:57:58Z |

Compartir si está disponible |

|

clasificado por un humano |

Compartir si está disponible |

|

Requerido |

||

Ardea cinerea |

Muy recomendado |

type

La naturaleza del recurso. Utilice StillImage si el registro se basa en una imagen o secuencia de imágenes, MovingImage si se basa en un video. Uno también puede usar el término más amplio Imagen para todos los registros.

licencia

La licencia bajo la cual se comparte el registro de datos. Probablemente esta será la misma licencia que la utilizada para el conjunto de datos pero es posible desviar (Waller 2020). Para permitir un uso amplio, recomendamos publicar datos bajo una exención Creative Commons Zero y proporcionarlo como una URL: https://creativecommons.org/publicodomain/cero/1.0/legalcode. En Camtrap DP, este término corresponde a la ruta de la licencia que tiene los datos del ámbito en el package.licenses, aunque allí se especifica para el conjunto de datos en lugar de por registro.

rightsHolder

La persona u organización (es decir, participante) que posee o gestiona los derechos sobre el recurso. Con toda probabilidad, la organización que decidió bajo qué licencia se publican los datos y/o el editor de los datos (es decir, la organización seleccionada como editora al registrar un conjunto de datos con GBIF). Utilice un acrónimo si la organización tiene uno. En Camtrap DP, este término corresponde con el título del colaborador que tiene el rol tendedordeDerechos en package.contributors.

datasetID & datasetName

Respectivamente el identificador y el nombre del conjunto de datos. Para dwc:datasetID recomendamos usar una URL o identificador estable que permita a los usuarios encontrar información sobre el conjunto de datos/estudio de origen. En orden de preferencia: conjunto de datos DOI (https://doi.org/10. 5468/5tb6ze), estudio URL (http://n2t. et/ark:/63614/ w12001317), o identificador de estudio utilizado por el data management system. En Camtrap DP, este término corresponde con package.id, a menos que haya un identificador mejor disponible (p. ej., un DOI). dwc:datasetName debe referirse al título del conjunto de datos/estudio como se refiere por dwc:datasetID. Recomendamos usar el mismo valor para el título en los metadatos. En Camtrap DP, este término corresponde con package.title.

collectionCode

El nombre o acrónimo que identifica la recolección o conjunto de datos de los que se derivó el registro. Tradicionalmente se utiliza para indicar una colección física, recomendamos proporcionar el nombre del data management system (es decir, colección virtual) de la que derivó el registro. Esto permite a los usuarios buscar registros del mismo sistema de gestión de datos a través de conjuntos de datos. Valores recomendados: Agouti, Camelot, eMammal, Trapper, Wildlife Insights, etc. En Camtrap DP, este término corresponde al título de la fuente (aplicable) en package.sources.

basisOfRecord

La naturaleza específica del registro. Establecer en MachineObservation para todos los registros. Mientras que los humanos deciden cuándo y cuándo desplegar una cámara trampa, y los humanos o las máquinas (IA) pueden classify archivos, la captura del registro es realizada por una máquina que responde a un sensor. Esto es críticamente diferente de las observaciones humanas, donde un humano controla activamente la decisión de registrar o no un organismo.

dataGeneralizations

Las acciones emprendidas para hacer que los datos publicados sean menos específicos o completos que en su forma original. Recomendamos describir concisamente aquí qué sensitive information del registro fue generalizada y cómo. Tenga en cuenta que esta información se puede proporcionar a nivel de registro y no necesita aplicarse a todo el conjunto de datos. Si la información importante fue omitida por completo, utilice dwc:informationWithheld.

Ejemplos:

coordenadas redondeadas a 0,001 grados nombre científico generalizado a género

occurrenceID

Un identificador para la observación. Utilice un istable unique identifier. En Camtrap DP, este término se corresponde con observations.observationID.

individualCount