奥付

推奨される引用表記

Reyserhove L, Norton B & Desmet P (2023) Best Practices for Managing and Publishing Camera Trap Data. GBIF Secretariat: Copenhagen. https://doi.org/10.35035/doc-0qzp-2x37

貢献者

Tanja Milotic と Pieter Huybrechts は序論および図に貢献した。

翻訳

ライセンス

カメラトラップデータの管理および公開のベストプラクティスは、クリエイティブ・コモンズの表示-継承 4.0 国際ライセンスの下に提供される。

1. 序論

1.1. なぜこのガイドブックを作成したか

カメラトラップは、自然生態系の半自動モニタリングのための強力な技術として普及しました。その成功により、世界中でカメラトラップデータが急増しています。ここで直面する課題は、大量のデータが分類、解釈、アーカイブの順番待ちになっていることです。データ収集よりもデータ管理がカメラトラップ研究の制約要因となっています。カメラトラップのプロジェクトが増加したことで、用語、分類方法、データ管理の実践が多様化し、透明性、相互運用性、プロジェクト間の協力やメタ分析の分野が遅れをとっています。大規模で相互接続されたリモートカメラのネットワークは、信頼性の高いリアルタイムの生物多様性モニタリングと意思決定のための手段として役立つものですが、データを統合できない限り、カメラトラップ研究の本領を発揮できません。カメラトラップデータがオープンでFAIR(見つけられる、アクセスできる、相互運用できる、再利用できる、Wilkinson et al. (2016)を参照)であることを求められるのは、このためです。そうすることで、現在および将来に応用できる貴重なデータとして、人間も機械も利用できるようになります。

カメラトラップデータの最適な(再)利用のためには、ベスト・プラクティスのガイドラインが必要です。カメラトラップ研究のライフサイクルの一部または複数の要素(計画、技術と手法、研究デザイン、データ収集、分析、データ管理方法、データ公開)を扱うガイドがいくつか存在します(O’Connell et al. 2011; Rovero et al. 2013; Meek et al. 2014; Cadman et al. 2014; Burton et al. 2015; Wearn and Glover-Kapfer 2017)。ガイドが出版されてからこれまでの間に、カメラトラップのコミュニティは大きな進歩を遂げました:

-

主にプロジェクトとデータの管理のため、専用のデータ管理プラットフォームが使用されるようになりました。

-

人工知能(AI)とクラウド・コンピューティングが種の自動判別に使用されることが増えています。いずれは、ほとんどの記録メディアに適用されるでしょう。

-

Biodiversity Information Standards(TDWG)の下で開発されたデータ交換形式 Camtrap DPによって、データ変換が促進されています。オープンサイエンス、FAIRデータ(Wilkinson et al. 2016)、およびプライバシー規制に対する意識向上が見られます。

カメラトラップデータの管理と公開にのみ焦点を当てた最新のガイドラインは存在しません。このガイドは、そのギャップを埋めることを目的としています。

1.2. 読者の対象

このガイドは、カメラトラップ研究の管理に携わる全ての方に役立つことを意図しています。特にデータ管理と公開に焦点を当てるため、データ管理者、データ出版者、データベースおよび情報管理者、また、生物多様性情報学に携わる学生などにとって非常に有用です。

このガイドの著者は、主に中型から大型の陸生哺乳類を対象とした従来のカメラトラップの経験を持ちますが、多くの推奨事項やCamtrap DP標準は、他のタイプのカメラトラップのデータにも適用できるはずです。

2. カメラトラップの利用

2.1. カメラトラップとは?

カメラトラップは、野生動物の活動の静止画(images)や動画(videos)を自動的に撮影するためにフィールドに設置される記録装置です。ゲームカメラ、トレイルカメラ、スカウティングカメラとも呼ばれます。メディアへの記録は、定期的な間隔(タイムラプス)、または動物の活動を感知して行われます。従来のカメラトラップは人感赤外線(PIR)センサー (Hobbs and Brehme 2017)を使用して中型から大型の陸生哺乳類を記録するために設計されたものを指しますが、その他のタイプとして、海洋環境や昆虫などを記録するためのカメラトラップも存在します。衛星、ドローン、GPSトラッカー、音響センサーと同様に、カメラトラップは機械による観測を行います。特に音響センサーは、静止画や動画ではなく音声を使用して周囲の生態系をモニタリングする点で、カメラトラップと非常に似ています。これらの技術は全て、人間による観察では困難な規模と頻度でデータを収集できるという利点があり、通常、人間によるバイアス、解釈および干渉の影響を受けにくいです。

2.2. なぜカメラトラップが使用されるのか?

野生動物への影響を最小限に抑えた非侵襲的な方法で生物多様性データを収集するため、過去数十年にカメラトラップの利用が拡大してきました。初期の1890年代には、ジョージ・シラスがトリップワイヤーとフラッシュシステムを開発し、野生動物が自分自身を撮影する方法を最初に考案しました(Kucera and Barrett 2011)。最初の科学的なカメラトラップ研究は20世紀初頭にさかのぼります(Chapman 1927)。これらの先駆的な時を経て、デジタル写真と赤外線センサーの技術革新により、費用対効果が高く、捕獲しにくい野生動物の非侵襲的検出が可能になりました(Burton et al. 2015)。カメラトラップは人気のある研究ツールとなり、設置が簡単で比較的安価であり、特別な許可や訓練を必要としないため、専門家の研究者や愛好家によって非常に広範囲で使用されています。その結果、カメラトラップ研究に関する年間の出版物の数は1990年代以来80倍以上に増加しました。カメラトラップ技術は、淡水、陸上、地下、樹上、海洋のハビタットに生息する中型から大型の哺乳類や鳥類の個体群をサンプリングするために使用されており、生物多様性モニタリングの取り組みを支援するツールとして優れていることが証明されています(Delisle et al. 2021)。

最も頻繁に研究される動物分類群は、有蹄類、肉食動物、霊長類、鳥類などが挙げられますが、最も革新的なセンサーでは、小型哺乳類、両生類、爬虫類、魚類、無脊椎動物の検出も可能です(Hobbs and Brehme 2017)。カメラトラップ技術は、オカレンスデータや、種のアバンダンス、密度、多様性、および分布(表 1)のデータを収集すること、また、活動パターンや人間の干渉に対する反応など、行動に関する質問に答えることに適しています。さらに、カメラトラップは種の観察において選択的ではないため、種間相互作用の研究によく使用されます。特定の種を対象とした研究で得られた「混獲」データは、他の研究にも役立つ可能性があります。また、カメラトラップは、遠隔地やアクセスが困難な地域における希少種および絶滅危惧種のモニタリングによく使用されます。

| 研究目的 | 結果 | 主要な文献 |

|---|---|---|

アバンダンス |

密度 |

Sollmann et al. (2012); Tobler and Powell (2013); Rowcliffe et al. (2008); Rowcliffe et al. (2016) |

アバンダンス |

相対的なアバンダンス |

Rowcliffe et al. (2008); Wearn et al. (2013); Cusack et al. (2015) |

分布 |

占有率 |

Mackenzie and Royle (2005); Guillera-Arroita et al. (2010); O’Brien (2010); Shannon et al. (2014) |

多様性 |

ベータ多様性 |

|

多様性 |

多様度指数 |

|

多様性 |

豊富さ |

|

種の在データ |

種のチェックリスト |

2.3. カメラトラッププロジェクトのライフサイクル

カメラトラップ研究の全ライフサイクルには、計画段階、フィールドでのカメラトラップの設置、データの収集、管理、分析および共有が含まれます。このガイドの目的は、カメラトラッププロジェクトのライフサイクルの側面を全て網羅することではありません。このベストプラクティスガイドは、データの管理と公開に焦点を当てています。カメラトラップ研究の一般的なレビュー、計画段階、フィールドでのカメラトラップの設置に興味がある読者のために、利用可能なリソースの概要を提供しています(表 2を参照)。

| トピック | 内容 | 文献 |

|---|---|---|

カメラトラップのライフサイクル全般 |

一般的な最新技術 |

Cadman et al. (2014); Rovero and Zimmermann (2016); Wearn and Glover-Kapfer (2017); Meek et al. (2020); Glover‐Kapfer et al. (2019) |

計画 |

どのようにカメラトラップ研究をデザインするか? |

Wearn and Glover-Kapfer (2017); Rovero et al. (2010); Sunarto et al. (2013); Meek et al. (2014); Kays et al. (2020); Caravaggi et al. (2020); Hobbs and Brehme (2017); McIntyre et al. (2020) |

設置と収集 |

どこにどのようにカメラを取り付けるか? |

Wearn and Glover-Kapfer (2017); Rovero et al. (2010); Rovero et al. (2013); Meek et al. (2014) |

データ管理および共有 |

データ管理の検討事項 |

|

分析 |

データ分析のソフトウェア |

カメラトラップのデータセットを有用にするためには、計画段階で目的と目標を明確に定義する必要があります:どの生物種グループから何を知りたいのか?目的によって考慮すべき特性が決まります。具体的には、カメラの高さと方向、季節性、餌の使用、検出ゾーンの特徴、カメラの設定、トリガーとフラッシュの種類などです。これらの特性は、後続する分析に有用となるように、公開されたデータセットに含める必要があります。このトピックに興味がある読者には、表 1の主要な参考文献を参照することを推奨します。さらに、Wearn and Glover-Kapfer (2017)は、より一般的なカメラトラップ調査デザインの側面について包括的な概要を提供しています。

3. カメラトラップデータの管理

カメラトラップがフィールドで稼働すると、プロジェクトの期間中に数百、数千、さらには数百万枚の写真(静止画)や動画を生成することができます。最終的には、これらのデータを分析する必要があります。しかし、最初にデータを取り出し、保存し、整理し、ラベル付けする必要があります。静止画の内容は、手動または機械的に、解釈やアノテーションを付ける必要があります。これらの全てのステップがデータ管理のプロセスに含まれます。

データ管理はカメラトラップ研究で現実に生じるボトルネックの一つです。メモリーカードに保存された膨大な情報を扱うには、人間の労力と時間の面でたくさんの投資が必要です。データの保存と分類が遅れると、大量のデータが未使用のままになり、最終的には失われてしまいます。手動での抽出、整理、ラベル付けは人為的ミスを引き起こし、データの損失につながる可能性があります。さらに、プロジェクトの焦点である単一の対象種(グループ)やトピックよりも、多くの情報が静止画や動画に含まれていることがよくあります。カメラトラップは本質的に複数の種を検出するものであり、非対象種の観察記録は他の研究目的に価値のあるデータを提供します。非対象種を含む全てのデータにアノテーションが付けば、より投資に見合った成果を得ることができます(Young et al. 2018; Wearn and Glover-Kapfer 2017)。

結論として、全ての研究者はデータ衛生に注意を払うべきです。基本的な考え方は、文書化が不十分な100件よりも、よく文書化された10件がよい、ということです。このようにして初めて、カオス状態の生の静止画データを、有用な定量データに変えることができます。

このセクションでは、データ管理データに関する一般的な規則を紹介します。カメラトラップデータとは何かを詳しく掘り下げます。カメラトラップデータの各タイプ(メタデータ、メディア、設置、観察)を最適に管理する方法と、その支援のために使用できるデータ管理プラットフォームに焦点を当てます。

3.1. カメラトラップデータとは何か

直感的に、カメラトラップデータはカメラによって撮影されたメディアファイルと関連付けられます。しかし、これらを研究に使用するためには、追加情報と共に文書化する必要があります。観察された種を知るためにメディアファイルを分類する必要があります。いつ、どこで、その種がどれくらい観察されやすいかを知るために、カメラの設置、期間、場所、アライメント、サンプリング方法に関する情報が必要です。最後に、研究の範囲や携わった人物を知るため、プロジェクト/研究全体の情報が必要です。

まとめると、カメラトラップデータには以下の4つのタイプがあります:

これらのデータは、個人の好みや使用するデータ管理システムに基づき、さまざまな方法で整理されますが、カメラトラップデータの「モデル」を構成する、いくつかのコアとなる概念(以下、クラスと呼ぶ)を特定することができます(図 1参照)。これらのクラスは、プロジェクト、組織、参加者、設置、場所、デバイス、メディア、シーケンス、観察です。

0| はゼロまたは1つ、 0< はゼロから多数、 |< は1つから多数、 || はちょうど1つを意味する。例えば、deploymentにはゼロから多数のmediaがあり、mediaはちょうど1つのdeploymentに属す。3.2. プロジェクトのメタデータ

プロジェクトメタデータは、カメラトラッププロジェクト/研究全体を文書化します。誰が関わったのか、何が根拠であったのか、どのようなサンプリング方法が使用されたのか、そして研究範囲は何であったか?プロジェクトはさまざまな規模で実施され、時にはメタ研究の一部であったり、数十万もの設置をより適切に管理するためのサブプロジェクトに分割されていたりします(例. Snapshot USA)。意味が伝わるレベルで、プロジェクトを記述してください。プロジェクトに関する決定を下したり、質問に答えたりすることのできる人物は特定できますか?方法論を簡単に説明できますか?これらの質問に対する答えが「いいえ」の場合、それらを別々のプロジェクトと見なす方が良いかもしれません。また、プロジェクトレベルでデータ公開することを強く推奨します。すなわち、1つのプロジェクトに対して1つのデータセットです(Section 4参照)。

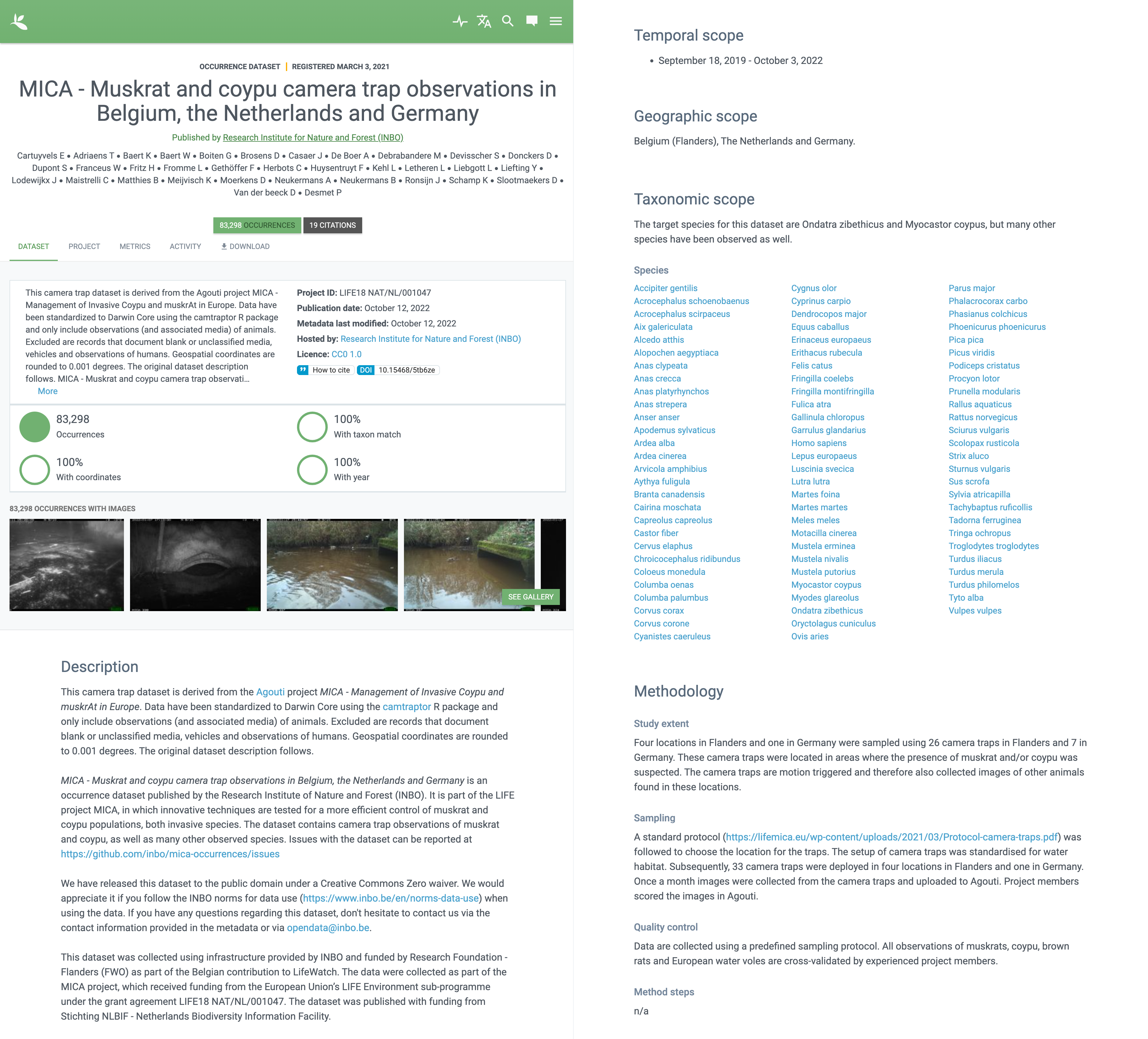

公開されると、プロジェクトメタデータはデータセットメタデータの重要な部分になります(図 2参照)。これによって、他の人が特定のキーワードで検索した際に、データセットを見つけ、その人の研究ニーズに適しているかどうかを見極めることができます。プロジェクトを説明する際には、他の人が理解するために何が必要かを考えてください。以下の側面をカバーすることを推奨します(ただし、完璧主義に陥らないように):

3.2.1. 参加者と役割

参加者とは、カメラトラッププロジェクトに関連する人物のことです。参加者に関して通常記録される情報には、名前、姓、メールアドレス、ORCIDが含まれます。参加者の役割は、プロジェクト(例. 主任研究員、問い合わせ先)および組織(例. 研究者)に関連して定義されます(図 1参照)。同様の役割に対して異なる名称が使用されることがあります(表 3参照)。データを公開する際には、あらかじめ決められた一連の制御値に簡略化することを推奨します(例. package.contributors.role)。

| Camtrap DP | CTMS (Forrester et al. 2016) | Wildlife camera metadata protocol (Resources Information Standards Committee RISC 2019) | DataCite (DataCite Metadata Working Group 2021) | EML (GBIF Secretariat 2015) | Agouti (Casaer et al. 2019) | Wildlife Insights (Ahumada et al. 2020) |

|---|---|---|---|---|---|---|

問い合わせ先 |

ProjectContact |

Project Coordinator |

ContactPerson |

Point of Contact |

Project coordinator |

Project Owner |

主任研究員 |

PrincipalInvestigator |

ProjectLeader |

Owner |

Principal investigator |

Project Owner |

|

権利者 |

RightsHolder |

|||||

出版者 |

Distributor |

Distributor Publisher |

||||

貢献者 |

sequenceIdentifiedBy |

Crew Member |

DataManager |

Curator |

Admin |

Project Editor |

Other |

User Processor Reviewer Metadata Provider |

View only Dummy Awaiting access |

Project Viewer |

3.3. メディアファイル

メディアファイルは、カメラトラップが収集する生データです。ほとんどのカメラトラップ研究では、静止画を指しますが(例えば、図 3の通り)、最新のカメラトラップは動画や音声など他のタイプのメディアも記録できます。動画は、静止画よりも動物の行動を詳細に捉えることができ、アウトリーチに適していますが、多くのバッテリー電力を必要とし、ファイルサイズも大きく、処理が難しいです。

よく使われる妥協策は、カメラがトリガーされたときに一連の静止画を撮影することです(例. 1秒間隔で10枚の静止画)。メディアファイルを処理する際に、関連する静止画をシーケンスにまとめることができます。シーケンスは、単一のトリガーから生じる静止画だけでなく、設定した独立間隔(例. 120秒)内に収まる連続したトリガーもまとめられます。このようにして、継続的な行動が単一のシーケンス/イベント/に撮影されます(表 4参照)。

カメラはメディアファイルを作成する際にメタデータも記録します。これには、日付と時間、カメラの設定(シャッタースピード、露出レベル、フラッシュの状態など)およびその他のプロパティが含まれます。静止画の場合、この情報はファイルの一部として保存され、Exchangeable Image File Format(EXIF)で表現されます(表 5参照)。動画のメタデータはあまり標準化されていませんが、AVIやMOVなどの形式はEXIFをサポートしています。

| プロパティ | 値 |

|---|---|

ファイルタイプ |

JPEG |

MIMEタイプ |

image/jpeg |

静止画の幅 |

2048 pixels |

静止画の高さ |

1440 pixels |

水平解像度 |

72 dpi |

垂直解像度 |

72 dpi |

EXIFバージョン |

0220 |

メーカー |

RECONYX |

モデル |

HYPERFIRE 2 COVERT |

日時オリジナル |

2020:06:12T06:04:32Z |

タイムゾーンのオフセット |

N/A |

露光時間 / シャッタースピード |

1/85 |

ISO |

200 |

カラースペース |

sRGB |

フラッシュ |

Auto, Fired |

露出モード |

Auto |

ホワイトバランス |

Manual |

シーン撮影タイプ |

Standard |

3.3.1. タイムスタンプ

メディアファイルが記録された日付と時間は、そのメタデータの最も重要な側面です。この情報は動物が観察された時期を評価するために使用され、後で導き出すことはできません(例. 場所とは対照的に)。この情報はカメラの内部時計から取得されるため、正しく設定されているか確認することが重要です。時計を 協定世界時 (UTC) または現地の冬時間に設定することを推奨します。サマータイムへの自動切り替えを無効にし、使用したタイムゾーンを設置の一部として記録してください。

3.3.2. ファイル名

メディアファイルはデータ管理システムで管理するのが最適です。もし自分でメディアファイルを管理する場合、以下のファイルおよびディレクトリの命名規則を推奨します:

-

メディアのファイル名の変更は避けてください。むしろ、設置ごとに1つのディレクトリを用意し、その中でメディアファイルを整理してください。これにより、カメラ間でRAWファイル名が重複するのを防ぎます。ファイルパスが分類データの識別子として使用されることがあることに注意してください。

-

ファイルをアルファベット順に並べ、さらに時間順に並べてください。これは、順次割り当てられたファイル名において、すでにそうなっている可能性があります(例.

IMG_4545.jpg)。そうでない場合、名前を日付(YYYYMMDD)または日時(YYYYMMDD_HHMMSS)で始めてください。これはディレクトリ名にも有用です。 -

ファイル名を付ける場合は、スネークケース(

image_1)、ハイフンケース(image-1)、またはキャメルケース(image1またはvideoFile1)を使用し、空白(image 1)は避けてください。特殊文字も避けてください。 -

保存する際に、分類情報をメディアファイル名の一部として使用しないでください。

-

一貫性を保ってください。

# 良い PICT0001.JPG 20200709_093352.JPG # 悪い: 時系列で保存できない 09072020_093352.JPG # 悪い: 分類情報が含まれる 20200709_093352_Ardea_alba_1_Anas_platyrhynchos_male_female.jpg # 悪い: スペースおよび特殊文字が含まれる dep 2021 't WAD

3.3.3. ストレージ

生成されるデータの量が多いため、メディアファイルを安全に保存、バックアップ、および管理することは容易ではありません。クラウドサービスや適切に管理された機関サービスが推奨されますが、かなりのコストがかかります。メディアファイルを保存するため、オンラインのデータ管理システムの使用を推奨します。一部のサービスはストレージを無料で提供しています。また、データストレージシステムにおいて、http/https経由でメディアファイルを提供できると、安定したURL やオプションとしての認証が利用できるため、非常に便利です。これにより、公開されたデータセットの中で、直接メディアファイルを参照/ホットリンクすることができます(accessURIを参照)。このようなサービスは、例えばAgouti (Casaer et al. 2019) ( https://multimedia.agouti.eu/assets/ 経由)、Flickr ( https://www.flickr.com/services/api/ 経由)、および Zenodo(文書化されていない https://zenodo.org/record/{record_id}/files/{file} を用いる場合は最大100ファイルまで)によって提供されています。

3.4. 設置

設置とはカメラの空間的および時間的な配置のことです。設置は、カメラを取り外したり交換したり、位置を変更したり、メモリーカードを交換したりすることで終了します。結果として得られるメディアファイルは全てその設置に関連付けられ、そうすることで最適に整理されます。設置情報には、カメラの場所、期間、アライメント、設定、および他の共変量、例えば、餌の使用、特徴タイプ、ハビタット、樹冠被覆率など、が含まれます(表 6参照)。この情報はカメラによって記録されず、手動で記録する必要があります。期間は、最初と最後に撮影されたメディアファイルのタイムスタンプよりも長くなることに注意してください。

| プロパティ | 値 |

|---|---|

Deployment ID |

00a2c20d |

Start date/time |

2020-05-30T04:57:37+02:00 (= 2020-05-30T02:57:37Z) |

End date/time |

2020-07-01T11:41:41+02:00 (= 2020-07-01T09:41:41Z) |

Location ID |

e254a13c |

Location name |

B_HS_val 2_processiepark |

Latitude |

51.496 |

Longitude |

4.774 |

Coordinate uncertainty |

187 m |

Other location information |

position:above stream |

Camera set up by |

anonymized:3eb30aa |

Camera ID |

320 |

Camera model |

Reconyx-HF2X |

Camera delay |

0 s |

Camera height |

1.30 m |

Camera depth |

|

Camera tilt |

-15 ° |

Camera heading |

285 ° |

Detection distance |

3.20 m |

Timestamp issues |

false |

Bait use |

false |

Habitat |

Campine area with a number of river valleys with valuable grasslands |

3.4.1. カラム名

設置情報はデータ管理システムに記録するのが最適です。もし他の場所(例. スプレッドシート)で設置情報を管理する場合、以下の列名の命名規則を推奨します:

-

説明的な名前を使用することで、どのような情報を期待できるか、ユーザーが分かるようにします。

-

単語を区切る際にはスネークケース(

deployment_location_1)、ハイフンケース(deployment-location-1)、またはキャメルケース(deploymentLocation1)を使用し、空白(deployment location 1)は避けてください。スネークケースはシステム間の相互運用性が最も高く、キャメルケースはデータ標準で最もよく使用されます。 -

略語は混乱のリスクを軽減するために避けてください。ただし、識別子を示す

IDのように、よく知られている単語は例外です。 -

単位やデータ型を含めないでください。これらの情報は別の場所(例. 別のシート、READMEドキュメント、または テーブルスキーマ)で、列の定義や制御値と一緒に説明してください(表 7参照)。

-

一貫性を保ってください。

# 良い scientificName deployment_group # 悪い:スペースを含む scientific name # 悪い:略されている dep_gr # 悪い:一貫性のない名前 latitude & coordinatesLongitude # 悪い:単位またはデータ型を含む camera_height_meter_double

| 列名 | 定義 | 注釈 | 単位 | データタイプ | 必須 (yes/no) |

|---|---|---|---|---|---|

deploymentID |

Unique identifier of the deployment. |

This identifier is auto-generated. |

string |

yes |

|

deploymentStart |

Date and time at which the deployment started. |

Formatted as |

datetime |

yes |

|

deploymentEnd |

Date and time at which the deployment ended. |

Formatted as |

datetime |

yes |

|

latitude |

Latitude of the deployment location. |

Uses the WGS84 datum. |

decimal degrees |

number |

yes |

longitude |

Longitude of the deployment location. |

Uses the WGS84 datum. |

decimal degrees |

number |

yes |

cameraHeight |

Height at which the camera was deployed. |

meters |

number |

no |

|

cameraHeading |

Angle at which the camera was deployed in the horizontal plane. |

Values (0-360) start clockwise from north, so 0 = north, 90 = east, 180 = south, 270 = west. |

decimal degrees |

number |

no |

3.4.2. 場所

場所とは、設置中にカメラが配置される物理的な場所のことです。名前、識別子、および(または)説明で記述できますが、常に 地理座標を記録することを推奨します。これらは通常、WGS84測地系を使用して、10進度の緯度と経度として表現されます。

座標は、正に設置する場所でGPS受信機を使用して決定するのが最適です。これが不可能な場合は、(オンライン)リソースとジオリファレンスのベストプラクティス(Chapman and Wieczorek 2020) を使用して取得してください。座標と測地系(例. WGS84)に加えて、座標の不確実性を記録することが重要です。これはいくつかの要因によって影響を受けます:

-

GPS受信機またはジオリファレンスリソースの精度。ほとんどのGPS受信機は、4つ以上の衛星を使用して、開けた場所で5メートルの精度が得られます(Chapman and Wieczorek 2020)。森林の樹冠や衛星接続が制限されたときは精度を低下させる可能性があります。GoogleマップやOpen Street Mapsの精度は8メートルです(Chapman and Wieczorek 2020)。

-

座標の精度。精度が低いほど(赤道に近いほど)不確実性が高くなります。例えば、精度が0.001度のWGS84座標は、赤道で157メートルの不確実性があります(Chapman and Wieczorek (2020)の 表3 参照)。

-

不明な測地系。これはセンチメートルからキロメートルまでの範囲があり得るため (Chapman and Wieczorek 2020)、GPS受信機またはジオリファレンスリソースが使用する測地系(GoogleマップやOpen Street Mapsの場合はWGS84)を常に記録することが重要です。

-

統合された最大の不確実性は、メートル単位の座標不確実性として表現するのが最も便利であり、ポイント-半径法を使用して場所を記述することができます。

統合された最大の不確実性は、メートル単位の座標不確実性として表現するのが最も便利であり、ポイント-半径法を使用して場所を記述することができます。

その他の場所に関連する特性の多くは(国や州、標高、傾斜、土地被覆、葉面積指数など)、オンラインリソースを使用して座標から導き出すことができます。

3.4.4. 設置グループ

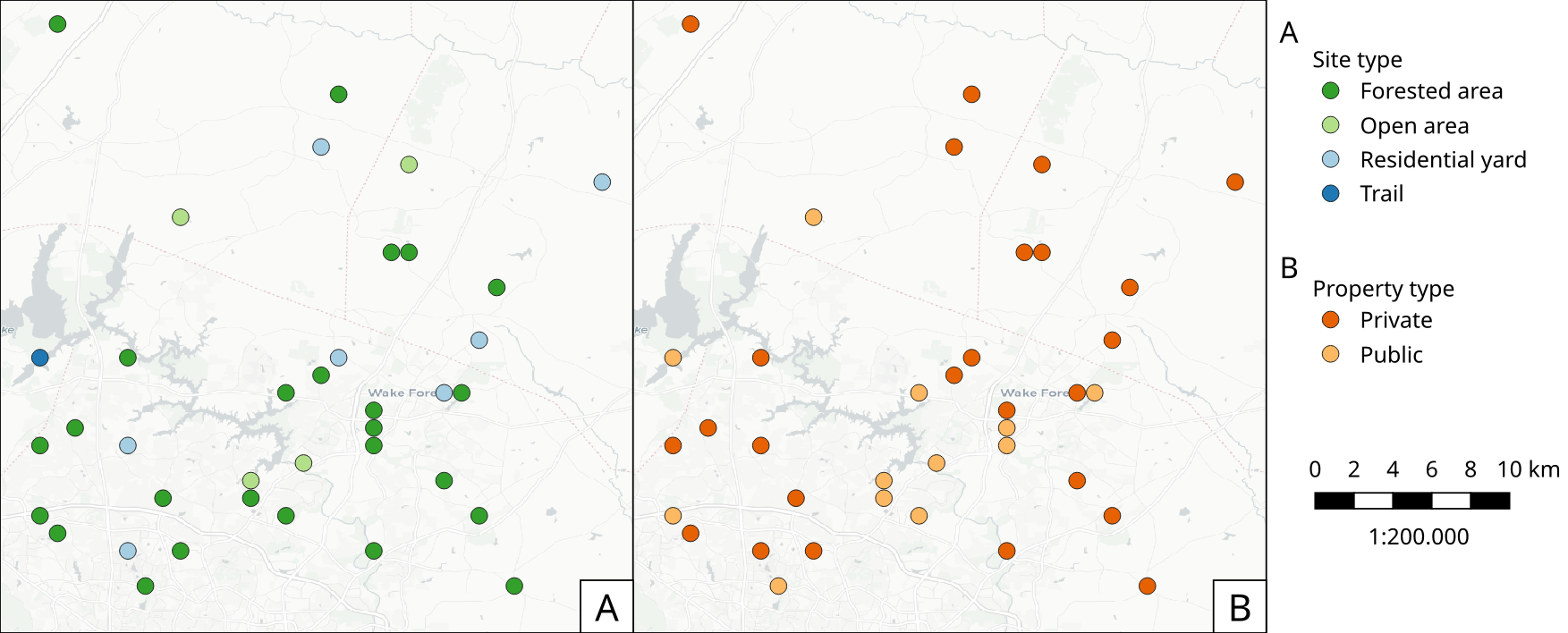

設置を設置グループに分類することは、データの管理と分析を容易にするために役立ちます。設置グループは、本質的に、テーマ別(例. ペアでの設置)、空間別(例. 私有地、開放林地)、または時間別(例. 2005年夏)に分類できます(図 4参照)。単一の設置は、0個以上の設置グループに属することができます。サブプロジェクトは、何千もの設置を含む非常に大規模なプロジェクトを細分化するために使用される特別な種類の設置グループです。これにより、管理が容易になります。単一の設置は、単一のサブプロジェクトに属することができます。

3.4.5. 共変量

共変量は、動物の行動に影響することで、動物の検出にも影響を与える可能性のある変数です。これらを記録することは、データのさらなる分析に重要です。餌、特徴タイプ、およびハビタットタイプは、一般的に記録される共変量です。共変量の記録方法と内容はプロジェクト内で一貫しているべきですが、プロジェクト間では通常異なります。ただし、よく調整された大規模な研究の一部である場合は例外です。相互運用性を支援するために、既存の分類システムを使用して共変量を記録することを推奨します:

-

バイオーム/エコリージョン (Dinerstein et al. 2017)

-

生態学的形質:

-

COMBINE (Soria et al. 2021)

-

PanTHERIA (Jones et al. 2009)

-

EltonTraits (Wilman et al. 2014)

-

AmphiBIO (Oliveira et al. 2017)

-

GlobTherm (Bennett et al. 2018)

-

AVONET (Tobias et al. 2022)

-

-

ハビタット分類 (Jung et al. 2020)

-

土地被覆プロダクト (Yang et al. 2017; Amatulli et al. 2018) (http://www.earthenv.org)

-

土地被覆タイプ (Buchhorn et al. 2020)

-

葉面積指数 (Law et al. 2008)

-

一次生産量 (Zhao et al. 2005)

-

地形の起伏度 (TRI) (Riley et al. 1999)

3.5. 観察

観察は、メディアファイル上で見えるまたは聞こえるものの解釈です。種の観察に限定されず、車両、人間、未知の物体がメディアファイルに含まれているか、または興味の対象が観察されなかったか(ブランク)、を示すこともできます。そのため、分類、アノテーション、または識別と呼ばれることもあります。目的は通常、観察された動物種を記録することであり、オプションでグループサイズ、ライフステージ、性別、および行動に関する情報を含めることができます(表 8参照)。

観察はデータ管理システムに記録するのが最適であり、通常、観察を次のクラスに整理します:観察、観察タイプ、およびシーケンスシークエンス(図 1参照)。観察情報を他の場所(例. スプレッドシート)で管理する場合は、設置と同じ列名命名規則に従うことを推奨します。

| プロパティ | 値 |

|---|---|

Observation ID |

05230014 |

Observation type |

animal |

Taxon ID |

GCHS |

Scientific name |

Ardea cinerea |

Count |

1 |

Life stage |

adult |

Classification method |

human |

Classified by |

Peter Desmet |

Classification timestamp |

2023-02-02T13:57:58Z |

3.5.1. 分類

残念ながら、カメラトラップは直接観察を提供しません。観察情報を得るためには、メディアを分類する必要があります。このプロセスは、異なるステップと異なるレベルの精度および粒度で実行できます:

-

メディアに興味のあるオブジェクトが含まれているか、含まれていないか。

-

興味の対象が人間または車両であるか、それとも識別できないか。

-

興味の対象が動物であり、高次分類群レベルで識別される(例. げっ歯類)。

-

動物が種または亜種レベルで識別される(例. Sus scrofa)。

-

動物が既知の個体として識別される(例. オオカミのNoëlla)。

-

動物の他の特性(グループサイズ、ライフステージ、性別、行動など)が記録される。

分類は人間および/または機械によって行うことができます。実行者(専門家、ボランティア、AI)は、専門知識(その精度に達することができるか?)と努力(その精度に達したいか?)に基づき、それぞれ異なるレベルの精度に到達することができます(表 9参照)。分類は大規模な研究では非常に労力がかかるため、必要なデータを効率的に得るための手段を用いることが最適です。市民科学者、人工知能、および/または、個々のメディアよりもイベントを分類することが、プロセスを迅速化するのに役立ちます (Green et al. 2020)。どの技術を使用する場合も、分類した人と使用した技術(人間 対 機械)を常に記録することを推奨します。

| 学名 | 性別 | 個体数 | 行動 |

|---|---|---|---|

Anatidae |

4 |

||

Anas platyrhynchos |

4 |

||

Anas platyrhynchos |

male |

1 |

foraging |

Anas platyrhynchos |

3 |

3.5.2. 市民科学

市民科学者は、科学コミュニティ外のボランティアであり、科学者の仕事を支援します。彼らは、カメラトラップ研究において、カメラの設置やメモリーカードの収集/交換など、さまざまな方法で貢献できます。クラウドソーシングと呼ばれる手法では、研究者はメディアの分類作業を市民科学者に分担してもらうことができます。その際には研究者が市民科学者のコミュニティにオンラインで提示することになります。各分類情報は、観察された種に関するコミュニティの意見を確認または改善するのに役立ちます (Swanson et al. 2015; Hsing et al. 2018)。

ほとんどのプロジェクトは、クラウドソーシングのために確立されたオンラインプラットフォームを使用しています (Fortson et al. 2012; Swanson et al. 2015)、(Chimp&See)、例えばZooniverse (Simpson et al. 2014)、MammalWeb (Bradley 2017)、Digivol (Alony et al. 2020)、またはDoeDat (Groom et al. 2018)などです。これらのプラットフォームは、既存の大規模なボランティアベースにアクセスできるため、短期間で分類が必要な場合に特に重要です。ただし、市民科学プロジェクトの管理には時間がかかることから、大規模な研究の方が有益である可能性があります。メディアをプラットフォームにアップロードし、分類されるのを待ち、合意された観察結果をダウンロードし、合意されていない観察結果に対処するだけでなく、コミュニティの活動を維持し、新しいメンバーを惹きつける必要があります。また、人間(プライバシーを保護するため)や希少種が含まれるメディアのような、機密性の高いメディアをその工程で除外することも重要です。何らかの前処理が必要となり、ここで人工知能(AI)が登場します (Weinstein 2018)。

3.5.3. 人工知能

カメラトラップ研究の文脈では、人工知能(AI)は通常、分類のためのコンピュータビジョンの使用を指します。コンピュータモデルは、既に分類されたデータセットで訓練されており、人間が処理するよりもずっと短時間で処理できます (Norouzzadeh et al. 2021)。この分野は近年大きな進歩を遂げており、モデルは、ブランクや人間を含むメディアを除外し、種を認識し、個体を数えたり追跡したり、動物個体を認識できるようになっています (Price Tack et al. 2016; Gomez Villa et al. 2017; Nguyen et al. 2017; Brides et al. 2018; Norouzzadeh et al. 2021; Yousif et al. 2018)。毎年新しいモデルが登場していますが、データ管理システムに組み込まれることによって、特に多く利用されるようになります。中でも、機械学習の経験がないユーザーによる使用が増加するでしょう。このようにして、コンピュータビジョンは近い将来、カメラトラップデータを分類する主要な技術になる可能性があります。

それでも、コンピュータビジョンは完全に人間による分類を置き換えることはありません。モデルを訓練するためには、大量で多様な前処理済みデータが必要です。不均衡な教師データセットは、モデルのパフォーマンスを低下させる可能性があります。具体的には、各生物種の静止画数が非常に変動するデータセットや、小規模で地理的に限定されたデータセットなどです。さらに、現時点においても、コンピュータビジョンの分類の精度は人間の専門家に比べると、二番手です。それゆえ、AI支援の前処理と人間による検証を組み合わせることが推奨されます。

3.5.4. メディアまたはイベント毎の分類

分類は、単一のメディアファイル(通常は静止画)またはイベント (通常は静止画シーケンス )に基づいて行うことができます。後者の手法では、イベントに属する全てのメディアファイルを全体として評価し、種と個体数を決定します。この手法は分類する人にとって時間の節約になり、カメラの前を通過する個体数が単一の静止画で見られるものよりも多いことがありうるため、より適切なグループサイズの推定につながる可能性があります。イベントベースの分類の欠点は、評価対象のイベントよりも短いイベントに分類を分割できないことです(動画を全体として分類する場合も同様です)。また、メディアベースの教師データセットを必要とするコンピュータモデルの訓練には、その分類を使用できません。

結果として、データ管理システムは一方の技術を他方より優先する場合もありますし、両方に対応している場合もあります。出来上がったデータセットは、メディアベース、イベントベース、またはその両方に応じた分類が含まれることになるでしょう。

3.5.5. コモンネームまたは学名

メディアは、分類群の一般名(例. ノロジカ)または学名(例. Capreolus capreolus)を使用して分類できます。一般名(または現地名)は覚えやすく、市民参加を促すにはよいでしょう。欠点としては、一般名が翻訳の対象であり、地域によって異なり、時には異なる種を指すことがあることです(例. 北アメリカでは「elk」は_Cervus canadensis_を指しますが、ヨーロッパでは_Alces alces_を指します)。また、一般名は全ての種や言語に対して存在するわけではありません。一方、学名は厳格な命名規則に従い、世界的に一貫しており、翻訳の対象にはなりません。そのため、ユーザーに一般名のみを提示する場合でも、観察情報の一部として学名を常に保存することを推奨します。

プロジェクトで分類に利用できる学名のリストは、単一の参照テーブルで管理するのが最適です。これにより、分類学的分類と関連する一般名の管理が容易になり、分類の候補を、出現する可能性のある種に制限できます。必要に応じて分類群を追加できますが、検証後のみ可能です。この方法は、ほとんどのデータ管理システムで使用されています。このような参照テーブルを作成するために、権威ある情報源(表 10参照)を引用し、出典を示した上で、使用されている分類IDを保存することを推奨します。

| 出典元 | 分類学的範囲 | 用途 |

|---|---|---|

全て |

学名 |

|

World Register of Marine Species (WoRMS) (WoRMS Editorial Board 2023) |

海洋生物(限定ではない) |

学名 |

Wikipedia (English and other language versions) |

全て |

一般名(多言語) |

Clements Checklist of Birds of the World (Clements et al. 2022) |

鳥類 |

学名 |

哺乳類 |

学名 |

|

哺乳類 |

学名 |

3.6. データ管理システム

カメラトラップデータの管理は、特に大規模なプロジェクトでは気が遠くなるような作業です。幸いなことに、研究者を支援するため、カメラトラップデータ管理の一部または全ての側面において多くのソフトウェアツールやプラットフォームが開発されています (Young et al. 2018)。このような取り組みは、研究チームが自分たちのニーズを満たすために開始されることが多いですが、誰でも使用できる成熟したシステムに成長したものもあります。そのうち、以下に示す5つのシステムについて議論し、推奨します(機能の概要については表 11を参照)。これらのシステムはカメラトラップデータ管理のライフサイクル全体をサポートします:

3.6.1. Agouti

Agouti (Casaer et al. 2019) (https://agouti.eu) は、カメラトラップデータを管理するためのオンラインシステムです。オランダのWageningen University & ResearchとベルギーのResearch Institute for Nature and Forest(INBO)によって維持されています。Agoutiは主にヨーロッパのプロジェクトで使用され、無料で利用できます。

分類はイベントベースですが、動物の位置はメディアレベルで記録できるため、距離分析 (Howe et al. 2017)やランダムエンカウンターモデリング (Marcus Rowcliffe et al. 2011)に必要なデータを記録できます。定期的に更新される専用の種分類モデルを利用することで、AI分類が可能です。人間を含むメディアは常に非公開になります。データは大学の基盤に保存されるため、長期アーカイブとメディアへのホットリンクも提供可能です。プロジェクトのメタデータは公共ポータルを通じて公開することができます。データはCamtrap DP形式でエクスポートできます。

Agoutiは、無料かつフル機能のヨーロッパを拠点とするサービスを求める組織にとって良い選択です。

3.6.2. Camelot

Camelot (Hendry and Mann 2018) (https://camelotproject.org/) は、カメラトラップデータを管理するためのローカルシステムです。オーストラリアを拠点とするボランティアの取り組みとして維持されています。Camelotは無料で利用でき、オープンソースであり、主要なオペレーティングシステムに全て対応しており、インストールが必要です。通常はローカルデスクトップアプリケーションとして使用されますが、サーバーにセットアップして複数のユーザーがブラウザ経由で接続できるようにすることもできます。分類はメディアベースで、一度に複数のメディアを分類するオプションがあります。AI分類は提供されていません。データはカスタム形式でエクスポートできます。

Camelotは、自分たちで管理できる軽量なツールを求める組織や個人にとって良い選択です。

3.6.3. TRAPPER

TRAPPER (Bubnicki et al. 2016) (https://os-conservation.org/projects/trapper) は、カメラトラップデータを管理するためのオンラインシステムです。ポーランドに拠点を置くOpen Science Conservation Fundによって維持されています。TRAPPERは主にヨーロッパのプロジェクトで使用され、無料で利用できます。このソフトウェアはオープンソースであり、インストールとホスティングが必要です。分類はメディアベースで、一度に複数のメディアを分類するオプションがあります。既存の種分類モデルを利用することで、AI分類が可能です。データはCamtrap DP形式でエクスポートできます。

TRAPPERは、ソフトウェアとデータの保存場所を管理したい組織にとって良い選択です。

3.6.4. Wildlife Insights

Wildlife Insights (Ahumada et al. 2020) (https://www.wildlifeinsights.org) は、カメラトラップデータを管理するためのオンラインシステムです。アメリカ合衆国に拠点を置くConservation International、Google、およびその他のパートナーによって維持されています。Wildlife Insightsは主にアメリカ大陸のプロジェクトで使用されており、段階的なサブスクリプションモデル(無料プランを含む)を採用しています。アップロードされたメディアは、Googleが開発した専用の種分類モデルを使用して、AIによってメディアレベルで自動的に分類されます。人間を含むメディアは常に非公開になります。さらに、複数のメディアを一度に分類するオプションもあります。データはクラウドに保存され、Wildlife InsightsによってAIの訓練に使用されることがあり、最大48か月のエンバーゴ期間後に公開されます。プロジェクトのメタデータは公共ポータルを通じて常に利用可能です。データはCTMS (Forrester et al. 2016)に基づき、カスタム形式でエクスポートできます。

Wildlife Insightsは、強力なAIとオープンデータ要件を備えたフル機能のサービスを求める組織にとって良い選択です。

3.6.5. WildTrax

WildTrax (Bayne et al. 2018) (https://www.wildtrax.ca/) は、カメラトラップデータを管理するためのオンラインシステムです。カナダに拠点を置くUniversity of Albertaによって維持されています。WildTraxは主にカナダのプロジェクトで使用されており、非常に大規模なプロジェクトを除き、無料で利用できます。分類はメディアベースで、一度に複数のメディアを分類するオプションがあります。AI分類も可能ですが、広範なレベル(ブランク、動物、車両)のみで、種の分類は(まだ)提供されていません。データはクラウドに保存されます。プロジェクトのメタデータは公共ポータルを通じて公開することができます。データはカスタム形式(関連するRパッケージ付き)でエクスポートできます。

WildTraxは、カナダに拠点を置く無料のサービスを求める組織にとって良い選択です。

| 機能 | Agouti | Camelot | TRAPPER | Wildlife Insights |

|---|---|---|---|---|

提供形態 |

サービス |

ソフトウェア |

ソフトウェア |

サービス |

コスト |

無料 |

無料 |

無料 |

段階的サブスクリプションモデル(無料含む) |

オープンソース |

いいえ |

はい |

はい |

いいえ |

サポートされるメディアタイプ |

静止画、動画 |

静止画 |

静止画、動画 |

静止画 |

複数のユーザーロール |

はい |

はい(限定) |

はい |

はい |

サポートされる言語 |

英語、クロアチア語、オランダ語、フランス語、ドイツ語、ポーランド語、スペイン語 |

英語 |

英語 |

多言語(Google翻訳による) |

メディアベースまたはイベントベースの分類 |

イベントベース |

メディアベース |

メディアベース |

メディアベース |

AI分類 |

はい(種分類) |

いいえ |

はい(種分類) |

はい(種分類) |

クラウドソーシングプラットフォームとの連携 |

はい(Zooniverse) |

いいえ |

はい |

いいえ |

プロジェクトポータル |

はい |

いいえ |

いいえ |

はい |

データストレージ |

大学の基盤 |

独自サーバー |

独自サーバーまたはクラウド |

クラウド(Googleクラウドプラットフォーム) |

システムに付与されたデータ権限 |

最小 |

なし |

なし |

一部(例. AI訓練、データ概要成果物) |

オープンデータ要件 |

なし(推奨ではある) |

なし |

なし(推奨ではある) |

あり(データは48ヶ月間は非公開、プロジェクトのメタデータは常に公開) |

メディアホスティング |

はい |

いいえ |

はい |

はい |

エクスポート形式 |

Camtrap DP |

カスタム形式 |

Camtrap DP |

カスタム形式 |

4. カメラトラップデータの公開

データ公開は、生物多様性データをオープンかつFAIR (Wilkinson et al. 2016)にするプロセスです。FAIR原則を採用することで、カメラトラップデータが見つかり、アクセスされ、統合され、再利用されることが保証されます(Section 4.1参照)。これにより、生物学的な使用例(種分布モデリング、個体数密度推定など)から機械学習モデル開発のための教師データの提供まで、幅広く応用されます。そのためには、GBIF Integrated Publishing Toolkit (IPT) (Robertson et al. 2014)の使用を推奨します。地球規模生物多様性情報機構(Global Biodiversity Information Facility: GBIF)は、生物多様性データのための国際ネットワークおよびデータ基盤であり、IPTを利用することで、GBIFでのデータ公開および登録を容易にします。

GBIFを通じて公開する前に、データを準備し(Section 4.2参照)、標準化する必要があります。データ標準化は、データを特定のデータ交換形式に変換し、GBIFの他のデータと相互運用可能にするプロセスです。GBIFは、カメラトラップデータのデータ交換形式としてCamtrap DPとDarwin Core Archiveをサポートしています。これらの形式に関する推奨事項は、それぞれSection 4.3 およびSection 4.4に記載されています。

カメラトラップデータはプロジェクトレベルで公開することを強く推奨します。すなわち、1つのプロジェクトに対して1つのデータセットです。これにより、メタデータで範囲、方法論、貢献者、資金提供源などを説明しやすくなります。GBIFへのデータ出版の一般的な概要については、 GBIF Secretariat (2018)を参照してください。

4.1. FAIRカメラトラップデータ

ベルギーで2023年に記録されたマスクラットの全ての観察を集約する必要があると想像してください。データがさまざまなソースに分散し、異なるアクセスプロトコル、フィールド名、言語を使用している場合、これを行うのは困難です。これらのデータソースをFAIRにするということは、誰も(人間と機械の両方)が、データを見つけ、使用し、理解し、組み合わせることができるように整理することを意味します。

データセットを見つけやすくする最も簡単な方法は、意味のあるメタデータ(例. タイトル、説明、キーワード)を提供し、研究リポジトリ(例えば、GBIF の場合は、IPT (Robertson et al. 2014))に格納することです。リポジトリはデータセット横断検索機能を提供し、各データセットに一意の識別子を割り当てるため、データセットを一意に参照およびアクセスできます。データセットにオープンライセンスを付与することで、ユーザーはメタデータに加えてデータにアクセスして再利用できるようになります。豊富なメタデータ(例. 方法論)は、データセットが目的に適しているかどうかをユーザーが判断するのに役立ちます。最も難しい側面は、データセットを他のデータと簡単に統合できるように相互運用可能にすることです。これは標準を使用することで達成できます。研究リポジトリはメタデータを標準化し、データを標準化するためにCamtrap DPが使用できます。Camtrap DPがどのようにしてFAIRデータ交換を可能にするか、に関する詳細は、Bubnicki et al. (2023)(「Is Camtrap DP FAIR?」のセクション)も参照してください。

4.2. データの準備

4.2.1. 安定した一意な識別子

deployments.deploymentID や dwc:occurrenceID のような用語は、以下のような識別子であることが求められます:

-

必須事項として、一意であること。すなわち、レコードや概念を一意に参照する。

-

強い推奨事項として、安定/永続的である。すなわち、時間が経っても変わらず、安全に参照できる。

-

推奨事項として、グローバルに一意である。すなわち、グローバルな文脈でレコードや概念を一意に参照する。

4.2.2. 機密情報

カメラトラップデータには、個人情報(例. 生きている人の名前や静止画)、センシティブな種(例. 希少種や絶滅危惧種)のオカレンス、積極的に管理されているカメラの位置、または公開を意図しないメモやコメントなどの機密情報が含まれている場合があります。Chapman (2020)のベストプラクティスに従い、レコード全体の制限よりも情報の一般化を推奨します。

個人情報

個人データとは、生きている人を特定または特定可能な関連情報を全て指します。この情報は、GDPRなどの規制対象となります。カメラトラップデータにおいて、個人データには参加者の名前、メールアドレス、およびカメラを設置した参加者の所在(名前と設置日時および場所を組み合わせることで識別可能)が含まれます。Camtrap DPでは、個人名はpackage.contributors、package.bibliographicCitation、deployments.setupBy、およびobservations.classifiedByに表示されることがあります。Darwin Core Archiveでは、個人名はメタデータやdwc:identifiedByのような用語に表示されることがあります。

参加者に連絡して、個人情報を公開してもよいかどうかを確認し、公開を希望しない場合は匿名化(例. anonymized:3eb30aa)または除外することを推奨します。いくつかのデータ管理システム(例. Casaer et al. (2019))では、ユーザーが設定を指定でき、エクスポート時に自動的に個人データを匿名化することができます。既に公開されたデータセットの古いバージョンから個人情報を完全に削除することはできない場合があることに注意してください。

機密情報を含むメディアファイル

識別可能な人物が含まれるメディアファイルは、個人データの一形態であり、個人のプライバシーを保護するために、識別され、非公開にされるべきです。同様に、車両が含まれるメディアファイルやカメラの設定を写したメディアファイルについても、非公開にする必要がある場合があります。センシティブな種が含まれるメディアファイルは、撮影場所を特定できる場合、非公開にする必要があるかもしれません。

全てのメディアファイルについてURL(media.filePath または ac:accessURI に記載)を提供することを推奨します。ただし、アクセスはプロバイダーレベルで規制します(例. https://multimedia.agouti.eu/assets/813bafb2-befe-45fa-b0e3-080f1f019a70/file )。想定されるアクセスは、 media.filePublic または ac:serviceExpectation に記載できます。Darwin Core Archive では、人間、車両、設置状況などの観察(およびメディア)は、通常除外されることに注意してください。

機密情報を含む位置情報

カメラトラップデータには、センシティブな種の位置情報が含まれている場合があります。積極的に管理されているカメラの位置も、破壊行為や盗難に対してセンシティブな内容を含むでしょう。Chapman (2020)に従い、機密情報の格付けを決定し(Chapter 2)、適切な一般化を選択することを推奨します。

|

カメラトラップの位置情報は通常、複数の設置で共通することに注意してください。機密情報に関連付く設置の座標を一般化するだけでは、相関分析を防ぐのに十分ではない可能性があります。例えば、複数の設置情報で共有されるdeployments.locationIDは、一般化された調査地/レコードの推測につながる可能性があります。設置全体で位置座標を一般化するようにしてください。 |

一般化のレベルの選択に関係なく、データセットのメタデータと適切な用語において文書化し、ユーザーが認識できるようにしてください。例については表 12を参照してください。

| Camtrap DP 用語 | Darwin Core用語 | 非一般化 | 一般化 |

|---|---|---|---|

51.18061 |

51.181 |

||

5.65490 |

5.655 |

||

implied |

EPSG:4326 |

EPSG:4326 |

|

30 |

187 |

||

0.00001 |

0.001 |

||

source assumed to be GPS, uncertainty defaulted to 30 m |

source assumed to be GPS, uncertainty defaulted to 30 m |

||

coordinates rounded to 0.001 degree |

その他の機密情報

コメントやメモなどのテキストフィールド(例. deployments.deploymentComments または dwc:occurrenceRemarks)には、個人名、機密性の高い位置情報 、または公開を意図しない情報などの機密情報が含まれている場合があります。値を確認し、必要に応じて一般化することを推奨します(Chapman (2020)の 3章参照)。

4.3. Camtrap DP

カメラトラップデータを公開するために、Camera Trap Data Package (Camtrap DP)の使用を推奨します。これはこのタイプのデータ専用に設計されており、Darwin Core Archiveよりも多くの情報を保持できます (Bubnicki et al. 2023)。一部のデータ管理システム は、エクスポート形式として直接サポートしているため(表 11を参照)、GBIFを通じて公開する際のデータ変換の必要性が軽減されます。

用語の定義、推奨事項、および例については、Camtrap DPのウェブサイト を参照してください。

公開されたCamtrap DPの全ての情報が現在GBIFによって収集されるわけではないことに注意してください。GBIFのデータモデルでは、取り込み前にDarwin Coreに変換する必要があります。このプロセスは、Rソフトウェアパッケージcamtraptorの write_dwc() 関数によって提供されます (Oldoni et al. 2023)。この関数は、この文書で推奨されている推奨事項を実装しています。GBIFが新しいデータモデルを実装すると、公開されたCamtrap DPからより多くの情報を処理できるようになります (GBIF Secretariat 2022)。

4.4. Darwin Core Archive

4.4.1. なぜサンプリングイベントデータセットではないのか?

階層的なイベント(設置、シーケンス)とそれに伴う観察結果を持つカメラトラップデータを、サンプリングイベントデータとして、つまりEvent core(イベントコア)(表 13参照)とOccurrence extension(オカレンス拡張)(表 14参照)を使用して表現するのが論理的に思えます。これにより、各タイプのイベントに関する詳細な(ただし繰り返しの)情報を提供し、Measurement Or Facts extension(Measurement Or Facts拡張)を追加することでアライメントやその他の(主に設置に関連した)情報を含めて提供することが可能となります。

残念ながら、Darwin Core Archiveのスター・スキーマ設計では、Occurrence extension(オカレンス拡張)とAudubon Media Description extension(Audubon Media Description拡張)を関連付けることができないため、メディアに関する情報を拡張形式で表現することができません。技術的には、Audubon Media Description extension(Audubon Media Description拡張)をEvent core(イベントコア)と関連付けできますが、その場合、メディアはオカレンスにリンクされず、GBIF.orgのオカレンスページに表示されません。オカレンスレベルでメディアに関する情報を表現する唯一の方法は、dwc:associatedMediaを使用することですが、提供可能な情報はURLのリストに限定されます。ライセンス、メディアタイプ、撮影方法、バウンディングボックスなどは提供できません。

| eventType | eventID | parentEventID | eventDate | Location information |

|---|---|---|---|---|

deployment |

00a2c20d |

2020-05-30T02:57:37Z/ 2020-07-01T09:41:41Z |

51.496, 4.774 |

|

sequence |

79204343 |

00a2c20d |

2020-06-12T04:04:29Z/ 2020-06-12T04:04:55Z |

51.496, 4.774 |

media |

e68deaed |

79204343 |

2020-06-12T04:04:29Z |

51.496, 4.774 |

media |

c5efbcb3 |

79204343 |

2020-06-12T04:04:30Z |

51.496, 4.774 |

| occurrenceID | eventID | scientificName | associatedMedia |

|---|---|---|---|

e68deaed_2 |

e68deaed |

Anas platyrhynchos |

https://multimedia.agouti.eu/assets/e68deaed-a64e-4999-87a3-9aa0edf5970d/file |

c5efbcb3_2 |

c5efbcb3 |

Anas platyrhynchos |

https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

05230014 |

79204343 |

Ardea cinerea |

https://multimedia.agouti.eu/assets/e68deaed-a64e-4999-87a3-9aa0edf5970d/file | https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

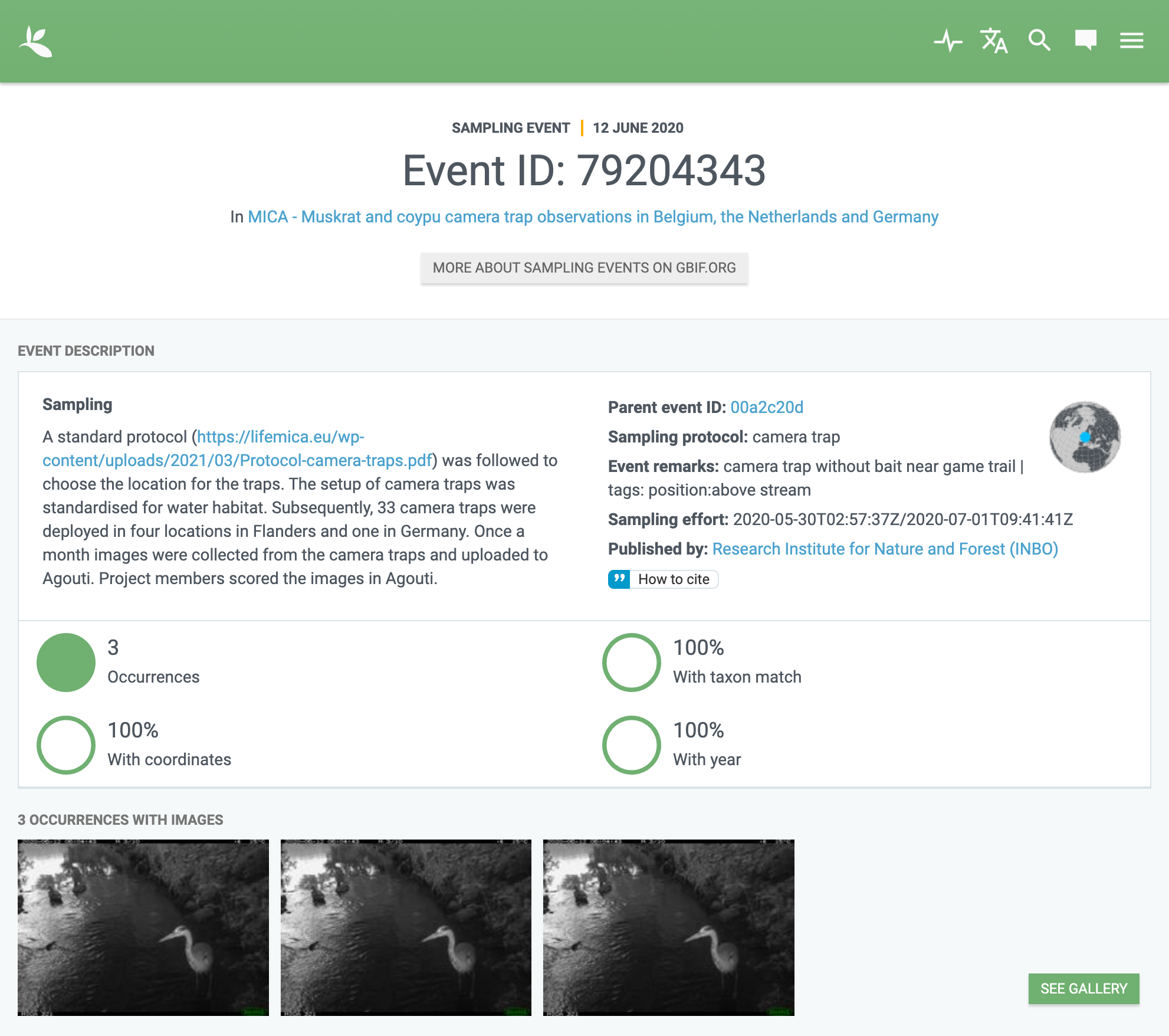

したがって、カメラトラップデータをオカレンスデータセットとして表現することを推奨します。Occurrence core(オカレンスコア)とAudubon Media Description extension(Audubon Media Description拡張)を使用します(表 15 および表 16を参照)。メディアを主要なデータレコードとして扱います。このことは、メディアが観察の証拠であることからも重要です。Occurrence core(オカレンスコア)は、オカレンスをイベント(dwc:eventID)および親イベント(dwc:parentEventID)にグループ化することが可能なため、イベントの階層構造も大部分が保持されます。dwc:eventIDにイベント/シーケンスの識別子を、dwc:parentEventIDに設置の識別子を提供することで、Event core(イベントコア)と同様に観察情報をグループ化でき、GBIF.orgで自動的にイベントページが作成されます(図 5参照)。イベントの期間情報は提供できませんが、eventDateとsamplingEffortでほとんどの情報を保持できます。設置場所、ハビタット、サンプリング手順などの情報は、設置に関連付く全ての観察に対して繰り返されます。

Occurrence core(オカレンスコア)とAudubon Media Description extension(Audubon Media Description拡張)の用語の推奨事項は、それぞれSection 4.4.2およびSection 4.4.3に記載されています。

| occurrenceID | eventID | parentEventID | scientificName | eventDate | Location information |

|---|---|---|---|---|---|

e68deaed_2 |

79204343 |

00a2c20d |

Anas platyrhynchos |

2020-06-12T04:04:29Z |

51.496, 4.774 |

c5efbcb3_2 |

79204343 |

00a2c20d |

Anas platyrhynchos |

2020-06-12T04:04:30Z |

51.496, 4.774 |

05230014 |

79204343 |

00a2c20d |

Ardea cinerea |

2020-06-12T04:04:29Z/ 2020-06-12T04:04:55Z |

51.496, 4.774 |

| occurrenceID | identifier | accessURI | CreateDate | captureDevice | rights |

|---|---|---|---|---|---|

e68deaed_2 |

e68deaed |

https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

2020-06-12T04:04:29Z |

Reconyx-HF2X |

|

c5efbcb3_2 |

c5efbcb3 |

https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

2020-06-12T04:04:30Z |

Reconyx-HF2X |

|

05230014 |

e68deaed |

https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

2020-06-12T04:04:29Z |

Reconyx-HF2X |

|

05230014 |

c5efbcb3 |

https://multimedia.agouti.eu/assets/c5efbcb3-34f5-4a59-bc15-034e01b05475/file |

2020-06-12T04:04:30Z |

Reconyx-HF2X |

4.4.2. オカレンスコア

上述の通り、カメラトラップデータをDarwin Core Archiveとして表現するために、Occurrence core(オカレンスコア)を使用することを推奨します。用語の推奨事項については表 17を参照してください。これらの推奨事項は、GBIFのオカレンスデータセットに対する品質要件(GBIF Secretariat 2020)と一致しており、同じ用語(必須、強く推奨、できれば共有)を使用しています。

なお、Occurrence coreオカレンスコア には動物の観察のみを含めるべきであり、ブランク、車両や(できれば)人間に分類される情報は除外する必要があります。レコード数は、研究の規模、分類の努力(全てのメディアが分類されているか?)、分類の精度(表 9参照)、およびメディアベースまたはイベントベースの分類が使用されたかどうかに依存します。特にメディアベースの分類は、オカレンスの数を大幅に増加させる可能性があり、生態学的研究にほとんど有益ではありません。Camtrap DPは両方に対応していますが、Darwin Core Archiveとして公開する場合は、できればイベントベースの観察のみを提供することを推奨します。

| 用語 | ステータス | 入力例 |

|---|---|---|

できれば共有 |

StillImage |

|

できれば共有 |

||

できれば共有 |

INBO |

|

できれば共有 |

7cca70f5-ef8c-4f86-85fb-8f070937d7ab |

|

できれば共有 |

Agouti |

|

できれば共有 |

Sample from: MICA - Muskrat and coypu camera trap observations in Belgium, the Netherlands and Germany |

|

必須 |

MachineObservation |

|

できれば共有 |

coordinates rounded to 0.001 degree |

|

必須 |

05230014 |

|

強く推奨 |

1 |

|

できれば共有 |

||

できれば共有 |

adult |

|

できれば共有 |

||

強く推奨 |

present |

|

できれば共有 |

||

できれば共有 |

||

強く推奨 |

79204343 |

|

強く推奨 |

00a2c20d |

|

必須 |

2020-06-12T04:04:29Z/2020-06-12T04:04:55Z |

|

できれば共有 |

Campine area with a number of river valleys with valuable grasslands |

|

強く推奨 |

camera trap |

|

できれば共有 |

2020-05-30T02:57:37Z/2020-07-01T09:41:41Z |

|

できれば共有 |

camera trap without bait near game trail | tags: position:above stream |

|

できれば共有 |

e254a13c |

|

できれば共有 |

B_HS_val 2_processiepark |

|

できれば共有 |

||

できれば共有 |

||

できれば共有 |

1.30 |

|

できれば共有 |

1.30 |

|

強く推奨 |

51.496 |

|

強く推奨 |

4.774 |

|

強く推奨 |

EPSG:4326 |

|

強く推奨 |

187 |

|

できれば共有 |

0.001 |

|

できれば共有 |

Peter Desmet |

|

できれば共有 |

2023-02-02T13:57:58Z |

|

できれば共有 |

classified by a human |

|

できれば共有 |

||

必須 |

Ardea cinerea |

|

強く推奨 |

Animalia |

type

リソースの性質。レコードが静止画または静止画のシーケンスに基づいている場合は StillImage を使用し、動画に基づいている場合は MovingImage を使用します。全てのレコードに対してより広い用語 Image を使用することもできます。

license

共有されるデータレコードのライセンス。データセット全体に使用されるライセンスと同じライセンスである可能性が高いですが、そうではない可能性もあります (Waller 2020)。広く活用されるため、データを クリエイティブ・コモンズ・ゼロの下で公開し、URLとして提供することを推奨します:https://creativecommons.org/publicdomain/zero/1.0/legalcode。Camtrap DPでは、この用語はライセンスの path に相当し、 package.licensesの data のスコープがあります。ただし、レコード単位ではなく、データセット全体を指定します。

rightsHolder

リソースの権利を所有または管理する個人または組織(すなわち、参加者)。データがどのライセンスの下で公開されるかを決定した組織、および/またはデータ出版機関(すなわち、GBIFにデータセットを登録する際に出版者として選択された組織)である可能性が高いです。組織に略称がある場合はそれを使用します。Camtrap DPでは、この用語はpackage.contributorsの rightsHolder の役割を持つ共同作業者の title に相当します。

datasetID & datasetName

データセットの識別子と名前です。dwc:datasetIDには、ユーザーがソースであるデータセット/研究に関する情報を見つけられるように、永続的なURLまたは識別子を使用することを推奨します。優先順位としては、データセットのDOI(https://doi.org/10.15468/5tb6ze)、研究のURL(http://n2t.net/ark:/63614/w12001317)、またはデータ管理システムで使用される研究識別子の順です。Camtrap DPでは、この用語はpackage.id に相当しますが、より良い識別子(例. DOI)が利用可能な場合はそれを使用します。dwc:datasetName は、dwc:datasetIDで参照されるデータセット/研究のタイトルを入れましょう。メタデータのタイトルには同じ値を使用することを推奨します。Camtrap DPでは、この用語はpackage.titleに相当します。

collectionCode

記録が由来するコレクションまたはデータセットを識別する名前または略語です。従来は物理的なコレクションを示しましたが、記録が由来するデータ管理システム(すなわち、仮想コレクション)の名前を提供することを推奨します。これにより、ユーザーは同じデータ管理システムからの記録をデータセット全体で検索できます。推奨値: Agouti、 Camelot、 eMammal、 Trapper、 Wildlife Insights など。Camtrap DPでは、この用語はpackage.sourcesの(該当する)ソースのタイトルに相当します。

basisOfRecord

レコードの特性。全てのレコードに対して MachineObservation を入力します。人間がカメラトラップをいつどこに設置するかを決定し、人間または機械(AI)がメディアを分類しますが、レコード収集はセンサーに応答する機械によって行われます。これは、人間が積極的に生物を記録するかどうかを決定する、人間の観察とは本質的に異なります。

dataGeneralizations

元の形よりも特定されにくく、不完全なデータとして公開するための措置。記録のどの機密情報がどのように一般化されたかを簡潔に説明することを推奨します。この情報はレコードレベルで提供でき、データセット全体に適用する必要はありません。重要な情報が完全に省略された場合は、dwc:informationWithheldを使用してください。

例:

coordinates rounded to 0.001 degree scientific name generalized to genus

occurrenceID

観察の識別子。安定した一意の識別子を使用します。Camtrap DPでは、この用語はobservations.observationIDに相当します。

individualCount

観察された個体数。この数は同定の精度に依存することに注意してください。Camtrap DPでは、この用語はobservations.countに相当します。

sex

観察された個体の性別。Camtrap DPに基づき、GBIFの性別語彙と互換性のある制御値である、male および female を使用することを推奨します。Camtrap DPでは、この用語はobservations.sexに相当します。

lifeStage

観察された個体の生活史。Camtrap DPに基づき、GBIFの生活史語彙と互換性のある制御値である、adult、subadult および juvenile を使用することを推奨します。Camtrap DPでは、この用語はobservations.lifeStageに相当します。

behavior

観察された個体の主な行動。既存の制御値または独自の制御値(例. grazing、browsing、rooting、vigilance、running、walking)を使用することを推奨します。Camtrap DPでは、この用語はobservations.behaviorに相当します。

occurrenceStatus

特定の場所での分類群の存在または不在に関する言及。種の観察に絞り込まれた場合(ブランクなどを除外など)、カメラトラップデータには存在記録のみが含まれます。全てのレコードに対して present を入力します。

occurrenceRemarks

観察に関するコメントやメモ。これらは通常、他のデータフィールドに記録されなかった、または記録できなかった観察および/または観察された個体に関する(時には著者の母国語による)メモです。この情報は公開するのに有用かもしれませんが、機密情報を含む可能性があります。Camtrap DPでは、この用語はobservations.observationCommentsに相当します。

organismID

カラーリング、耳タグ、皮膚パターンなどの特徴によって認識された観察された既知の個体識別子。dwc:organismIDが既知のグループを指す場合を除き、dwc:organismIDを持つ観察は、通常、dwc:individualCountが1です。個体に対して、グローバルに一意の識別子が割り当てられていることを把握しているのでなければ、カメラトラップ研究内で個体に割り当てられたコード/識別子を使用することを推奨します。これにより、ユーザーはデータセット内で特定の個体に関する観察を全て見つけることができます。Camtrap DPでは、この用語はobservations.individualIDに相当します。

eventID

観察が属するイベントの識別子。イベントベースの分類に使用されるイベント(通常はシーケンス)の識別子を提供することを推奨します。オカレンスコアを使用する場合、イベントには独自のレコードがありませんが、dwc:eventIDに識別子を提供することで、ユーザーは特定のイベントにおける観察(およびメディア)を全て見つけることができます。安定した一意な識別子を使用してください。GBIF.orgは、同じdwc:eventIDを持つ観察を自動的にグループ化して一緒に属するものとして扱います。Camtrap DPでは、この用語はobservations.eventIDに相当します。

parentEventID

eventIDで識別されたイベントよりも広いイベントの識別子。設置の識別子を提供することを推奨します。オカレンスコアを使用する場合、設置には独自のレコードがありませんが、dwc:parentEventIDに識別子を提供することで、ユーザーは特定の設置における観察(およびメディア)を全て見つけることができます。安定した一意な識別子を使用してください。GBIF.orgは、同じdwc:parentEventIDを持つ観察を自動的にグループ化して一緒に属するものとして扱います。Camtrap DPでは、この用語はobservations.deploymentIDに相当します。

eventDate

イベントが発生した日付、日時、または日時の期間。メディアベースの分類には単一のタイムスタンプを使用し、イベントベースの分類には期間を使用することを推奨します。期間はeventIDで識別されたイベントの開始と終了のタイムスタンプから構成されます。タイムスタンプはISO 8601形式(YYYY-MM-DDTHH:MM:SS)で記述し、期間を示すには / を使用し、タイムゾーン (+02:00) を含めるか、UTC (Z) に変換して示します。Camtrap DPでは、この用語はobservations.eventStartおよびobservations.eventEndに相当します。両方の値が等しい場合はobservations.eventStartです。

例:

2020-07-29T05:38:55Z/2020-07-29T05:39:00Z 2020-07-29T05:38:55Z 2020-07-29T07:38:55+02:00

habitat

イベントが発生したハビタットのカテゴリまたは説明。これは通常、設置時のハビタットであり、この設置の全てのレコードに対して値が繰り返されます。値は制御され、理想的には既存の分類システムを使用するか、自由形式の説明を入力できます。Camtrap DPでは、この用語はdeployments.habitatに相当します。

samplingProtocol

イベント中に使用された方法またはプロトコル。制御値として camera trap を使用することを推奨します。これにより、ユーザーはこのプロトコルを持つ記録をデータセット全体で検索できます。

samplingEffort

イベントに費やした努力量。カメラトラップが設置された日時の期間を提供することを推奨します。eventDateと同じフォーマット規則を使用します。Camtrap DPでは、この用語はdeployments.deploymentStartおよびdeployments.deploymentEndに相当します。

eventRemarks

イベントに関するコメントやメモ。これらは通常、他のデータフィールドに記録されなかった、または記録できなかった設置に関する(時には著者の母国語による)メモです。この情報は公開すると有用かもしれませんが、機密情報を含む可能性があります。また、餌の使用、特徴タイプ、タグなど、設置に関連する他の(構造化された)情報を提供するために、この項目を使用することを推奨します。その際はパイプ(|)で区切られた値を入力します。Camtrap DPでは、この用語はdeployments.deploymentCommentsに相当し、deployments.baitUse、deployments.featureTypeおよびdeployments.deploymentTagsに相当します。

例:

camera trap with bait near burrow camera trap without bait | tags: position:above stream camera malfunction on 29/06/2020

locationID

場所の識別子。この識別子により、ユーザーは(設置全体で)特定の場所の観察(およびメディア)を全て見つけることができます。安定した一意な識別子を使用してください。Camtrap DPでは、この用語はdeployments.locationIDに相当します。

locality

場所の名前。これは通常、カメラトラップ研究内で割り当てられた名前またはコードです。Camtrap DPでは、この用語はdeployments.locationNameに相当します。

minimumDepthInMeters & maximumDepthInMeters

地表からの深さ(メートル単位)。(海洋)カメラトラップ研究では、これはカメラが設置された深さです。カメラの深さまたはカメラの高さのいずれかを提供することを推奨します。両方を提供しないでください。Camtrap DPでは、この用語はdeployments.cameraDepthに相当します。

minimumDistanceAboveSurfaceInMeters & maximumDistanceAboveSurfaceInMeters

基準面からの高さ(メートル単位)。カメラトラップ研究では、これはカメラが設置された高さです。カメラの深さまたはカメラの高さのいずれかを提供することを推奨します。両方を提供しないでください。Camtrap DPでは、この用語はdeployments.cameraHeightに相当します。

decimalLatitude & decimalLongitude

10進法による、場所の地理的緯度と経度。緯度の値は-90から90の間、経度の値は-180から180の間です。カメラトラップ研究では、これらは通常GPSで取得され、データ管理システムに記録されます。データ管理システムに保存されている座標を提供することを推奨します。ただし、機密情報を保護するために丸める/一般化する必要がある場合を除きます。Camtrap DPでは、これらの用語はそれぞれdeployments.latitudeおよびdeployments.longitudeに相当します。

geodeticDatum

地理座標に使用される空間参照システム。GPSで取得された座標の場合、通常は EPSG:4326(すなわち、WGS84)です (Chapman and Wieczorek 2020)。Camtrap DPでは、WGS84はdeployments.latitudeおよびdeployments.longitudeの用語の定義に示されています。

coordinateUncertaintyInMeters

地理座標から、場所を含む最小の円までの、水平距離(メートル単位)。GPSで取得された座標の合理的な下限として 30 メートルを推奨しますが、不確実性に寄与する要素の詳細についてはSection 3.4.2を参照してください。特に一般化/丸められた座標はdwc:coordinateUncertaintyInMetersを増加させます。Camtrap DPでは、この用語はdeployments.coordinateUncertaintyに相当します。

coordinatePrecision

地理座標>の小数点以下の精度(既知の場合)。この情報が既知である場合、一般化/丸められた座標に対して提供することを推奨します(例. 小数点以下3桁に丸められた座標の場合は 0.001)。Camtrap DPでは、この用語はpackage.coordinatePrecisionに相当します。ただし、レコード単位ではなく、データセット全体を指定します。

identifiedBy

観察された個体を識別し、scientificNameを割り当てた人物または種分類モデル。最新の分類を行った人物またはモデルの名前を1つ提供することを推奨します。分類は学名の割り当てよりも広範である可能性がありますが、動物の観察に関してはその側面が関与する可能性が高いです。この用語には個人データが含まれていることに注意してください。Camtrap DPでは、この用語はobservations.classifiedByに相当します。

例:

Peter Desmet Western Europe species model Version 1 anonymized:3eb30aa

dateIdentified

識別が行われた日付または日時。identifiedByで示された人物またはモデルによって行われた分類のタイムスタンプを1つ提供することを推奨します。この情報は通常、データ管理システムによって記録されます。タイムスタンプはISO 8601形式(YYYY-MM-DDTHH:MM:SS)で記述し、タイムゾーン(+02:00)を含めるか、UTC(Z)に変換して示します。Camtrap DPでは、この用語はobservations.classificationTimestampに相当します。

identificationRemarks

識別に関するコメントやメモ。この用語を使用して、人間と種分類モデルのどちらによって、分類が行われたのか、また、できれば確実性の度合い(通常AI分類で記録される)を提供することを推奨します。Camtrap DPでは、この用語はobservations.classificationMethodおよびobservations.classificationProbabilityに相当します。

例:

classified by a human classified by a machine with a degree of certainty of 89%

taxonID

scientificNameの識別子。この識別子により、ユーザーは特定の分類群の観察(およびメディア)を全て見つけることができます。安定した一意な識別子を使用し、できれば権威あるソースによって割り当てられたものを使用してください。Camtrap DPでは、この用語はpackage.taxonomicの分類群の taxonID に相当します。

kingdom

scientificNameが属する分類群の界。これにより、GBIFの種名マッチング などのサービスが同名異種を区別することができます。カメラトラップデータには植物、菌類、その他の界の分類がほとんど含まれないため、全てのレコードに Animalia を入力する可能性が高いです。

4.4.3. Audubon Media Description extension

上述の通り、カメラトラップデータをDarwin Core Archiveとして表現するために、Audubon Media Description extensionを使用することを推奨します。用語の推奨事項については表 18を参照してください。

Audubon Media Description extensionには重複が含まれる可能性があることに注意してください。各ファイルが一度だけリストアップされるCamtrap DPの mediaとの重要な違いです。同じoccurrenceIDが繰り返し表れるのは、単一のイベントベース の観察が複数のメディアファイルに関連している結果です(例. 表 16の観察 05230014 )。同じidentifiersが繰り返し表れるのは、一つのメディアファイルが複数の観察の情報源であることの結果です(例. 表 16のメディアファイル e68deaed のように、同じ静止画に複数の種が観察される場合)。ただし、拡張ファイルのoccurrenceID+identifierの組み合わせは一意である必要があります。

| 用語 | ステータス | 入力例 |

|---|---|---|

必須 |

05230014 |

|

できれば共有 |

6d65f3e4 |

|

できれば共有 |

StillImage |

|

できれば共有 |

marked as favourite |

|

強く推奨 |

||

できれば共有 |

2020-06-12T06:04:32+02:00 |

|

できれば共有 |

Reconyx-HF2X |

|

できれば共有 |

motion detection |

|

必須 |

https://multimedia.agouti.eu/assets/6d65f3e4-4770-407b-b2bf-878983bf9872/file |

|

できれば共有 |

image/jpeg |

|

できれば共有 |

online |

occurrenceID

Occurrence coreのoccurrenceIDへの外部キーで、観察とそれに基づくメディアファイルとの関係を示します。この用語には重複が含まれる可能性があります。これは多対多の関係であるためです(Section 4.4.3の注を参照)。Camtrap DPでは、この用語はobservations.observationIDに相当しますが、observationsとmediaの関係は、以下のいずれかの方法で確立されます:observations.mediaIDで直接関連付けする。または観察と同じmedia.deploymentID を持ち、media.timestampが観察のobservations.eventStartとobservations.eventEndの間にあるメディアを選択する。

identifier

media fileの識別子。安定した一意な識別子を使用します。多対多の関係であるため(Section 4.4.3の注を参照)、この用語は重複する可能性があります。Camtrap DPでは、この用語はmedia.mediaIDに相当します。

type

リソースの性質。静止画には StillImage、動画には MovingImage を使用します。dcterms:typeは、URL値を入力する決まりがあるため、使用しないでください。

comments

メディアファイルに関するコメントやメモ。eventRemarksやoccurrenceRemarksとは対照的に、メディアファイル自体に関するメモはデータ管理システムに記録されることはほとんどありません。この用語は、メディアファイルが、お気に入りや注目としてマークされたかどうかを示すために使用できます。Camtrap DPでは、この用語はmedia.mediaCommentsに相当し、media.favoriteに関連します。

rights

メディアファイルが共有されるライセンス。これはaccessURIで参照されるファイルに適用され、Audubon Media Description extensionのデータには適用されません(データセットライセンスが適用されます)。全てのメディアファイルに同じライセンスを使用することを推奨します。広範な利用を可能にするために、メディアファイルを クリエイティブ・コモンズ・ゼロまたは クリエイティブ・コモンズ表示4.0国際ライセンスの下で公開し、URLを提供することを推奨します: https://creativecommons.org/publicdomain/zero/1.0/legalcode または、 https://creativecommons.org/licenses/by/4.0/legalcode 。dc:rightsは、文字列値(全文の著作権声明)を入力する決まりがあるため、使用しないでください。Camtrap DPでは、この用語はpackage.licensesの media のスコープを持つライセンスの path に相当します。ただし、レコード単位ではなく、データセット全体を指定します。

CreateDate

メディアファイルが作成された日時。この情報は通常、data management system,データ管理システムによってEXIFメタデータから抽出されます。タイムスタンプはISO 8601形式(YYYY-MM-DDTHH:MM:SS)で記述し、タイムゾーン(+02:00)を含めるか、UTC(Z)に変換して示します。Camtrap DPでは、この用語はmedia.timestampに相当します。

captureDevice

メディアファイルを作成するために使用されたデバイス。カメラのメーカーとモデル(例. Reconyx-HF2X)を提供することを推奨します。Camtrap DPでは、この用語はdeployments.cameraModelに相当します。

resourceCreationTechnique

メディアファイルを作成または変更するために使用された方法。この用語を使用して、メディアファイルを収集するために使用されたトリガー方法を提供することを推奨します。制御値は activity detection、 time lapse のいずれかです。Camtrap DPでは、この用語はmedia.captureMethodに相当します。

accessURI

メディアファイルにアクセスするためのURI(Uniform Resource Identifier)。この用語は相対ファイルパスやオフラインのストレージを指すことができますが、できればメディアファイルが掲載されているhttp/https URLを提供することを強く推奨します(Section 3.3.3参照)。メディアファイルを(埋め込みしたHTMLページではなく)直接掲載するhttp/https URLを使用してください。これにより、GBIF.orgのオカレンスページで表示できます。カメラトラップ静止画は通常小さいため、縮小したバージョンを掲載用ファイルとする必要はありません。Camtrap DPでは、この用語はmedia.filePathに相当します。

serviceExpectation

accessURIに対するユーザーのサービス期待値。制御値としては、http/httpsで公開されているメディアファイルには online を、http/httpsで非公開にされているメディアファイルには authenticate を使用することを推奨します(Section 4.2.2.2参照)。Camtrap DPでは、これらの値はそれぞれmedia.filePublicの TRUE および FALSE に相当します。

format

メディアファイルのファイル形式。Dublin CoreのAudiovisual Core Controlled Vocabularyの制御値である、 image/jpeg、 video/mp4 または video/mpeg を使用して、メディアタイプ(MIMEタイプ)を提供することを推奨します。dcterms:formatは 、URL値を入力する決まりがあるため、使用しないでください。Camtrap DPでは、この用語はmedia.fileMediatypeに相当します。

Acknowledgements

このガイドへの提案や技術支援をいただいた以下の人々に感謝を申し上げる:Stephen Formel, Donald Hobern, Kyle Copas, Laura Russell, Matt Blissett、そして Camtrap DP Development Teamメンバーの皆様。

用語集

- 活動

-

カメラの前での動き。特定の条件が満たされると動きがトリガーを引き起こすことがあります(例. 検出ゾーン内かつ静止期間外)。カメラトラップは通常、野生動物の活動を撮影するために設置されますが、人間、車両、または植生の動きを記録することもあります。

- アライメント

- 人工知能

-

人間および動物とは対照的に、機械によって情報を認識、合成、推論する能力。カメラトラップ研究では、AIは主に機械学習としてコンピュータビジョンタスクを実行するために適用されます。Section 3.5.3も参照してください。

- 餌

-

動物を検出ゾーン内の場所または特定のポイントに誘導するために使用される誘引物。餌は聴覚的、嗅覚的、視覚的、またはこれらの組み合わせであることがあります。設置に餌が使用されたかどうかは、動物の自然な行動を変える可能性があるため、分析に役立ちます。カテゴリカルな説明(例. acoustic、visual、scent)またはブール値として表現できます。lureとも呼ばれます (Meek et al. 2014)。Camtrap DPでは、deployments.baitUseに対応します。

- ブランク

-

興味の対象がないメディア。ブランクは通常、動く植生や変動する光などの誤ったトリガーの結果です。クエリから除外しやすくするために分類時にそのようにマークされます。

- カメラ

-

(野生動物の)活動のメディアを自動的に撮影するように設計されたデバイス。通常、熱と動きの組み合わせによってトリガーされます。特定のメーカーとモデルがあり、シリアル番号などで一意に識別できます。

camera trap、game camera、trail camera、scouting camera、deviceとも呼ばれます。 - カメラの深さ

-

(水中)カメラの深さ、カメラのアライメントの一部。通常、その土地の水面下のメートル単位で表現されます。Camtrap DPでは、deployments.cameraDepthに相当します。

- カメラの高さ

-

地面からのカメラの高さ、カメラのアライメントの一部。地面からのメートル単位で表現するか、カテゴリによる説明(

knee height~ 0.5m、chest height~ 1.5m、canopy~ 3+m、Ahumada et al. (2020))で表現できます。Camtrap DPでは、deployments.cameraHeightに相当します。 - カメラの傾き

-

カメラの上下の向き、カメラのアライメントの一部。度数で表現するか、カテゴリによる説明(

parallel= 0°、pointed downward= -90°、Ahumada et al. (2020))で表現できます。Camtrap DPでは、deployments.cameraTiltに相当します。 - カメラの方位

-

カメラの水平方位、カメラのアライメントの一部。北からの度数、または方位(N、NWなど)で表現できます。Camtrap DPでは、deployments.cameraHeadingに相当します。

- Camtrap DP

-

カメラトラップデータパッケージ。コミュニティにより開発された、カメラトラップデータのためのデータ交換フォーマットで、Biodiversity Information Standards(TDWG)の下で維持されています。Section 4.3、Bubnicki et al. (2023)および Camtrap DPウェブサイトも参照してください。

- 分類

-

カメラトラップメディアを分類する行為で、観察結果をもたらします。分類学的分類とは混同しないでください。異なるステップと異なる精度レベルで実行できます。例. 1. メディアに興味のあるオブジェクトが含まれている/含まれていない(すなわち、ブランク)、2. 興味のあるオブジェクトが人間/車両/動物または不明、3. 動物が特定の分類群に属す(例. Sus scrofa、Rodentia)、4. 動物が特定の性別/ライフステージに属し、既知の個体xであるか、特定の行動を示す。分類は通常、労働集約的であるため、コンピュータビジョン、ボランティアにより支援され、さらに/または個々のmedia filesではなくシーケンスを分類するときに支援されます。

image classification、annotation、identificationとも呼ばれます。Section 3.5.1も参照してください。 - 市民科学

-

市民の参加を伴う科学研究。

community science、crowd science、crowdsourcing、volunteer monitoringとも呼ばれます。カメラトラップ研究では、市民科学者がカメラトラップの設置と分類に参加できます。Section 3.5.2も参照してください。 - クラウド・コンピューティング

-

分散型ITインフラ(「クラウドサービス」)でコンピューターによるタスクを実行すること。通常、より良いパフォーマンスやメンテナンスの軽減と引き換えに、コストがかかります(「使った分だけ支払う」)。

- コンピューター・ビジョン

-

機械によって、メディアを処理、分析、理解し、物体の追跡から種の同定までの分類を支援すること。通常、機械学習で訓練された人工知能の一形態です。

- 共変量

-

動物の行動と検出に影響を与える可能性のある生態学的変数(例. 餌の使用、特徴タイプ、ハビタット、樹冠被覆率)。データのさらなる分析のために共変量を記録することが重要です。Section 3.4.5も参照してください。

- データ交換フォーマット

-

システム間でデータを交換するために使用されるフォーマット(例. Camtrap DPとDarwin Core Archive)。提供元のシステムからあるフォーマットへのデータ変換と、そのフォーマットからターゲットとなるシステムへのデータ変換が必要です。よく設計されたデータ交換フォーマットは、FAIRデータ交換を促進し、オープンフォーマットを使用し、明確な定義を提供します。承認プロセスを経て承認された場合

data standardとも呼ばれます。 - データ管理システム

-

カメラトラップデータを管理するためのオンラインまたはデスクトップアプリケーション。通常、メディアのアップロード、設置情報の追加、静止画の分類、データのエクスポート、参加者の招待、およびプロジェクトの管理機能を含みます。Section 3.6も参照してください。

- データリポジトリ

-

(研究)データの長期アーカイブのためのオンラインシステム(例. Zenodo、Dryad、およびIPT。(必ずしも長期アーカイブではない)データの管理を目的としたデータ管理システムとは異なります。

- Darwin Core Archive

-

標準化され、広くサポートされている、生物多様性データのためのデータ交換フォーマットで、Biodiversity Information Standards(TDWG)によって維持管理されています。Section 4.4および Darwin Coreテキストガイドも参照してください。

- 設置

-

野生動物の静止画をサンプリングするためのカメラの空間的および時間的配置。2020年1月1日から15日までの間に特定の場所に設置されたカメラは、同じ場所に2020年1月15日から30日までの間に設置された同じ(または異なる)カメラとは異なる設置です。設置は、カメラの取り外しや交換、位置の変更、メモリーカードの交換によって終了します。また、

sampling point(Wearn and Glover-Kapfer 2017)、trap station session(Hendry and Mann 2018)またはvisit(Newkirk 2016)とも呼ばれます。Camtrap DPでは、deploymentsに相当します。Section 3.4も参照してください。 - 設置グループ

-

空間的、時間的、またはテーマ別の基準に基づく設置の論理的グループ化。設置は複数の設置グループに属することができます。

array(O’Connor et al. 2017)、camera trap array(Meek et al. 2014)、cluster(Resources Information Standards Committee RISC 2019)、paired deployment(Kolowski and Forrester 2017)、siteとstrata(Sun et al. 2021)は空間的な設置グループです。sampling campaign(Lamelas-Lopez et al. 2020)、sampling event(Fegraus et al. 2011) およびsessionは時間的な設置グループです。subproject(eMammal n.d.)、survey(Resources Information Standards Committee RISC 2019; Tobler 2015) およびtagsはテーマ別設置グループです。study areas(Newkirk 2016) は、それ自体が設置グループまたは プロジェクトと見なされることがあります。Camtrap DPでは、deployments.deploymentGroupsに相当します。Section 3.4.4も参照してください。 - 検出距離

-

カメラが活動を検出する検出ゾーンの最遠距離。Camtrap DPでは、deployments.detectionDistanceに相当します。

- 検出ゾーン

- イベント

-

特定の場所で特定の期間に発生するアクション。カメラトラップ研究では、イベントは通常、一つ以上のトリガーを通じて記録され、シーケンスを形成する動物の活動を指しますが、データを分析する際には他の定義が使用されることがあります。イベントは、Camtrap DPではobservations.eventID、observations.eventStart、およびobservations.eventEndで示すことができます。Darwin Core Archiveでは、設置もイベントと見なすことができます。

- EXIF

-

交換可能な静止画ファイル形式。メディアファイルに関するメタデータ(例. 作成日時、形式、解像度、シャッタースピード、露出レベル、カメラモデル)を保存するための形式で、通常はメディアファイルの一部として保存されます。Camtrap DPでは、media.exifDataに相当します。

- FAIR

-

FAIR(メタ)データは、検索可能性、アクセス可能性、相互運用性、および再利用性の原則を満たす(メタ)データです。FAIR原則は、個人による再利用をサポートするだけでなく、機械がデータを自動的に検索して使用する性能を向上させることに特に重点を置いています。Wilkinson et al. (2016)を参照してください。

- 特徴タイプ

-

設置において対象とする、特定の物理的特徴のカテゴリによる説明。例えば、巣穴、巣の場所、水源。Camtrap DPでは、deployments.featureTypeに相当します。

- ファイルパス

-

ストレージ・システム内のファイルの場所を記述する文字列(例.

data/deployments.csv)。http/httpsで提供される場合、ドメイン名とファイルパスがファイルURLを構成します(例.https://raw.githubusercontent.com/tdwg/camtrap-dp/main/example/deployments.csv)。 - GDPR

-

一般データ保護規則。個人情報に対する個人による制御と権利を強化するために設計された A 欧州連合の規則。Section 4.2.2.1を参照してください。

- ハビタットタイプ

-

場所の環境と植生に関するカテゴリによる説明。分類システムとして、ハビタット (European Environment Agency EEA 2021; IUCN 2019)または植生タイプ (Vegetation Subcommittee 2016)が存在します。Camtrap DPでは、deployments.habitatに相当します。

- 静止画

-

カメラによって記録された静的メディアファイル。重要な期間や音声はありません。

- 独立間隔

-

連続するトリガーを別のシーケンスとして扱うための最小時間間隔。この値(例. 120秒)は、データ管理システムで定義され、メディアを自動的にシーケンスにグループ化するために使用されます。これは、カメラ設定である静止期間とは異なります。

- 個体

-

個別の生物、通常は動物。

- 場所

-

設置された カメラが位置する物理的な場所。名前および/または識別子と特定の参照システム(例. WGS84の10進法の緯度と経度)で座標を記述できます。また、

camera location(Newkirk 2016)、station(Van Berkel 2014; Zaragozí et al. 2015)、project station(WildCAM 2018)、またはtrap station(Hendry and Mann 2018)とも呼ばれます。Camtrap DPでは、deployments.locationName、deployments.locationID、deployments.latitude、deployments.longitude、およびdeployments.coordinateUncertaintyに相当します。Section 3.4.2も参照してください。 - 機械学習

-

(教師)データ(例. https://lila.science/)とアルゴリズムを使用して、人間が学習する方法を模倣し、徐々に精度を向上させる計算技術。

- メディア

-

カメラによって撮影されたメディアファイル(複数形)。

photosとも呼ばれます (Newkirk 2016)。Camtrap DPでは、mediaに相当します。 - メディアファイル

-

カメラによって録音された(音声)ビジュアルファイル。静止画または動画である可能性があります。メディアファイルには通常、識別子、ファイル名、作成時のタイムスタンプ、および関連するメタデータ(例. EXIF)が含まれます。メディアファイルにアクセスするには、そのファイルパスを知り、必要とされるアクセス権を持つ必要があります。Camtrap DPでは、media.mediaID、media.timestamp、media.fileName、media.filePathに相当します。Section 3.3も参照してください。

- メディアタイプ

-

ファイル形式の標準化された表現(例. 静止画の場合は

image/jpeg)。以前はMIMEタイプとして知られていました。Camtrap DPでは、media.fileMediatypeに相当します。 - 観察

-

分類の結果、すなわち、メディアファイルで見えるまたは聞こえるものの記録。動物の観察とその他の観察を区別するための観察タイプがあります。Camtrap DPでは、observationsに相当します。Section 3.5も参照してください。

- 観察タイプ

-

観察タイプのカテゴリによる説明。分類の一部として記録され、ブランク、人間または車両の観察、および動物の観察を区別することができます。Camtrap DPでは、observations.observationTypeに相当します。

- 組織

-

特定の目的を共有する1人以上の人々で構成されるエンティティ。例えば、会社、機関、協会、またはパートナーシップ。組織は、プロジェクトに直接関連付けられることもあれば(例. 権利保有者、出版者)、プロジェクト参加者の所属を通じて間接的に関連付けられることもあります。Camtrap DPでは、package.contributorsに相当します。

- 参加者

-

プロジェクトに関連する人物で、1つ以上の役割を果たします。参加者情報には通常、名前と連絡先の情報が含まれ、GDPRの対象となります。組織も参加者と見なされることがあります。また、

contributor、時には、userとも呼ばれます。Camtrap DPでは、package.contributorsに相当します。Section 3.2.1も参照してください。 - 役割

-

プロジェクトにおける参加者の役割。例えば、プロジェクトリーダー、データマネージャー、メディアを分類するボランティア。参加者は複数の役割を持つことができ、役割は通常、データ管理システム内の異なる権利(例. 新しい参加者を招待する権利)に関連付けられます。

participant typeとも呼ばれます。Camtrap DPでは、package.contributors.roleに相当します。Section 3.2.1も参照してください。 - プロジェクト

-

複数の参加者による科学的調査で、定義された目的、方法論、および分類学的、空間的、時間的範囲を持ちます。カメラトラッププロジェクトの目的は通常、野生動物を研究し理解することです。また、

studyとも呼ばれます。Camtrap DPでは、package.projectに相当し、データセットは1つのプロジェクトにのみ関連付けられます。Section 3.2も参照してください。 - 静止期間(再検知無効期間)

-

トリガー後にカメラセンサーが検出した活動を無視するように事前に定義された期間。Camtrap DPでは、deployments.cameraDelayに相当します。

- サンプリングデザイン

-

特定の研究目的を促進するためのカメラ設置戦略。カテゴリによる説明で表現できる(例.

simple random、systematic random、opportunistic)。Camtrap DPでは、package.project.samplingDesignに対応します。 - 感度

-

カメラセンサーで使用されるトリガー感度設定。

- センサー

-

環境の変化(例. 動き、熱、光、音、その他の刺激)を検出するデバイス。現代のカメラトラップは通常、熱と動きの組み合わせに基づいて活動を検出するように設計された人感赤外線(PIR)センサーを使用します。

- シークエンス

-

設定された独立間隔よりも短い時間間隔で急速に連続撮影されたメディアファイルのシリーズで、イベントのアニメーション記録を形成します。また

seriesとも呼ばれます (Bayne et al. 2018)。 - セットアップ

-

フィールドでカメラを設置する行為。アライメント、カメラ設定の定義、および最適なデータ撮影記録を確保するためのカメラの固定が含まれます。Camtrap DPでは、observations.cameraSetupTypeに相当します。

- サイト

-

複数の場所を含む地理的エリア。

- 種の判別

-

カメラトラップによって撮影(記録)された視覚的または聴覚的データに基づいて、異なる動物種を自動的に識別および分類すること。

- サブプロジェクト

-

非常に大規模なプロジェクトをより管理しやすい単位に細分化するための設置グループの一種。

- トリガー

-

カメラを起動してメディアを撮影する際のセンサー条件。また、そのトリガーにより生じた連続するメディアファイルのシリーズを示すためにも使用されます。1つ以上のトリガーがシーケンスを形成します。または

burstとも呼ばれます。 - UUID

-

ユニバーサル固有識別子(UUID)。中央登録機関なしで生成できるグローバルに一意の識別子の一種。例.

6d65f3e4-4770-407b-b2bf-878983bf9872。 - 動画

引用文献

Ahumada J A, Fegraus E, Birch T, Flores N, Kays R, O’Brien T G, Palmer J, Schuttler S, Zhao J Y, Jetz W, Kinnaird M, Kulkarni S, Lyet A, Thau D, Duong M, Oliver R & Dancer A (2020) Wildlife Insights: A Platform to Maximize the Potential of Camera Trap and Other Passive Sensor Wildlife Data for the Planet. Environmental Conservation 47: 1–6. https://doi.org/10.1017/S0376892919000298

Alony I, Haski-Leventhal D, Lockstone-Binney L, Holmes K & Meijs L C P M (2020) Online volunteering at DigiVol: an innovative crowd-sourcing approach for heritage tourism artefacts preservation. Journal of Heritage Tourism 15: 14–26. https://doi.org/10.1080/1743873X.2018.1557665

Amatulli G, Domisch S, Tuanmu M-N, Parmentier B, Ranipeta A, Malczyk J & Jetz W (2018) A suite of global, cross-scale topographic variables for environmental and biodiversity modeling. Scientific Data 5: 180040. https://doi.org/10.1038/sdata.2018.40

Bayne E, MacPhail A, Copp C, Packer M & Klassen C (2018) Wildtrax. https://www.wildtrax.ca

Bennett J M, Calosi P, Clusella-Trullas S, Martínez B, Sunday J, Algar A C, Araújo M B, Hawkins B A, Keith S, Kühn I, Rahbek C, Rodríguez L, Singer A, Villalobos F, Ángel Olalla-Tárraga M & Morales-Castilla I (2018) GlobTherm, a global database on thermal tolerances for aquatic and terrestrial organisms. Scientific Data 5: 180022. https://doi.org/10.1038/sdata.2018.22

Bradley S (2017) MammalWeb – Participant guided development of a generalised citizen science web platform. http://edshare.soton.ac.uk/id/eprint/18337

Brides K, Middleton J, Leighton K & Grogan A (2018) The use of camera traps to identify individual colour-marked geese at a moulting site. Ringing & Migration 33: 19–22. https://doi.org/10.1080/03078698.2018.1525194

Bubnicki J W, Churski M & Kuijper D P J (2016) TRAPPER: an open source web‐based application to manage camera trapping projects. Poisot T (Ed). Methods in Ecology and Evolution 7: 1209–1216. https://doi.org/10.1111/2041-210X.12571

Bubnicki J W, Norton B, Baskauf S J, Bruce T, Cagnacci F, Casaer J, Churski M, Cromsigt J P G M, Farra S D, Fiderer C, Forrester T D, Hendry H, Heurich M, Hofmeester T R, Jansen P A, Kays R, Kuijper D P J, Liefting Y, Linnell J D C, Luskin M S, Mann C, Milotic T, Newman P, Niedballa J, Oldoni D, Ossi F, Robertson T, Rovero F, Rowcliffe M, Seidenari L, Stachowicz I, Stowell D, Tobler M W, Wieczorek J, Zimmermann F & Desmet P (2023) Camtrap DP: an open standard for the FAIR exchange and archiving of camera trap data. Remote Sensing in Ecology and Conservation. https://doi.org/https://doi.org/10.1002/rse2.374

Buchhorn M, Lesiv M, Tsendbazar N-E, Herold M, Bertels L & Smets B (2020) Copernicus Global Land Cover Layers—Collection 2. Remote Sensing 12: 1044. https://doi.org/10.3390/rs12061044

Burton C, Neilson E, Moreira-Arce D, Ladle A, Steenweg R, Fisher J, Bayne E & Boutin S (2015) REVIEW: Wildlife camera trapping: a review and recommendations for linking surveys to ecological processes. Journal of Applied Ecology 52. https://doi.org/10.1111/1365-2664.12432

Bánki O, Roskov Y, Döring M & others (2023) Catalogue of Life Checklist. https://doi.org/10.48580/dfs6

Cadman M, González Talaván A, Athreya V, Chavan V, Ghosh-Harihar M, Hanssen F, Harihar A, Hirsch T, Lindgaard A, Mathur V, Mahlum F, Pandav B, Talukdar G & Vang R (2014) Publishing Camera Trap Data, a Best Practice Guide. Global Biodiversity Information Facility.

Caravaggi A, Burton A C, Clark D A, Fisher J T, Grass A, Green S, Hobaiter C, Hofmeester T R, Kalan A K, Rabaiotti D & Rivet D (2020) A review of factors to consider when using camera traps to study animal behavior to inform wildlife ecology and conservation. Conservation Science and Practice 2. https://doi.org/10.1111/csp2.239

Cartuyvels E, Adriaens T, Baert K, Baert W, Boiten G, Brosens D, Casaer J, De Boer A, Debrabandere M, Devisscher S, Donckers D, Dupont S, Franceus W, Fritz H, Fromme L, Gethöffer F, Herbots C, Huysentruyt F, Kehl L, Letheren L, Liebgott L, Liefting Y, Lodewijkx J, Maistrelli C, Matthies B, Meijvisch K, Moerkens D, Neukermans A, Neukermans B, Ronsijn J, Schamp K, Slootmaekers D, Van Der Beeck D & Desmet P (2022) MICA - Muskrat and coypu camera trap observations in Belgium, the Netherlands and Germany. https://doi.org/10.15468/5tb6ze

Casaer J, Milotic T, Liefting Y, Desmet P & Jansen P (2019) Agouti: A platform for processing and archiving of camera trap images. Biodiversity Information Science and Standards 3: e46690. https://doi.org/10.3897/biss.3.46690

Chapman A (2020) Current Best Practices for Generalizing Sensitive Species Occurrence Data. https://doi.org/10.15468/DOC-5JP4-5G10

Chapman A & Wieczorek J (2020) Georeferencing Best Practices. https://doi.org/10.15468/DOC-GG7H-S853

Clements J F, Schulenberg T S, Iliff M J, Fredericks T A, Gerbracht J A, Lepage D, Billerman S M, Sullivan B L & Wood C L (2022) The eBird/Clements checklist of Birds of the World. https://www.birds.cornell.edu/clementschecklist/download/

Cusack J J, Dickman A J, Rowcliffe J M, Carbone C, Macdonald D W & Coulson T (2015) Random versus Game Trail-Based Camera Trap Placement Strategy for Monitoring Terrestrial Mammal Communities. Guralnick R (Ed). PLOS ONE 10: e0126373. https://doi.org/10.1371/journal.pone.0126373

DataCite Metadata Working Group (2021) DataCite Metadata Schema Documentation for the Publication and Citation of Research Data and Other Research Outputs v4.4. https://doi.org/10.14454/3W3Z-SA82

Delisle Z J, Flaherty E A, Nobbe M R, Wzientek C M & Swihart R K (2021) Next-Generation Camera Trapping: Systematic Review of Historic Trends Suggests Keys to Expanded Research Applications in Ecology and Conservation. Frontiers in Ecology and Evolution 9: 617996. https://doi.org/10.3389/fevo.2021.617996

Dinerstein E, Olson D, Joshi A, Vynne C, Burgess N D, Wikramanayake E, Hahn N, Palminteri S, Hedao P, Noss R, Hansen M, Locke H, Ellis E C, Jones B, Barber C V, Hayes R, Kormos C, Martin V, Crist E, Sechrest W, Price L, Baillie J E M, Weeden D, Suckling K, Davis C, Sizer N, Moore R, Thau D, Birch T, Potapov P, Turubanova S, Tyukavina A, Souza N de, Pintea L, Brito J C, Llewellyn O A, Miller A G, Patzelt A, Ghazanfar S A, Timberlake J, Klöser H, Shennan-Farpón Y, Kindt R, Lillesø J-P B, Breugel P van, Graudal L, Voge M, Al-Shammari K F & Saleem M (2017) An Ecoregion-Based Approach to Protecting Half the Terrestrial Realm. BioScience 67: 534–545. https://doi.org/10.1093/biosci/bix014

eMammal ( Study Design Recommendation for a Park. https://emammal.si.edu/about/study-design/park

European Environment Agency (EEA) (2021) EUNIS habitat classification. https://eunis.eea.europa.eu/habitats.jsp

Fegraus E H, Lin K, Ahumada J A, Baru C, Chandra S & Youn C (2011) Data acquisition and management software for camera trap data: A case study from the TEAM Network. Ecological Informatics 6: 345–353. https://doi.org/https://doi.org/10.1016/j.ecoinf.2011.06.003

Forrester T, O’Brien T, Fegraus E, Jansen P, Palmer J, Kays R, Ahumada J, Stern B & McShea W (2016) An Open Standard for Camera Trap Data. Biodiversity Data Journal 4: e10197. https://doi.org/10.3897/BDJ.4.e10197

Fortson L, Masters K, Nichol R, Edmondson E M, Lintott C, Raddick J & Wallin J (2012) Galaxy zoo: Morphological classification and citizen science. Advances in machine learning and data mining for astronomy 2012: 213–236.

GBIF Secretariat (2015) EML Agent Role Vocabulary. http://rs.gbif.org/vocabulary/gbif/agentRole

GBIF Secretariat (2018) Quick guide to publishing data through GBIF.org. GBIF. https://www.gbif.org/publishing-data

GBIF Secretariat (2020) Data quality requirements: Occurrence datasets. GBIF. https://www.gbif.org/data-quality-requirements-occurrences

GBIF Secretariat (2022) Diversifying the GBIF Data Model. GBIF. https://www.gbif.org/new-data-model

Glover‐Kapfer P, Soto‐Navarro C A & Wearn O R (2019) Camera‐trapping version 3.0: current constraints and future priorities for development. Rowcliffe M, Sollmann R (Eds). Remote Sensing in Ecology and Conservation 5: 209–223. https://doi.org/10.1002/rse2.106

Gomez Villa A, Salazar A & Vargas F (2017) Towards automatic wild animal monitoring: Identification of animal species in camera-trap images using very deep convolutional neural networks. Ecological Informatics 41: 24–32. https://doi.org/10.1016/j.ecoinf.2017.07.004

Green S E, Rees J P, Stephens P A, Hill R A & Giordano A J (2020) Innovations in Camera Trapping Technology and Approaches: The Integration of Citizen Science and Artificial Intelligence. Animals 10: 132. https://doi.org/10.3390/ani10010132

Groom Q, De Smedt S, Veríssimo Pereira N, Bogaerts A & Engledow H (2018) DoeDat, the Crowdsourcing Platform of Meise Botanic Garden. Biodiversity Information Science and Standards 2: e26803. https://doi.org/10.3897/biss.2.26803

Guillera-Arroita G, Ridout M S & Morgan B J T (2010) Design of occupancy studies with imperfect detection: Design of occupancy studies. Methods in Ecology and Evolution 1: 131–139. https://doi.org/10.1111/j.2041-210X.2010.00017.x

Hendry H & Mann C (2018) Camelot—intuitive software for camera-trap data management. Oryx 52: 15–15. https://doi.org/10.1017/S0030605317001818

Hobbs M T & Brehme C S (2017) An improved camera trap for amphibians, reptiles, small mammals, and large invertebrates. Crowther MS (Ed). PLOS ONE 12: e0185026. https://doi.org/10.1371/journal.pone.0185026

Howe E J, Buckland S T, Després-Einspenner M-L & Kühl H S (2017) Distance sampling with camera traps. Matthiopoulos J (Ed). Methods in Ecology and Evolution 8: 1558–1565. https://doi.org/10.1111/2041-210x.12790

Hsing P Y, Bradley S, Kent V T, Hill R A, Smith G C, Whittingham M J, Cokill J, Crawley D, MammalWeb volunteers & Stephens P A (2018) Economical crowdsourcing for camera trap image classification. Rowcliffe M, Wearn O (Eds). Remote Sensing in Ecology and Conservation 4: 361–374. https://doi.org/10.1002/rse2.84

IUCN (2019) Habitats Classification Scheme. https://www.iucnredlist.org/resources/habitat-classification-scheme

Jones K E, Bielby J, Cardillo M, Fritz S A, O’Dell J, Orme C D L, Safi K, Sechrest W, Boakes E H, Carbone C, Connolly C, Cutts M J, Foster J K, Grenyer R, Habib M, Plaster C A, Price S A, Rigby E A, Rist J, Teacher A, Bininda-Emonds O R P, Gittleman J L, Mace G M & Purvis A (2009) PanTHERIA: a species‐level database of life history, ecology, and geography of extant and recently extinct mammals: Ecological Archives E090‐184. Michener WK (Ed). Ecology 90: 2648–2648. https://doi.org/10.1890/08-1494.1

Jung M, Dahal P R, Butchart S H M, Donald P F, De Lamo X, Lesiv M, Kapos V, Rondinini C & Visconti P (2020) A global map of terrestrial habitat types. Scientific Data 7: 256. https://doi.org/10.1038/s41597-020-00599-8

Kays R, Arbogast B S, Baker‐Whatton M, Beirne C, Boone H M, Bowler M, Burneo S F, Cove M V, Ding P, Espinosa S, Gonçalves A L S, Hansen C P, Jansen P A, Kolowski J M, Knowles T W, Lima M G M, Millspaugh J, McShea W J, Pacifici K, Parsons A W, Pease B S, Rovero F, Santos F, Schuttler S G, Sheil D, Si X, Snider M & Spironello W R (2020) An empirical evaluation of camera trap study design: How many, how long and when? Fisher D (Ed). Methods in Ecology and Evolution 11: 700–713. https://doi.org/10.1111/2041-210X.13370

Kolowski J M & Forrester T D (2017) Camera trap placement and the potential for bias due to trails and other features. Arlettaz R (Ed). PLOS ONE 12: e0186679. https://doi.org/10.1371/journal.pone.0186679

Kucera T E & Barrett R H (2011) A History of Camera Trapping. In: O’Connell AF, Nichols JD, Karanth KU (Eds), Camera Traps in Animal Ecology: Methods and Analyses. Springer Japan, Tokyo, 9–26. https://doi.org/10.1007/978-4-431-99495-4_2

Lamelas-Lopez L, Pardavila X, Amorim I & Borges P (2020) Wildlife inventory from camera-trapping surveys in the Azores (Pico and Terceira islands). Biodiversity Data Journal 8: e47865. https://doi.org/10.3897/BDJ.8.e47865

Lasky M (2016) North Carolina’s Candid Critters. https://emammal.si.edu/north-carolinas-candid-critters

Law B E, Arkebauer T, Campbell J L, Chen J, Sun O, Schwartz M, Ingen C van & Verma S (2008) Terrestrial carbon observations: Protocols for vegetation sampling and data submission.

Life MICA (2019) MICA - Management of Invasive Coypu and muskrAt in Europe. https://lifemica.eu/ (accessed 30 June 2023)

Mackenzie D I & Royle J A (2005) Designing occupancy studies: general advice and allocating survey effort: Designing occupancy studies. Journal of Applied Ecology 42: 1105–1114. https://doi.org/10.1111/j.1365-2664.2005.01098.x

Marcus Rowcliffe J, Carbone C, Jansen P A, Kays R & Kranstauber B (2011) Quantifying the sensitivity of camera traps: an adapted distance sampling approach: Quantifying camera trap sensitivity. Methods in Ecology and Evolution 2: 464–476. https://doi.org/10.1111/j.2041-210X.2011.00094.x

McIntyre T, Majelantle T L, Slip D J & Harcourt R G (2020) Quantifying imperfect camera-trap detection probabilities: implications for density modelling. Wildlife Research 47: 177. https://doi.org/10.1071/WR19040

Meek P, Fleming P, Ballard G, Claridge A, Banks P, Sanderson J & Swann D (2014) Camera Trapping Wildlife Management and Research. CSIRO publishing.

Meek P D, Ballard G, Falzon G, Williamson J, Milne H, Farrell R, Stover J, Mather-Zardain A T, Bishop J C, Cheung E K-W, Lawson C K, Munezero A M, Schneider D, Johnston B E, Kiani E, Shahinfar S, Sadgrove E J & Fleming P J S (2020) Camera Trapping Technology and Related Advances: into the New Millennium. Australian Zoologist 40: 392–403. https://doi.org/10.7882/AZ.2019.035

Newkirk E S (2016) CPW Photo Warehouse. http://cpw.state.co.us/learn/Pages/ResearchMammalsSoftware.aspx

Nguyen H, Maclagan S J, Nguyen T D, Nguyen T, Flemons P, Andrews K, Ritchie E G & Phung D (2017) Animal Recognition and Identification with Deep Convolutional Neural Networks for Automated Wildlife Monitoring. In: 2017 IEEE International Conference on Data Science and Advanced Analytics (DSAA). , 40–49. https://doi.org/10.1109/DSAA.2017.31

Norouzzadeh M S, Morris D, Beery S, Joshi N, Jojic N & Clune J (2021) A deep active learning system for species identification and counting in camera trap images. Methods in Ecology and Evolution 12: 150–161. https://doi.org/10.1111/2041-210X.13504

Oldoni D, Desmet P & Huybrechts P (2023) camtraptor: Read, Explore and Visualize Camera Trap Data Packages. https://inbo.github.io/camtraptor/

Oliveira B F, São-Pedro V A, Santos-Barrera G, Penone C & Costa G C (2017) AmphiBIO, a global database for amphibian ecological traits. Scientific Data 4: 170123. https://doi.org/10.1038/sdata.2017.123

O’Brien T G (2010) Wildlife picture index and biodiversity monitoring: issues and future directions: Wildlife picture index and biodiversity monitoring. Animal Conservation 13: 350–352. https://doi.org/10.1111/j.1469-1795.2010.00384.x

O’Connell A F, Nichols J D & Karanth K U (2011) Camera traps in animal ecology: Methods and analyses. Lightning Source UK.

O’Connor K M, Nathan L R, Liberati M R, Tingley M W, Vokoun J C & Rittenhouse T A G (2017) Camera trap arrays improve detection probability of wildlife: Investigating study design considerations using an empirical dataset. Bonter DN (Ed). PLOS ONE 12: e0175684. https://doi.org/10.1371/journal.pone.0175684

Price Tack J L, West B S, McGowan C P, Ditchkoff S S, Reeves S J, Keever A C & Grand J B (2016) AnimalFinder: A semi-automated system for animal detection in time-lapse camera trap images. Ecological Informatics 36: 145–151. https://doi.org/10.1016/j.ecoinf.2016.11.003

Resources Information Standards Committee (RISC) (2019) Wildlife Camera Metadata Protocol: Standards for Components of British Columbia’s Biodiversity No. 44. https://www2.gov.bc.ca/assets/download/DABCE3A5C7934410A8307285070C24EA

Riley S J, DeGloria S D & Elliot R (1999) A Terrain Ruggedness Index That Quantifies Topographic Heterogeneity. International Journal of Sciences 5: 23–27. https://download.osgeo.org/qgis/doc/reference-docs/Terrain_Ruggedness_Index.pdf

Robertson T, Döring M, Guralnick R, Bloom D, Wieczorek J, Braak K, Otegui J, Russell L & Desmet P (2014) The GBIF Integrated Publishing Toolkit: Facilitating the Efficient Publishing of Biodiversity Data on the Internet. Little DP (Ed). PLoS ONE 9: e102623. https://doi.org/10.1371/journal.pone.0102623

Rovero F, Tobler M & Sanderson J (2010) Camera trapping for inventorying terrestrial vertebrates. In: Manual on Field Recording Techniques and Protocols for All Taxa Biodiversity Inventories. AbcTaxa. https://biblio.naturalsciences.be/rbins-publications/abc-txa/abc-taxa-08/chapter-6.pdf

Rovero F & Zimmermann F eds. (2016) Camera trapping for wildlife research. Pelagic Publishing, Exeter, UK.

Rovero F, Zimmermann F, Berzi D & Meek P (2013) “Which camera trap type and how many do I need?” A review of camera features and study designs for a range of wildlife research applications. Hystrix 24. https://doi.org/10.4404/hystrix-24.2-8789

Rowcliffe J M, Field J, Turvey S T & Carbone C (2008) Estimating Animal Density Using Camera Traps without the Need for Individual Recognition. Journal of Applied Ecology 45: 1228–1236. https://www.jstor.org/stable/20144086 (accessed 29 June 2023)

Rowcliffe J M, Jansen P A, Kays R, Kranstauber B & Carbone C (2016) Wildlife speed cameras: measuring animal travel speed and day range using camera traps. Pettorelli N (Ed). Remote Sensing in Ecology and Conservation 2: 84–94. https://doi.org/10.1002/rse2.17

Shannon G, Lewis J S & Gerber B D (2014) Recommended survey designs for occupancy modelling using motion-activated cameras: insights from empirical wildlife data. PeerJ 2: e532. https://doi.org/10.7717/peerj.532

Simpson R, Page K R & De Roure D (2014) Zooniverse: observing the world’s largest citizen science platform. In: Proceedings of the 23rd International Conference on World Wide Web. ACM, Seoul Korea, 1049–1054. https://doi.org/10.1145/2567948.2579215

Sollmann R, Gardner B & Belant J L (2012) How Does Spatial Study Design Influence Density Estimates from Spatial Capture-Recapture Models? Waterman JM (Ed). PLoS ONE 7: e34575. https://doi.org/10.1371/journal.pone.0034575

Soria C D, Pacifici M, Di Marco M, Stephen S M & Rondinini C (2021) COMBINE: a coalesced mammal database of intrinsic and extrinsic traits. Ecology 102. https://doi.org/10.1002/ecy.3344

Sun C, Beirne C, Burgar J M, Howey T, Fisher J T & Burton A C (2021) Simultaneous monitoring of vegetation dynamics and wildlife activity with camera traps to assess habitat change. Rowcliffe M, Hofmeester T (Eds). Remote Sensing in Ecology and Conservation 7: 666–684. https://doi.org/10.1002/rse2.222

Sunarto S, Sollmann R, Mohamed A & Kelly M J (2013) Camera trapping for the study and conservation of tropical carnivores. The Raffles Bulletin of Zoology 28: 21–42. http://zoobank.org/urn:lsid:zoobank.org:pub:804A6DC9-A92A-41AE-A820-F3DA48614761

Swanson A, Kosmala M, Lintott C, Simpson R, Smith A & Packer C (2015) Snapshot Serengeti, high-frequency annotated camera trap images of 40 mammalian species in an African savanna. Scientific Data 2: 150026. https://doi.org/10.1038/sdata.2015.26